Addressing Antisocial Behavior in Multi-Party Dialogs Through Multimodal Representation Learning

作者: Hajar Bakarou, Mohamed Sinane El Messoussi, Anaïs Ollagnier

分类: cs.CL

发布日期: 2025-10-20

💡 一句话要点

提出多模态表示学习方法,解决多方对话中的反社会行为检测问题

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 反社会行为检测 多方对话 多模态表示学习 图神经网络 自然语言处理

📋 核心要点

- 现有方法在多方对话反社会行为检测方面缺乏足够的数据和针对性模型,难以有效识别。

- 论文提出一种多模态表示学习方法,融合文本和图信息,捕捉词汇线索和互动动态,提升检测性能。

- 实验表明,多模态模型优于单模态模型,mBERT + WD-SGCN模型在辱骂检测上取得了最佳效果。

📝 摘要(中文)

社交媒体上的反社会行为(ASB),包括仇恨言论、骚扰和网络欺凌,对平台安全和社会福祉构成日益增长的风险。以往的研究主要集中在X和Reddit等网络上,而由于数据有限,多方对话环境仍未得到充分探索。为了解决这一差距,我们使用了CyberAgressionAdo-Large,这是一个模拟多方对话中ASB的法语开放数据集,并评估了三个任务:辱骂检测、欺凌行为分析和欺凌同伴群体识别。我们对六种基于文本和八种基于图的表示学习方法进行了基准测试,分析了词汇线索、互动动态及其多模态融合。结果表明,多模态模型优于单模态基线。其中,后期融合模型mBERT + WD-SGCN取得了最佳的总体结果,在辱骂检测方面表现最佳(0.718),在同伴群体识别(0.286)和欺凌分析(0.606)方面取得了有竞争力的分数。误差分析突出了其在处理细微的ASB现象(如隐性攻击、角色转换和上下文相关的敌意)方面的有效性。

🔬 方法详解

问题定义:论文旨在解决多方对话场景下,反社会行为(ASB)难以准确检测的问题。现有方法主要集中在单方或少量交互的场景,缺乏对多方对话中复杂互动关系和上下文信息的有效建模,导致检测精度不高,难以应对隐性攻击、角色转换等复杂情况。

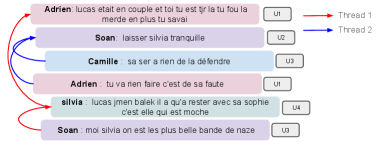

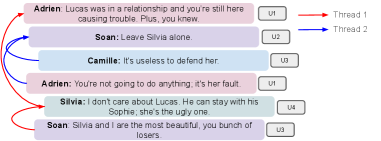

核心思路:论文的核心思路是利用多模态表示学习,融合文本信息和图结构信息,从而更全面地捕捉对话中的反社会行为特征。文本信息提供词汇线索,而图结构信息则反映了参与者之间的互动关系,两者结合可以更好地理解对话的语义和语用含义。

技术框架:整体框架包括数据预处理、特征提取、模型训练和评估四个阶段。首先,对CyberAgressionAdo-Large数据集进行预处理,包括文本清洗、分词等。然后,分别提取文本特征和图结构特征。文本特征通过预训练语言模型(如mBERT)获得,图结构特征通过图神经网络(如WD-SGCN)学习。接着,将两种特征进行融合,输入到分类器中进行训练。最后,使用测试集评估模型的性能。

关键创新:论文的关键创新在于将多模态表示学习应用于多方对话反社会行为检测。通过融合文本和图结构信息,模型能够更好地理解对话的上下文和参与者之间的互动关系,从而更准确地识别反社会行为。此外,论文还探索了不同的多模态融合策略,包括早期融合和后期融合。

关键设计:论文采用了mBERT作为文本特征提取器,WD-SGCN作为图结构特征提取器。mBERT是一种预训练的多语言Transformer模型,能够捕捉文本的语义信息。WD-SGCN是一种基于图卷积网络的模型,能够学习节点的表示,同时考虑节点的属性和节点之间的关系。在多模态融合方面,论文采用了后期融合策略,即将mBERT和WD-SGCN的输出进行拼接,然后输入到分类器中。损失函数采用交叉熵损失函数。

🖼️ 关键图片

📊 实验亮点

实验结果表明,多模态模型显著优于单模态模型。其中,mBERT + WD-SGCN模型在辱骂检测任务上取得了最佳性能,F1-score达到0.718,在同伴群体识别和欺凌分析任务上也取得了具有竞争力的结果(分别为0.286和0.606)。这表明融合文本和图结构信息能够有效提升反社会行为检测的准确性。

🎯 应用场景

该研究成果可应用于社交媒体平台、在线论坛、聊天室等场景,用于自动检测和过滤反社会行为,维护网络环境的健康和安全。通过识别欺凌行为和辱骂言论,可以及时采取干预措施,保护用户免受网络暴力侵害,提升用户体验。

📄 摘要(原文)

Antisocial behavior (ASB) on social media -- including hate speech, harassment, and cyberbullying -- poses growing risks to platform safety and societal well-being. Prior research has focused largely on networks such as X and Reddit, while \textit{multi-party conversational settings} remain underexplored due to limited data. To address this gap, we use \textit{CyberAgressionAdo-Large}, a French open-access dataset simulating ASB in multi-party conversations, and evaluate three tasks: \textit{abuse detection}, \textit{bullying behavior analysis}, and \textit{bullying peer-group identification}. We benchmark six text-based and eight graph-based \textit{representation-learning methods}, analyzing lexical cues, interactional dynamics, and their multimodal fusion. Results show that multimodal models outperform unimodal baselines. The late fusion model \texttt{mBERT + WD-SGCN} achieves the best overall results, with top performance on abuse detection (0.718) and competitive scores on peer-group identification (0.286) and bullying analysis (0.606). Error analysis highlights its effectiveness in handling nuanced ASB phenomena such as implicit aggression, role transitions, and context-dependent hostility.