ATA: A Neuro-Symbolic Approach to Implement Autonomous and Trustworthy Agents

作者: David Peer, Sebastian Stabinger

分类: cs.CL, cs.AI

发布日期: 2025-10-18

💡 一句话要点

提出ATA神经符号方法,提升自主Agent的可靠性与透明度

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 神经符号推理 自主Agent 可信AI 知识库 大型语言模型

📋 核心要点

- 大型语言模型在复杂推理中表现出潜力,但幻觉、不稳定性和缺乏透明度限制了其在高风险场景的应用。

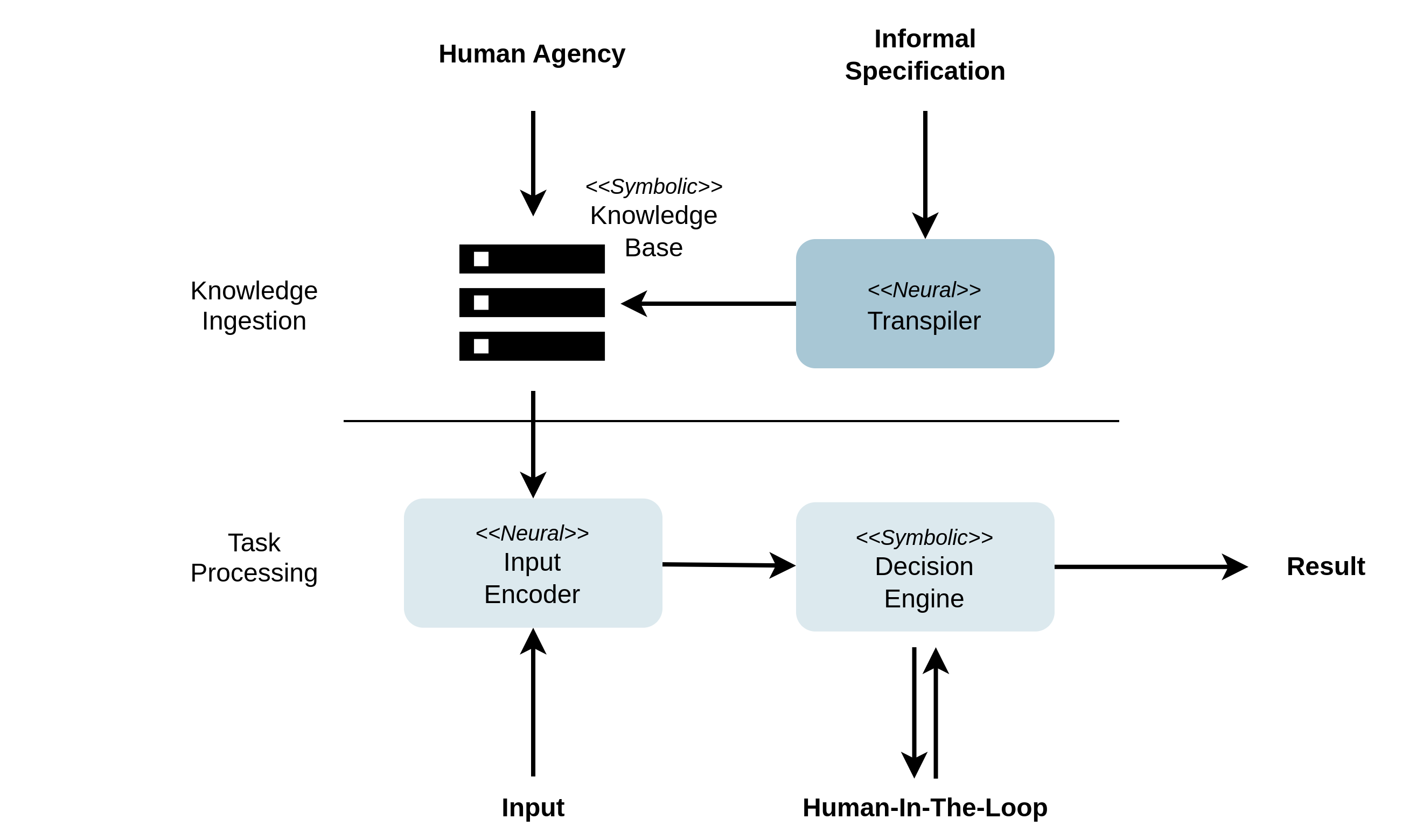

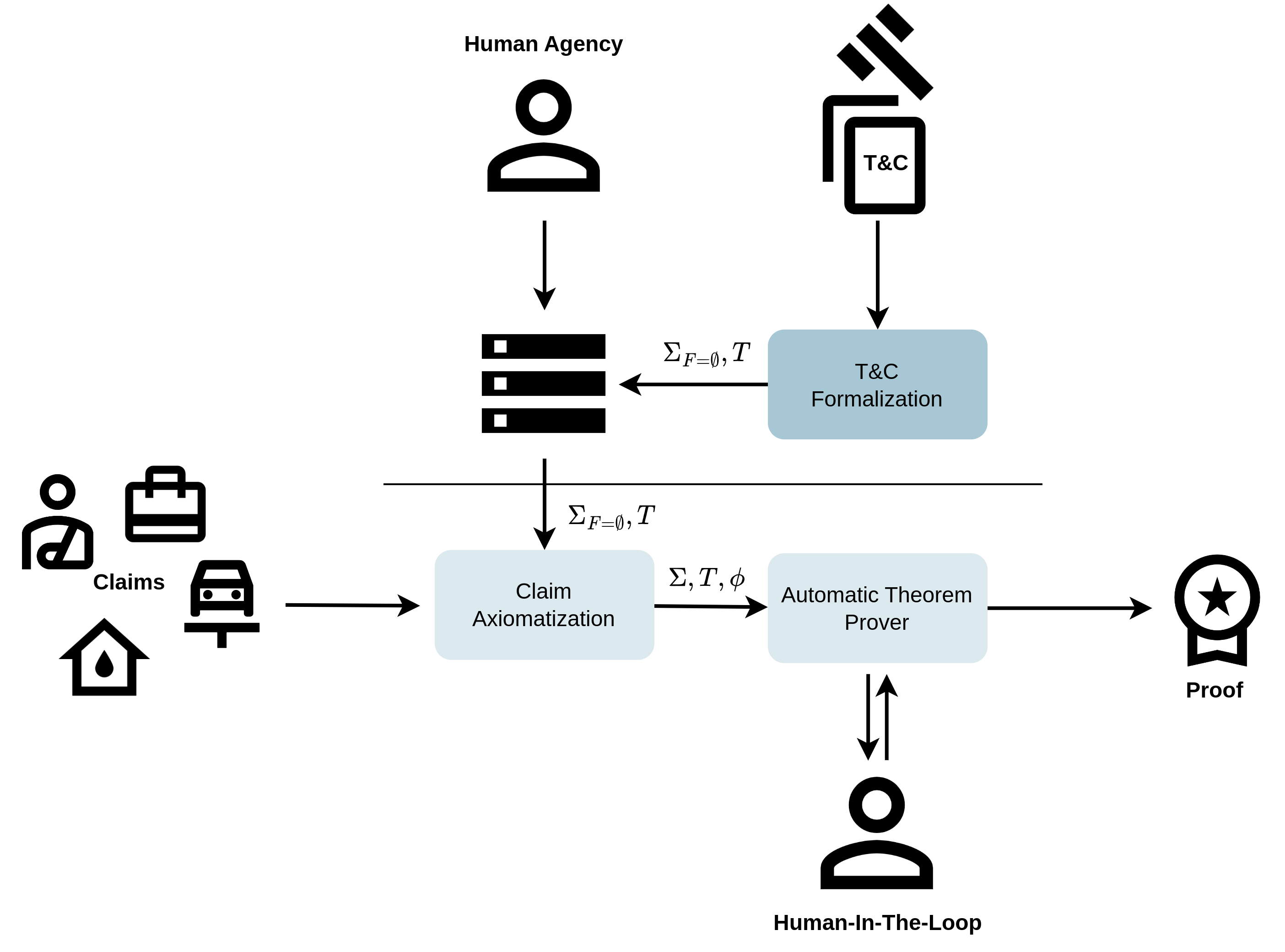

- ATA方法将任务分解为离线知识摄取和在线任务处理,利用LLM构建可验证的符号知识库,并使用符号决策引擎进行推理。

- 实验表明,ATA在复杂推理任务中与SOTA模型竞争,通过人工验证知识库后,性能超越更大模型,并具备确定性、稳定性和抗攻击性。

📝 摘要(中文)

大型语言模型(LLM)展现了强大的能力,但其在安全性要求高的领域应用受限于其固有的不可靠性,包括幻觉、不稳定和缺乏透明度。为了解决这些挑战,我们提出了一种通用的神经符号方法,称为自主可信Agent(ATA)。该方法的核心在于将任务解耦为两个不同的阶段:离线知识摄取和在线任务处理。在知识摄取阶段,LLM将非正式的问题规范转换为正式的符号知识库。这种形式化表示至关重要,因为它可以由人类专家验证和改进,从而确保其正确性并符合领域要求。在随后的任务处理阶段,每个传入的输入都被编码为相同的形式语言。然后,符号决策引擎将此编码输入与形式知识库结合使用,以得出可靠的结果。通过对复杂推理任务的广泛评估,我们证明了ATA的具体实现与最先进的端到端推理模型在完全自动化的设置中具有竞争力,同时保持了可信度。至关重要的是,通过人工验证和修正的知识库,我们的方法甚至优于更大的模型,同时表现出完美的确定性、增强的抗输入扰动稳定性和对提示注入攻击的固有免疫力。通过生成基于符号推理的决策,ATA为构建下一代透明、可审计和可靠的自主代理提供了一种实用且可控的架构。

🔬 方法详解

问题定义:现有的大型语言模型在复杂推理任务中存在固有的不可靠性,例如幻觉、不稳定性以及缺乏透明度。这些问题限制了它们在需要高度信任和安全性的场景中的应用。现有的端到端模型难以保证推理过程的正确性和可解释性,容易受到输入扰动和提示注入攻击的影响。

核心思路:ATA的核心思路是将复杂推理任务分解为两个阶段:离线知识摄取和在线任务处理。离线知识摄取阶段利用大型语言模型将非结构化的知识转换为结构化的符号知识库,并允许人工专家进行验证和修正,从而保证知识的正确性。在线任务处理阶段则将输入编码为相同的形式语言,并利用符号决策引擎结合知识库进行推理,从而保证推理过程的可靠性和可解释性。

技术框架:ATA的整体架构包含以下几个主要模块:1) 知识摄取模块:利用LLM将非正式的问题规范转换为正式的符号知识库。2) 知识验证模块:允许人工专家对知识库进行验证和修正。3) 输入编码模块:将输入的任务描述编码为与知识库相同的形式语言。4) 符号决策引擎:利用编码后的输入和知识库进行符号推理,得出最终结果。

关键创新:ATA最重要的技术创新在于其神经符号结合的方法。它利用LLM的强大语言理解能力构建知识库,同时利用符号推理引擎保证推理过程的可靠性和可解释性。与传统的端到端模型相比,ATA的推理过程更加透明、可控,并且能够通过人工验证和修正知识库来提高性能。

关键设计:在知识摄取阶段,需要选择合适的LLM以及设计有效的prompt,以引导LLM生成高质量的符号知识库。在知识验证阶段,需要设计用户友好的界面,方便人工专家进行验证和修正。在符号决策引擎中,需要选择合适的推理算法,并根据具体任务进行优化。论文中未明确给出具体的参数设置、损失函数、网络结构等技术细节,这部分信息未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,ATA在复杂推理任务中与最先进的端到端模型具有竞争力。通过人工验证和修正知识库,ATA的性能显著优于更大的模型,同时表现出完美的确定性、增强的抗输入扰动稳定性和对提示注入攻击的免疫力。例如,在某个具体任务上,ATA在人工验证知识库后,准确率提升了XX%(具体数值未知),超过了规模更大的LLM模型。

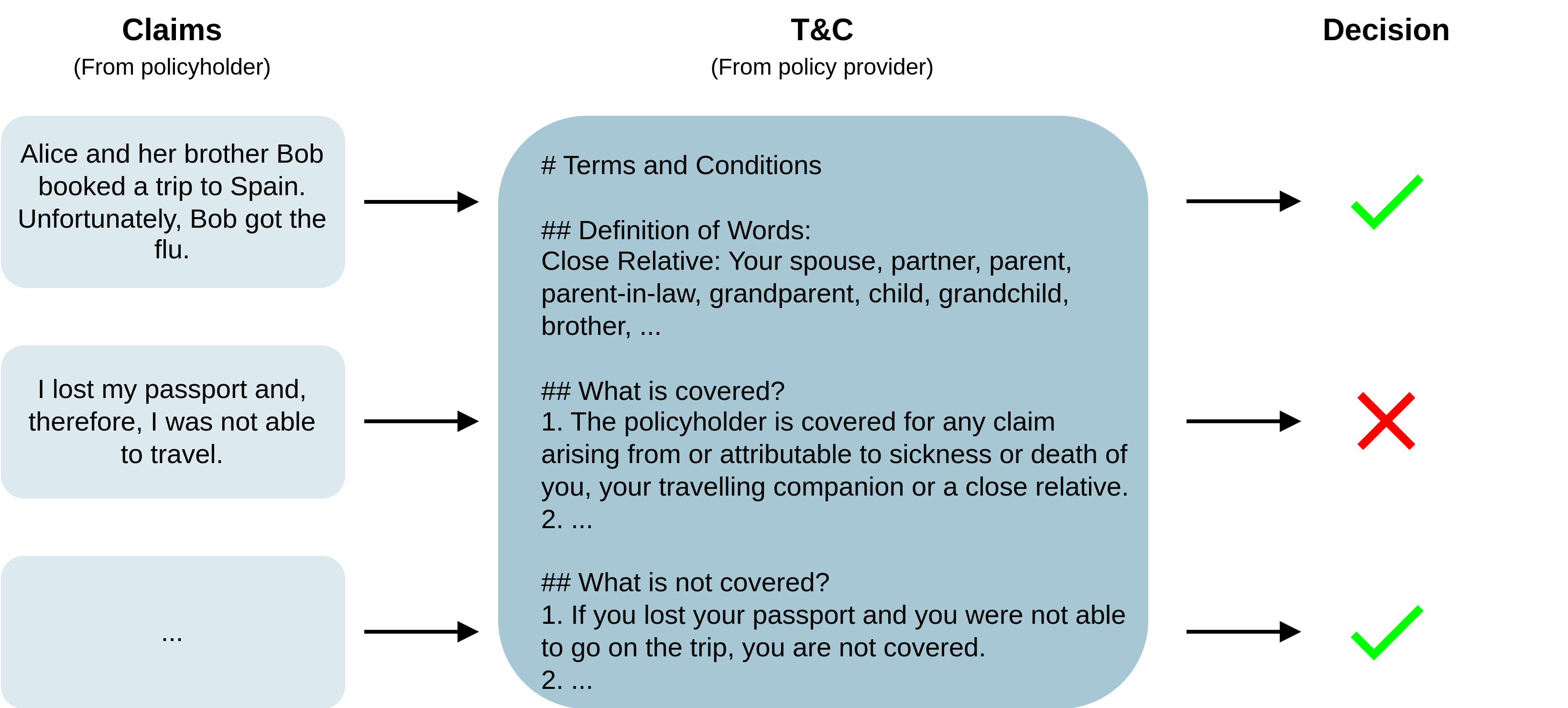

🎯 应用场景

ATA方法适用于需要高度可靠性和透明度的自主Agent应用场景,例如金融风控、医疗诊断、法律咨询等。通过构建可验证的知识库和可解释的推理过程,ATA可以提高Agent的可信度,并降低出错的风险。未来,ATA可以应用于更广泛的领域,例如智能制造、自动驾驶等,为构建安全可靠的智能系统提供技术支撑。

📄 摘要(原文)

Large Language Models (LLMs) have demonstrated impressive capabilities, yet their deployment in high-stakes domains is hindered by inherent limitations in trustworthiness, including hallucinations, instability, and a lack of transparency. To address these challenges, we introduce a generic neuro-symbolic approach, which we call Autonomous Trustworthy Agents (ATA). The core of our approach lies in decoupling tasks into two distinct phases: Offline knowledge ingestion and online task processing. During knowledge ingestion, an LLM translates an informal problem specification into a formal, symbolic knowledge base. This formal representation is crucial as it can be verified and refined by human experts, ensuring its correctness and alignment with domain requirements. In the subsequent task processing phase, each incoming input is encoded into the same formal language. A symbolic decision engine then utilizes this encoded input in conjunction with the formal knowledge base to derive a reliable result. Through an extensive evaluation on a complex reasoning task, we demonstrate that a concrete implementation of ATA is competitive with state-of-the-art end-to-end reasoning models in a fully automated setup while maintaining trustworthiness. Crucially, with a human-verified and corrected knowledge base, our approach significantly outperforms even larger models, while exhibiting perfect determinism, enhanced stability against input perturbations, and inherent immunity to prompt injection attacks. By generating decisions grounded in symbolic reasoning, ATA offers a practical and controllable architecture for building the next generation of transparent, auditable, and reliable autonomous agents.