LLMs Judge Themselves: A Game-Theoretic Framework for Human-Aligned Evaluation

作者: Gao Yang, Yuhang Liu, Siyu Miao, Xinyue Liang, Zhengyang Liu, Heyan Huang

分类: cs.CL, cs.AI

发布日期: 2025-10-17

💡 一句话要点

提出基于博弈论的LLM互评估框架,实现更符合人类认知的模型评估

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型评估 互评估 博弈论 人类对齐 自动评估

📋 核心要点

- 传统LLM评估方法难以捕捉模型输出的主观性和开放性,无法有效反映人类认知。

- 提出LLM互评估框架,利用自博弈和同行评审机制,让LLM互相评估并与人类判断对齐。

- 通过实验对比模型互评估结果与人类评估,揭示了互评估的优势与局限性,为未来研究提供指导。

📝 摘要(中文)

本文探讨了博弈论原则在评估大型语言模型(LLMs)中的有效性。传统评估方法依赖于固定格式的任务和参考答案,难以捕捉现代LLM行为的细微、主观和开放性。为了解决这些挑战,我们提出了一种新的替代方案:自动互评估,即LLMs通过自博弈和同行评审来评估彼此的输出。然后,将这些同行评估与人类投票行为进行系统比较,以评估它们与人类判断的一致性。我们的框架结合了博弈论投票算法来聚合同行评审,从而对模型生成的排名是否反映人类偏好进行有原则的调查。实证结果揭示了理论预测与人类评估之间的趋同和差异,为互评估的希望和局限性提供了有价值的见解。据我们所知,这是第一个联合整合互评估、博弈论聚合和以人为本的验证来评估LLMs能力的工作。

🔬 方法详解

问题定义:现有LLM评估方法主要依赖于预定义的任务和标准答案,无法有效评估LLM在开放式、主观性较强的任务中的表现。这些方法难以捕捉LLM输出的细微差别,也难以反映人类的真实偏好。因此,如何设计一种更符合人类认知的LLM评估方法是一个亟待解决的问题。

核心思路:本文的核心思路是利用LLM自身的智能来评估其他LLM的输出。通过让LLM进行自博弈和同行评审,可以模拟人类的评估过程,从而更全面地了解LLM的能力。此外,通过将LLM的评估结果与人类的评估结果进行对比,可以评估LLM评估的准确性和可靠性。

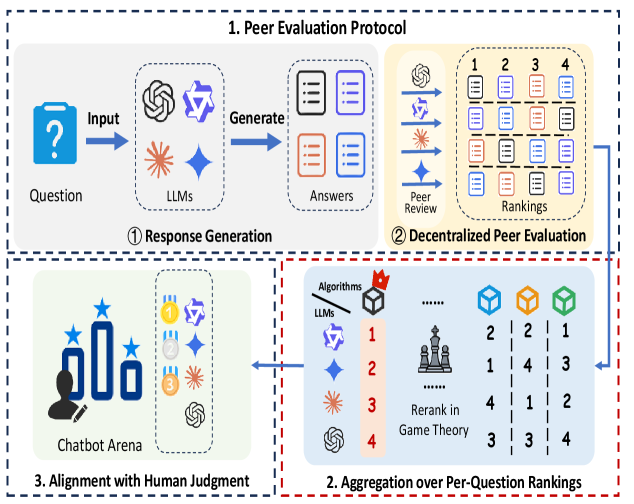

技术框架:该框架主要包含三个阶段:1) LLM互评估阶段:多个LLM针对同一任务生成输出,然后互相评估彼此的输出。2) 博弈论聚合阶段:利用博弈论的投票算法,将多个LLM的评估结果进行聚合,得到一个综合的排名。3) 人类验证阶段:将LLM生成的排名与人类的评估结果进行对比,评估LLM评估的准确性和可靠性。

关键创新:该论文的关键创新在于将互评估、博弈论聚合和人类验证三个方面结合起来,形成一个完整的LLM评估框架。与传统的评估方法相比,该框架可以更全面、更准确地评估LLM的能力,并且更符合人类的认知。

关键设计:在LLM互评估阶段,需要设计合适的评估指标和评估流程,以确保评估的公平性和有效性。在博弈论聚合阶段,需要选择合适的投票算法,以确保聚合结果的准确性和可靠性。在人类验证阶段,需要招募足够数量的评估者,并设计合理的评估流程,以确保评估结果的客观性和公正性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,基于博弈论的LLM互评估框架在一定程度上能够反映人类的偏好。通过对比LLM生成的排名与人类的评估结果,发现两者之间存在一定的相关性。然而,也存在一些差异,表明LLM的评估能力仍有提升空间。该研究为未来LLM评估方法的研究提供了有价值的参考。

🎯 应用场景

该研究成果可应用于LLM的自动评估、模型选择和能力提升。通过自动互评估,可以降低人工评估的成本,提高评估效率。此外,该方法还可以用于指导LLM的训练,使其更好地符合人类的偏好。未来,该方法有望成为LLM评估的标准方法之一。

📄 摘要(原文)

Ideal or real - that is the question.In this work, we explore whether principles from game theory can be effectively applied to the evaluation of large language models (LLMs). This inquiry is motivated by the growing inadequacy of conventional evaluation practices, which often rely on fixed-format tasks with reference answers and struggle to capture the nuanced, subjective, and open-ended nature of modern LLM behavior. To address these challenges, we propose a novel alternative: automatic mutual evaluation, where LLMs assess each other's output through self-play and peer review. These peer assessments are then systematically compared with human voting behavior to evaluate their alignment with human judgment. Our framework incorporates game-theoretic voting algorithms to aggregate peer reviews, enabling a principled investigation into whether model-generated rankings reflect human preferences. Empirical results reveal both convergences and divergences between theoretical predictions and human evaluations, offering valuable insights into the promises and limitations of mutual evaluation. To the best of our knowledge, this is the first work to jointly integrate mutual evaluation, game-theoretic aggregation, and human-grounded validation for evaluating the capabilities of LLMs.