GraphMind: Interactive Novelty Assessment System for Accelerating Scientific Discovery

作者: Italo Luis da Silva, Hanqi Yan, Lin Gui, Yulan He

分类: cs.IR, cs.CL

发布日期: 2025-10-17

备注: 9 pages, 6 figures, 3 tables, EMNLP 2025 Demo paper

🔗 代码/项目: GITHUB | PROJECT_PAGE

💡 一句话要点

GraphMind:交互式新颖性评估系统加速科学发现

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 新颖性评估 大型语言模型 科学文献分析 交互式工具 信息检索

📋 核心要点

- 现有科学论文新颖性评估方法透明度不足,缺乏结果可追溯性,难以辅助审稿人。

- GraphMind通过交互式Web工具,使用户能够捕获论文结构,探索相关想法,并评估新颖性。

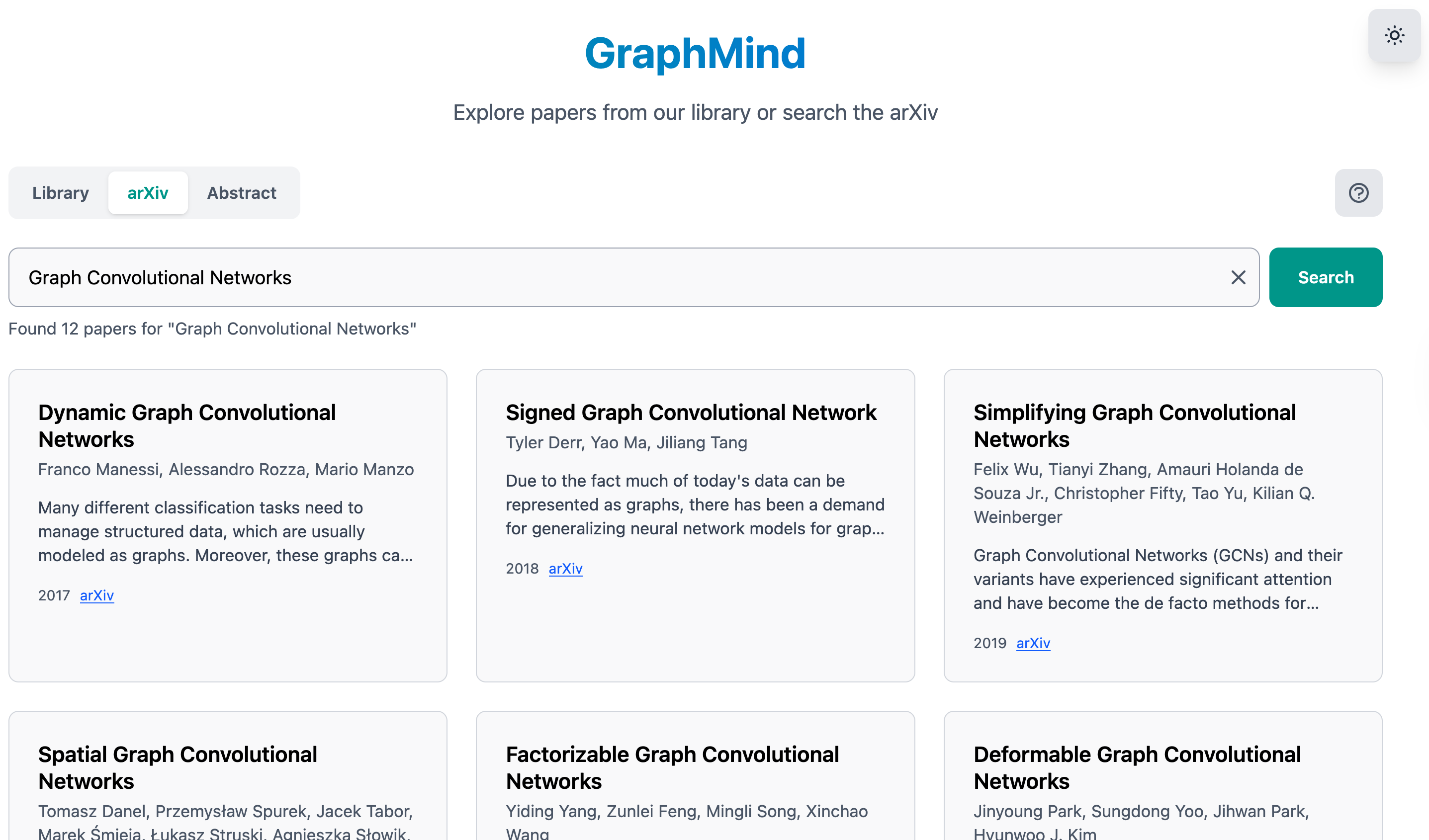

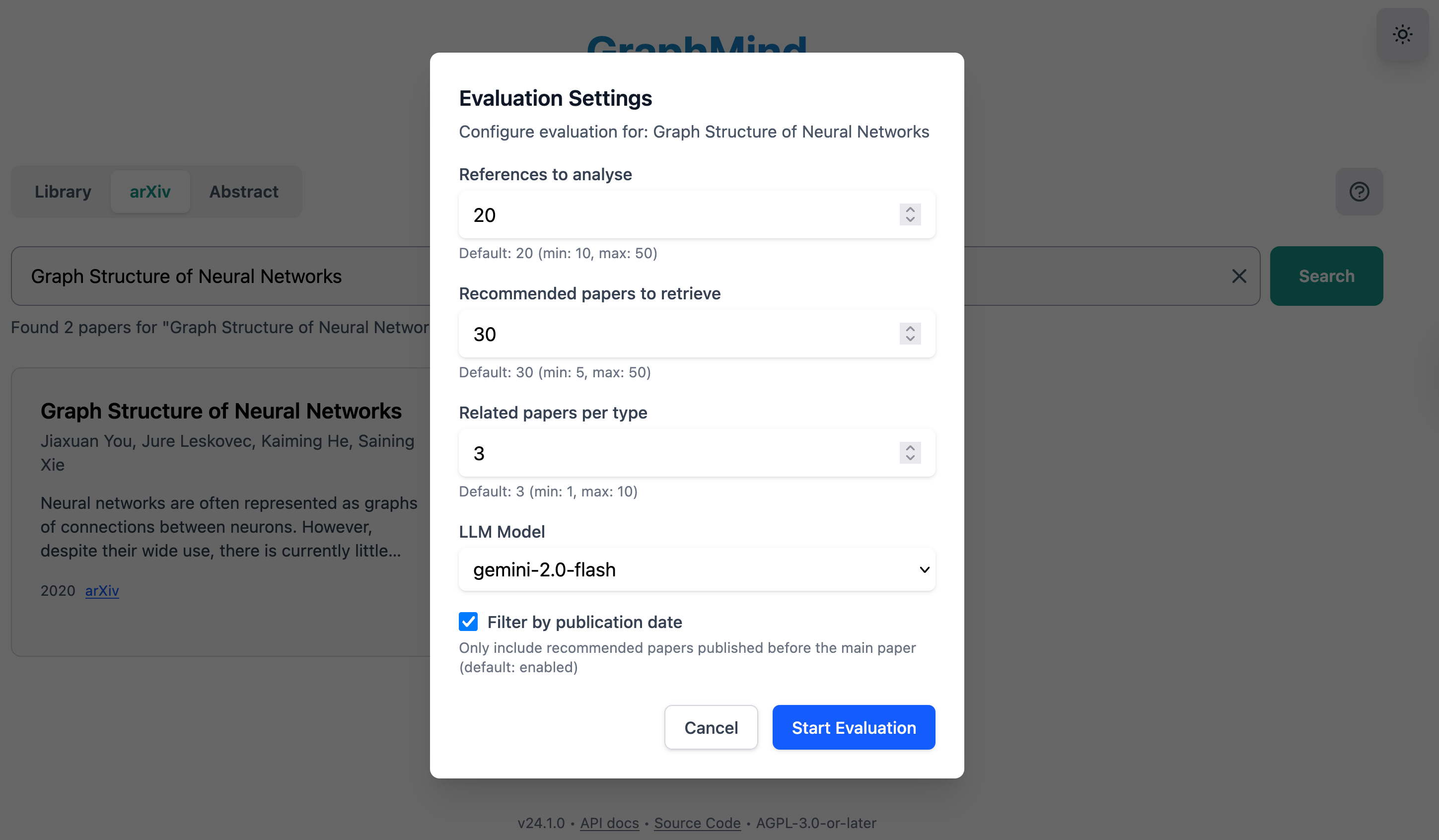

- GraphMind集成了arXiv和Semantic Scholar等API与LLM,支持论文的注释、提取、检索和分类。

📝 摘要(中文)

大型语言模型(LLMs)展现出强大的推理和文本生成能力,促使它们被应用于科学文献分析,包括新颖性评估。评估科学论文的新颖性对于同行评审至关重要,但这需要对相关工作有广泛的了解,而并非所有审稿人都能具备。虽然最近关于LLM辅助科学文献分析的工作支持文献比较,但现有方法的透明度有限,并且缺乏通过信息检索模块实现结果可追溯性的机制。为了解决这个差距,我们引入了$ extbf{GraphMind}$,一个易于使用的交互式Web工具,旨在帮助用户评估科学论文或草拟想法的新颖性。$ extbf{GraphMind}$使用户能够捕获科学论文的主要结构,通过各种角度探索相关想法,并通过提供可验证的上下文见解来评估新颖性。该工具集成了外部API,如arXiv和Semantic Scholar与LLM,以支持论文的注释、提取、检索和分类。这种组合为用户提供了一个关于科学想法的核心贡献及其与现有工作的联系的丰富、结构化的视图。

🔬 方法详解

问题定义:论文旨在解决科学论文新颖性评估中,现有方法透明度不足和结果可追溯性差的问题。现有方法难以帮助审稿人快速了解论文贡献,并将其与现有工作进行比较,从而影响评审效率和质量。

核心思路:论文的核心思路是构建一个交互式的Web工具,利用大型语言模型(LLMs)和外部知识库(如arXiv和Semantic Scholar)来辅助用户评估论文的新颖性。通过结构化地呈现论文的核心贡献及其与现有工作的联系,提高评估的透明度和可追溯性。

技术框架:GraphMind的整体架构包含以下主要模块:1) 论文注释模块:允许用户标注论文的关键元素。2) 信息检索模块:利用arXiv和Semantic Scholar等API检索相关论文。3) LLM驱动的分析模块:使用LLM提取论文的核心思想,并进行新颖性评估。4) 交互式可视化模块:以图形化的方式呈现论文之间的关系和新颖性评估结果。

关键创新:GraphMind的关键创新在于其交互性和可解释性。用户可以通过交互式界面探索论文之间的关系,并查看LLM提供的上下文见解,从而更好地理解论文的新颖性。此外,GraphMind集成了多个外部API和LLM,提供了一个全面的新颖性评估平台。

关键设计:GraphMind的关键设计包括:1) 使用LLM进行论文摘要和关键词提取。2) 利用Semantic Scholar API构建论文引用网络。3) 设计交互式界面,方便用户探索论文之间的关系。4) 使用LLM生成新颖性评估报告,并提供可验证的上下文见解。

🖼️ 关键图片

📊 实验亮点

由于论文主要介绍了一个交互式工具,并没有提供具体的性能数据。其亮点在于集成了LLM和外部知识库,提供了一个交互式的新颖性评估平台,用户可以通过该平台探索论文之间的关系,并查看LLM提供的上下文见解,从而更好地理解论文的新颖性。

🎯 应用场景

GraphMind可应用于科学研究、学术出版和技术创新等领域。它可以帮助研究人员快速评估自己或他人研究的新颖性,避免重复研究,并促进创新。同时,它也可以辅助期刊编辑和审稿人进行同行评审,提高评审效率和质量。未来,GraphMind可以扩展到其他领域,如专利检索和技术趋势分析。

📄 摘要(原文)

Large Language Models (LLMs) show strong reasoning and text generation capabilities, prompting their use in scientific literature analysis, including novelty assessment. While evaluating novelty of scientific papers is crucial for peer review, it requires extensive knowledge of related work, something not all reviewers have. While recent work on LLM-assisted scientific literature analysis supports literature comparison, existing approaches offer limited transparency and lack mechanisms for result traceability via an information retrieval module. To address this gap, we introduce $\textbf{GraphMind}$, an easy-to-use interactive web tool designed to assist users in evaluating the novelty of scientific papers or drafted ideas. Specially, $\textbf{GraphMind}$ enables users to capture the main structure of a scientific paper, explore related ideas through various perspectives, and assess novelty via providing verifiable contextual insights. $\textbf{GraphMind}$ enables users to annotate key elements of a paper, explore related papers through various relationships, and assess novelty with contextual insight. This tool integrates external APIs such as arXiv and Semantic Scholar with LLMs to support annotation, extraction, retrieval and classification of papers. This combination provides users with a rich, structured view of a scientific idea's core contributions and its connections to existing work. $\textbf{GraphMind}$ is available at https://oyarsa.github.io/graphmind and a demonstration video at https://youtu.be/wKbjQpSvwJg. The source code is available at https://github.com/oyarsa/graphmind.