Leveraging LLMs for Context-Aware Implicit Textual and Multimodal Hate Speech Detection

作者: Joshua Wolfe Brook, Ilia Markov

分类: cs.CL

发布日期: 2025-10-17

备注: 8 pages, 9 figures, submitted to LREC 2026

💡 一句话要点

利用大型语言模型增强上下文感知的隐式文本和多模态仇恨言论检测

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 仇恨言论检测 大型语言模型 上下文感知 多模态学习 隐式语义

📋 核心要点

- 现有仇恨言论检测方法难以捕捉隐式和多模态语境下的细微差别,导致检测效果不佳。

- 利用大型语言模型生成上下文信息,并将其融入到分类器的输入中,从而增强模型对隐式信息的理解。

- 实验结果表明,该方法在文本和多模态仇恨言论检测任务上均取得了显著的性能提升。

📝 摘要(中文)

本研究提出了一种新颖的文本和多模态仇恨言论检测(HSD)方法,该方法利用大型语言模型(LLM)作为动态知识库,生成背景上下文并将其整合到HSD分类器的输入中。研究考察了两种上下文生成策略:一种侧重于命名实体,另一种侧重于全文提示。比较了四种将上下文融入分类器输入的方法:文本拼接、嵌入拼接、基于分层Transformer的融合以及LLM驱动的文本增强。实验在隐式仇恨言论的文本Latent Hatred数据集上进行,并应用于含厌女模因的多模态MAMI数据集。结果表明,上下文信息及其融入方法至关重要,从零上下文基线到性能最佳的系统(基于嵌入拼接),文本和多模态设置分别获得了高达3和6个F1点的提升。

🔬 方法详解

问题定义:论文旨在解决隐式文本和多模态仇恨言论检测问题。现有方法通常依赖于显式的关键词或模式匹配,难以捕捉隐式仇恨言论中微妙的语义和语境信息。此外,多模态仇恨言论检测需要同时理解文本和图像信息,现有方法在多模态信息融合方面存在不足。

核心思路:论文的核心思路是利用大型语言模型(LLM)的强大知识库和生成能力,为仇恨言论检测提供更丰富的上下文信息。通过将LLM生成的上下文信息融入到分类器的输入中,可以增强模型对隐式语义和语境的理解,从而提高检测性能。

技术框架:整体框架包括以下几个主要步骤:1) 上下文生成:使用LLM生成与输入文本相关的上下文信息,包括基于命名实体的上下文和基于全文提示的上下文。2) 上下文融合:将生成的上下文信息与原始输入文本进行融合,采用四种不同的融合方法:文本拼接、嵌入拼接、基于分层Transformer的融合和LLM驱动的文本增强。3) 仇恨言论分类:使用分类器对融合后的文本进行仇恨言论分类。

关键创新:论文的关键创新在于利用LLM作为动态知识库,为仇恨言论检测提供上下文信息。与传统的静态知识库相比,LLM可以根据输入文本动态生成相关的上下文,从而更好地捕捉隐式语义和语境信息。此外,论文还比较了多种上下文融合方法,并发现嵌入拼接方法能够取得最佳性能。

关键设计:论文采用了两种上下文生成策略:基于命名实体的上下文生成和基于全文提示的上下文生成。基于命名实体的上下文生成侧重于识别输入文本中的命名实体,并利用LLM生成与这些实体相关的背景信息。基于全文提示的上下文生成则直接将整个输入文本作为提示,让LLM生成相关的上下文信息。在上下文融合方面,论文比较了文本拼接、嵌入拼接、基于分层Transformer的融合和LLM驱动的文本增强四种方法。嵌入拼接方法将原始输入文本和上下文信息的嵌入向量进行拼接,然后输入到分类器中进行分类。

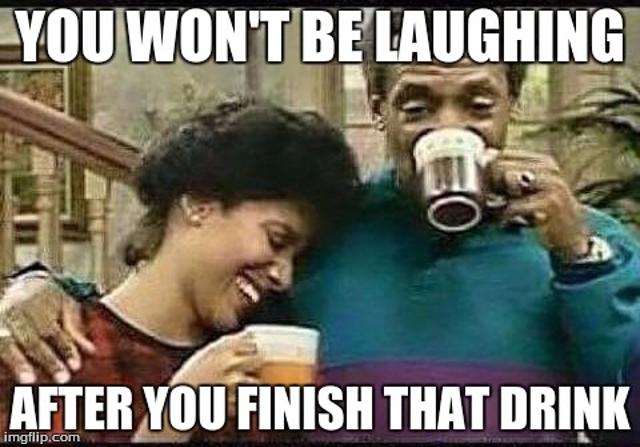

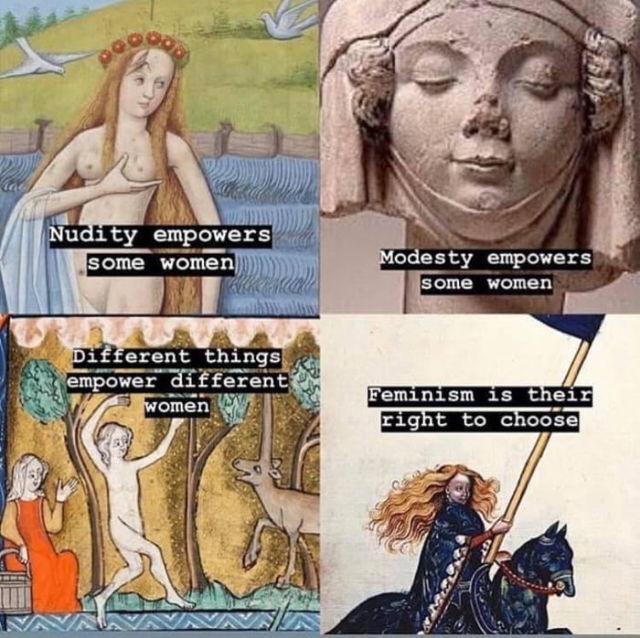

🖼️ 关键图片

📊 实验亮点

实验结果表明,利用LLM生成的上下文信息可以显著提高仇恨言论检测的性能。在文本Latent Hatred数据集上,基于嵌入拼接的上下文融合方法获得了3个F1点的提升。在多模态MAMI数据集上,该方法获得了6个F1点的提升,表明该方法在多模态场景下也具有良好的泛化能力。

🎯 应用场景

该研究成果可应用于社交媒体平台、在线论坛等场景,用于自动检测和过滤仇恨言论,维护健康的网络环境。此外,该方法还可以扩展到其他自然语言处理任务,如情感分析、文本分类等,提高模型对上下文信息的理解能力。

📄 摘要(原文)

This research introduces a novel approach to textual and multimodal Hate Speech Detection (HSD), using Large Language Models (LLMs) as dynamic knowledge bases to generate background context and incorporate it into the input of HSD classifiers. Two context generation strategies are examined: one focused on named entities and the other on full-text prompting. Four methods of incorporating context into the classifier input are compared: text concatenation, embedding concatenation, a hierarchical transformer-based fusion, and LLM-driven text enhancement. Experiments are conducted on the textual Latent Hatred dataset of implicit hate speech and applied in a multimodal setting on the MAMI dataset of misogynous memes. Results suggest that both the contextual information and the method by which it is incorporated are key, with gains of up to 3 and 6 F1 points on textual and multimodal setups respectively, from a zero-context baseline to the highest-performing system, based on embedding concatenation.