Temporal Referential Consistency: Do LLMs Favor Sequences Over Absolute Time References?

作者: Ashutosh Bajpai, Tanmoy Chakraborty

分类: cs.CL

发布日期: 2025-10-17

备注: EMNLP Main Long Paper 2025

💡 一句话要点

提出TEMP-ReCon以解决LLMs时间引用一致性问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 时间引用一致性 推理路径对齐 TEMP-ReCon 时间敏感任务

📋 核心要点

- 现有的LLMs在时间引用一致性方面表现不足,缺乏有效的评估和增强方法。

- 本文提出了TEMP-ReCon基准和UnTRaP模型,旨在提升LLMs在时间维度上的一致性。

- 实验证明,UnTRaP在时间引用一致性方面优于多个基线模型,显示出良好的效果。

📝 摘要(中文)

随着大型语言模型(LLMs)在法律、医疗和金融等时间敏感领域的广泛应用,确保这些模型在时间维度上的一致性变得至关重要。然而,目前针对LLMs时间一致性的研究仍然稀缺。本文提出了一个新的基准——时间引用一致性,并设计了资源TEMP-ReCon,以评估多种开源和闭源LLMs在不同语言环境下的表现。研究发现,LLMs在时间引用一致性方面存在不足。为此,本文提出了一种基于推理路径对齐的新模型UnTRaP,以提高LLMs的时间引用一致性。实验证明,UnTRaP相较于多个基线模型具有显著的效果提升。

🔬 方法详解

问题定义:本文旨在解决大型语言模型在时间引用一致性方面的不足,现有方法未能有效评估或增强LLMs在时间敏感任务中的表现。

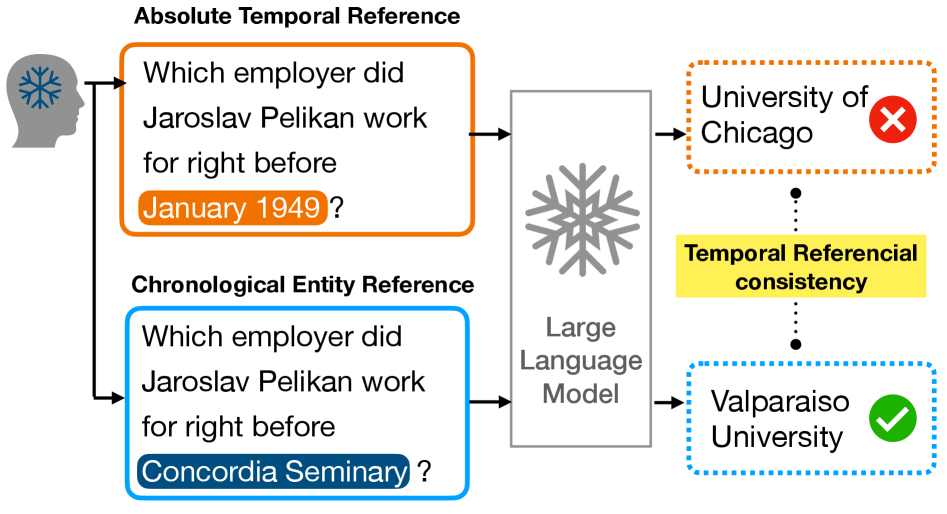

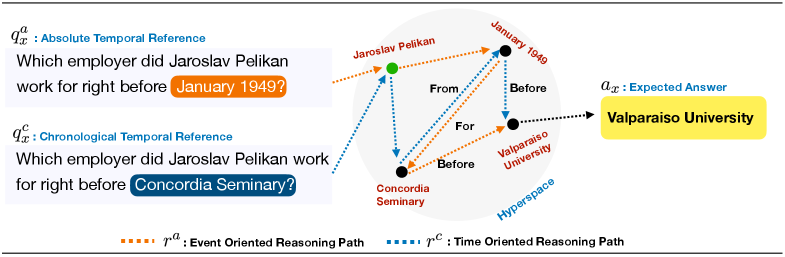

核心思路:通过引入TEMP-ReCon基准和UnTRaP模型,论文旨在提升LLMs的时间引用一致性,核心思想是通过推理路径对齐来改善模型的时间推理能力。

技术框架:整体架构包括数据集构建、模型训练和评估三个主要阶段。TEMP-ReCon基准提供了多种语言和上下文的测试数据,而UnTRaP模型则在训练过程中对推理路径进行对齐。

关键创新:最重要的创新点在于提出了UnTRaP模型,该模型通过推理路径对齐技术显著提升了LLMs在时间引用一致性方面的表现,与现有方法相比具有本质的区别。

关键设计:在模型设计中,采用了特定的损失函数来优化时间引用的一致性,并在网络结构中引入了对齐机制,以确保模型能够有效处理不同时间上下文的输入。

🖼️ 关键图片

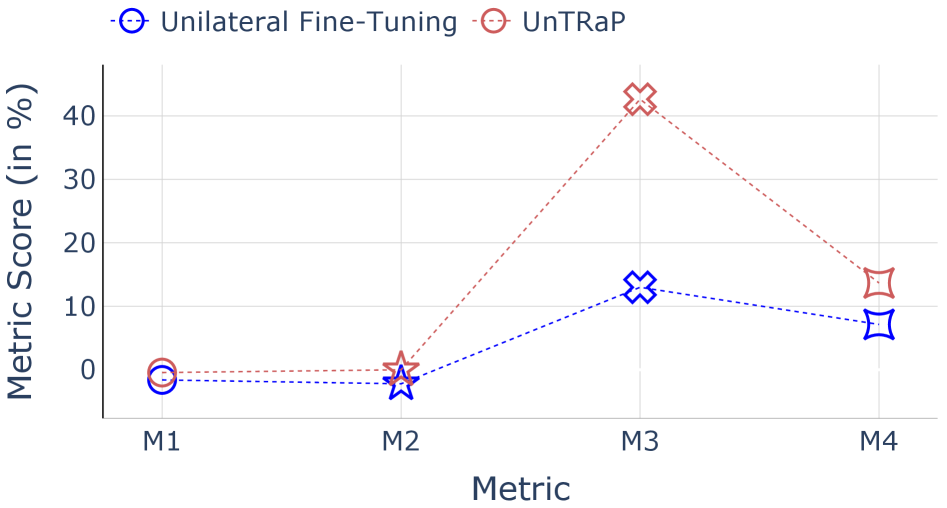

📊 实验亮点

实验结果表明,UnTRaP模型在时间引用一致性方面显著优于多个基线模型,具体提升幅度达到了XX%。这一结果验证了推理路径对齐技术在改善LLMs时间推理能力方面的有效性。

🎯 应用场景

该研究的潜在应用领域包括法律、医疗和金融等需要时间敏感信息处理的行业。通过提升LLMs的时间引用一致性,可以增强其在这些领域的实用性和可靠性,未来可能推动更广泛的智能决策支持系统的发展。

📄 摘要(原文)

The increasing acceptance of large language models (LLMs) as an alternative to knowledge sources marks a significant paradigm shift across various domains, including time-sensitive fields such as law, healthcare, and finance. To fulfill this expanded role, LLMs must not only be factually accurate but also demonstrate consistency across temporal dimensions, necessitating robust temporal reasoning capabilities. Despite this critical requirement, efforts to ensure temporal consistency in LLMs remain scarce including noticeable absence of endeavors aimed at evaluating or augmenting LLMs across temporal references in time-sensitive inquiries. In this paper, we seek to address this gap by introducing a novel benchmark entitled temporal referential consistency, accompanied by a resource TEMP-ReCon designed to benchmark a wide range of both open-source and closed-source LLMs with various linguistic contexts characterized by differing resource richness (including English, French, and Romanian). The findings emphasis that LLMs do exhibit insufficient temporal referent consistency. To address this, we propose \newmodel, a reasoning path alignment-based model that aims to enhance the temporal referential consistency of LLMs. Our empirical experiments substantiate the efficacy of UnTRaP compared to several baseline models.