CORE: Reducing UI Exposure in Mobile Agents via Collaboration Between Cloud and Local LLMs

作者: Gucongcong Fan, Chaoyue Niu, Chengfei Lyu, Fan Wu, Guihai Chen

分类: cs.CL

发布日期: 2025-10-17

🔗 代码/项目: GITHUB

💡 一句话要点

提出CORE框架以减少移动代理中的UI暴露问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 移动代理 用户界面 隐私保护 协同决策 云计算 地方计算

📋 核心要点

- 现有方法在使用云LLMs时需要频繁上传UI状态,导致隐私泄露风险。

- CORE框架通过布局感知分区、协同规划和决策,结合云与地方LLMs的优势,减少UI暴露。

- 实验结果显示,CORE在多种应用中将UI暴露减少了55.6%,任务成功率接近云-only代理。

📝 摘要(中文)

移动代理依赖大型语言模型(LLMs)在智能手机用户界面(UIs)上规划和执行任务。尽管基于云的LLMs在任务准确性上表现优异,但每一步都需要上传完整的UI状态,暴露了不必要且常常无关的信息。相对而言,地方LLMs避免了UI上传,但由于能力有限,导致任务成功率较低。本文提出了CORE框架,通过结合云和地方LLMs的优势,减少UI暴露,同时保持移动代理的任务准确性。CORE包含三个关键组件:布局感知块分区、协同规划和协同决策。实验结果表明,CORE在多种移动应用和任务中将UI暴露减少了高达55.6%,同时任务成功率略低于仅使用云的代理,有效降低了对云的隐私暴露。

🔬 方法详解

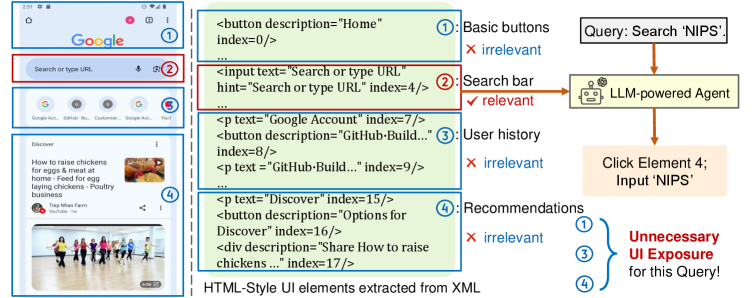

问题定义:本文旨在解决移动代理在使用大型语言模型时的UI暴露问题。现有方法依赖云LLMs上传完整UI状态,导致隐私泄露,而地方LLMs虽然避免上传,但能力有限,影响任务成功率。

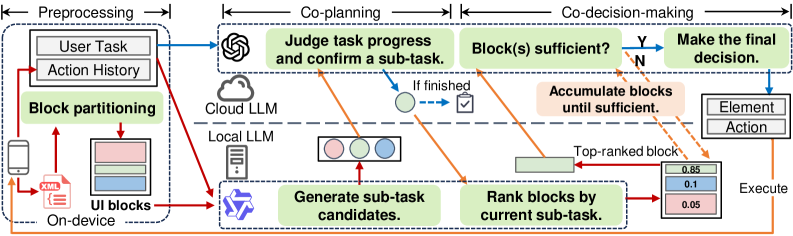

核心思路:CORE框架通过结合云和地方LLMs的优势,采用协作方式来减少UI暴露,同时保持任务的准确性。通过布局感知分区和协同决策,优化信息传递和处理。

技术框架:CORE框架由三个主要模块组成:1) 布局感知块分区,将UI元素根据XML层次结构进行分组;2) 协同规划,地方和云LLMs共同识别当前子任务;3) 协同决策,地方LLM对相关UI块进行排序,云LLM选择排名最高块中的具体UI元素。此外,CORE引入多轮累积机制,以减轻地方LLM的误判或上下文限制。

关键创新:CORE的主要创新在于其协作框架,通过结合云和地方LLMs的优点,显著减少了UI暴露,同时保持了任务的高准确性。这种设计与传统的单一LLM方法本质上不同。

关键设计:在设计中,布局感知块分区通过XML层次结构优化UI元素的分组,协同决策中地方LLM的排序机制确保了信息的相关性,云LLM的选择过程则保证了任务执行的精确性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,CORE框架在多种移动应用和任务中将UI暴露减少了高达55.6%,同时任务成功率仅略低于使用云LLMs的代理。这一成果有效展示了CORE在隐私保护与任务执行之间的平衡能力。

🎯 应用场景

CORE框架具有广泛的应用潜力,尤其是在需要保护用户隐私的移动应用场景中,如金融、医疗和社交媒体等领域。通过减少不必要的UI信息上传,CORE能够有效降低用户数据泄露的风险,同时保持高效的任务执行能力,未来可能推动更多隐私保护技术的发展。

📄 摘要(原文)

Mobile agents rely on Large Language Models (LLMs) to plan and execute tasks on smartphone user interfaces (UIs). While cloud-based LLMs achieve high task accuracy, they require uploading the full UI state at every step, exposing unnecessary and often irrelevant information. In contrast, local LLMs avoid UI uploads but suffer from limited capacity, resulting in lower task success rates. We propose $\textbf{CORE}$, a $\textbf{CO}$llaborative framework that combines the strengths of cloud and local LLMs to $\textbf{R}$educe UI $\textbf{E}$xposure, while maintaining task accuracy for mobile agents. CORE comprises three key components: (1) $\textbf{Layout-aware block partitioning}$, which groups semantically related UI elements based on the XML screen hierarchy; (2) $\textbf{Co-planning}$, where local and cloud LLMs collaboratively identify the current sub-task; and (3) $\textbf{Co-decision-making}$, where the local LLM ranks relevant UI blocks, and the cloud LLM selects specific UI elements within the top-ranked block. CORE further introduces a multi-round accumulation mechanism to mitigate local misjudgment or limited context. Experiments across diverse mobile apps and tasks show that CORE reduces UI exposure by up to 55.6% while maintaining task success rates slightly below cloud-only agents, effectively mitigating unnecessary privacy exposure to the cloud. The code is available at https://github.com/Entropy-Fighter/CORE.