Interpreting the Latent Structure of Operator Precedence in Language Models

作者: Dharunish Yugeswardeenoo, Harshil Nukala, Ved Shah, Cole Blondin, Sean O Brien, Vasu Sharma, Kevin Zhu

分类: cs.CL

发布日期: 2025-10-14 (更新: 2025-11-01)

备注: 11 pages, 6 figures. An earlier version of this work was accepted to CoLM 2024. This is an extended version of our CoLM 2024 paper. Includes additional ablations; added Ved Shah as author for those contributions

💡 一句话要点

研究LLM内部如何编码算术运算优先级,揭示中间计算过程。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 算术运算 运算优先级 可解释性 残差流

📋 核心要点

- 现有研究主要关注LLM算术能力的输出结果和提示策略,忽略了模型内部如何进行算术计算。

- 本文通过分析LLM的残差流,探究模型是否以及如何在其内部表示中编码算术运算优先级。

- 实验结果表明,LLM的残差流中存在中间计算结果,且模型在线性地编码运算符的优先级。

📝 摘要(中文)

大型语言模型(LLM)在推理能力方面表现出色,但在算术任务中仍然存在困难。以往的研究主要集中在输出或提示策略上,而模型进行算术计算的内部结构仍然是一个开放的问题。本文通过开源的指令微调LLaMA 3.2-3B模型,研究LLM是否在其内部表示中编码了算术运算优先级。我们构建了一个包含三个操作数和两个运算符的算术表达式数据集,并改变了括号的顺序和位置。使用该数据集,我们追踪指令微调LLaMA 3.2-3B模型的残差流中是否出现中间结果。我们应用了解释性技术,如logit lens、线性分类探针和UMAP几何可视化。结果表明,中间计算存在于残差流中,尤其是在MLP块之后。我们还发现,模型在线性地编码每个运算符在注意力层之后的嵌入中的优先级。我们引入了部分嵌入交换,这是一种通过交换运算符之间的高影响嵌入维度来修改运算符优先级的技术。

🔬 方法详解

问题定义:现有研究对于LLM算术能力的理解主要集中在输入输出层面,缺乏对模型内部计算过程的深入分析。因此,本文旨在探究LLM在进行算术运算时,是否以及如何在其内部表示中编码运算符的优先级。现有方法无法有效解释LLM内部的算术计算机制。

核心思路:本文的核心思路是通过构建特定的算术表达式数据集,并利用可解释性技术(如logit lens、线性分类探针和UMAP可视化)来追踪LLM在处理这些表达式时,其内部表示(特别是残差流)的变化。通过分析这些变化,可以推断出模型是否以及如何编码运算符的优先级。

技术框架:本文的技术框架主要包括以下几个步骤:1) 构建包含三个操作数和两个运算符的算术表达式数据集,并控制括号的位置以改变运算优先级;2) 使用指令微调的LLaMA 3.2-3B模型处理这些表达式;3) 追踪模型在处理过程中残差流的变化;4) 应用logit lens、线性分类探针和UMAP可视化等可解释性技术分析残差流中的信息,以确定模型是否编码了运算符优先级;5) 提出部分嵌入交换技术,通过修改运算符的嵌入来验证优先级编码的有效性。

关键创新:本文的关键创新在于:1) 首次深入研究了LLM内部如何编码算术运算优先级;2) 提出了部分嵌入交换技术,通过修改运算符的嵌入来验证优先级编码的有效性;3) 结合多种可解释性技术,对LLM的内部计算过程进行了细致的分析。

关键设计:在数据集构建方面,精心设计了算术表达式,控制括号的位置以改变运算优先级。在模型选择方面,选择了开源的指令微调LLaMA 3.2-3B模型。在可解释性技术方面,结合使用了logit lens、线性分类探针和UMAP可视化等多种方法。部分嵌入交换技术通过交换运算符之间高影响的嵌入维度来实现优先级修改。

🖼️ 关键图片

📊 实验亮点

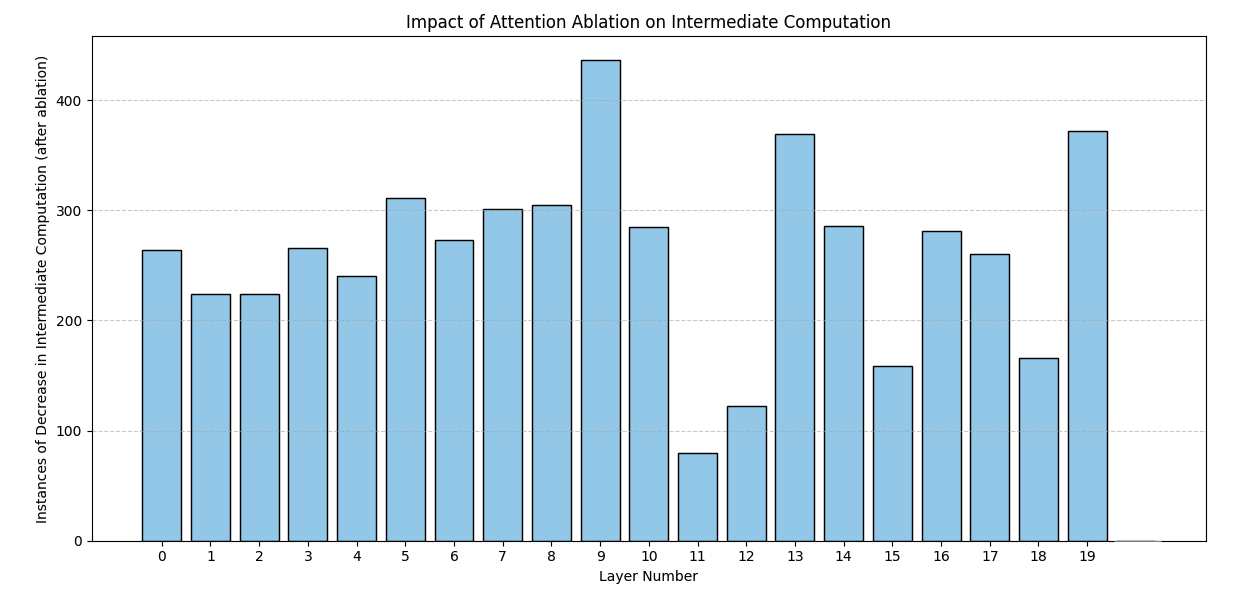

实验结果表明,LLM的残差流中存在中间计算结果,尤其是在MLP块之后。模型在线性地编码每个运算符在注意力层之后的嵌入中的优先级。通过部分嵌入交换技术,可以有效地修改运算符的优先级,验证了模型内部优先级编码的有效性。具体性能数据和提升幅度未知。

🎯 应用场景

该研究有助于深入理解LLM的内部工作机制,为提升LLM的算术能力和推理能力提供理论基础。此外,该研究提出的可解释性分析方法可以应用于其他类型的任务,帮助研究人员更好地理解和改进LLM。未来,可以基于该研究开发更高效、更可靠的算术计算模型。

📄 摘要(原文)

Large Language Models (LLMs) have demonstrated impressive reasoning capabilities but continue to struggle with arithmetic tasks. Prior works largely focus on outputs or prompting strategies, leaving the open question of the internal structure through which models do arithmetic computation. In this work, we investigate whether LLMs encode operator precedence in their internal representations via the open-source instruction-tuned LLaMA 3.2-3B model. We constructed a dataset of arithmetic expressions with three operands and two operators, varying the order and placement of parentheses. Using this dataset, we trace whether intermediate results appear in the residual stream of the instruction-tuned LLaMA 3.2-3B model. We apply interpretability techniques such as logit lens, linear classification probes, and UMAP geometric visualization. Our results show that intermediate computations are present in the residual stream, particularly after MLP blocks. We also find that the model linearly encodes precedence in each operator's embeddings post attention layer. We introduce partial embedding swap, a technique that modifies operator precedence by exchanging high-impact embedding dimensions between operators.