A Survey on Collaborating Small and Large Language Models for Performance, Cost-effectiveness, Cloud-edge Privacy, and Trustworthiness

作者: Fali Wang, Jihai Chen, Shuhua Yang, Ali Al-Lawati, Linli Tang, Hui Liu, Suhang Wang

分类: cs.CL, cs.AI

发布日期: 2025-10-14 (更新: 2025-11-05)

备注: 24 pages, 19 figures-under review; more detailed than v1

🔗 代码/项目: GITHUB

💡 一句话要点

综述小型与大型语言模型协同,提升性能、降低成本、保障隐私与可信性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 小型语言模型 协同学习 知识蒸馏 联邦学习 模型压缩 边缘计算 隐私保护

📋 核心要点

- 大型语言模型面临高昂的微调成本、推理延迟和边缘部署限制,小型语言模型则在效率和适应性方面具有优势。

- 论文核心思想是探索SLM和LLM的协同框架,结合SLM的专业性和LLM的泛化能力,以实现性能、成本、隐私和可信性等多重目标。

- 该综述系统地回顾了SLM-LLM协同的代表性方法,总结了设计范式,并指出了未来研究方向,为相关研究提供了指导。

📝 摘要(中文)

大型语言模型(LLMs)在各个领域和应用中取得了显著进展,但也面临着微调成本高、推理延迟长、边缘部署受限以及可靠性等挑战。小型语言模型(SLMs)具有紧凑、高效和适应性强的特点,为解决这些问题提供了有希望的方案。最近的研究探索了整合SLM和LLM互补优势的协同框架,利用SLM的专业化和效率以及LLM的泛化和推理能力,以应对跨任务和部署场景的多样化目标。鉴于这些发展,本文从协同目标角度对SLM-LLM协同进行了系统综述。我们提出了一个涵盖四个目标的分类法:性能增强、成本效益、云边隐私和可信性。在此框架下,我们回顾了代表性方法,总结了设计范式,并概述了高效和安全的SLM-LLM协同所面临的开放挑战和未来方向。收集的论文可在https://github.com/FairyFali/SLMs-Survey上找到。

🔬 方法详解

问题定义:现有的大型语言模型虽然性能强大,但在微调、推理和部署方面存在诸多限制,例如计算资源消耗大、延迟高、难以在边缘设备上运行等。小型语言模型虽然效率高,但性能相对较弱。因此,如何有效地结合两者的优势,在性能、成本、隐私和可信性之间取得平衡,是一个重要的研究问题。

核心思路:论文的核心思路是探索小型语言模型(SLM)和大型语言模型(LLM)的协同工作模式,充分利用SLM的效率和LLM的泛化能力。通过合理的设计,使SLM能够辅助LLM完成特定任务,或者在LLM的基础上进行知识蒸馏,从而在降低成本的同时,提升整体性能和安全性。

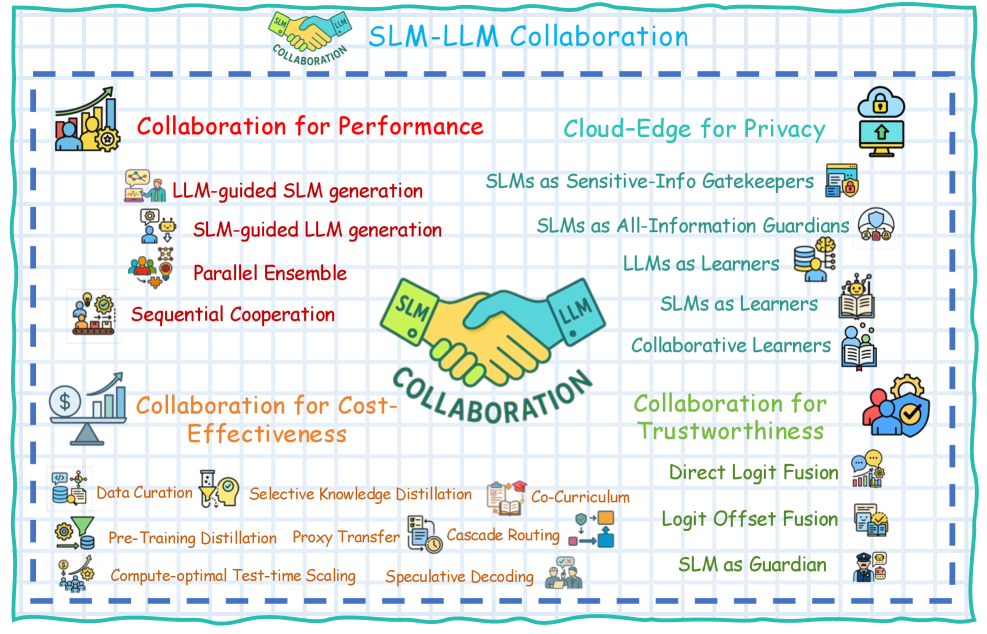

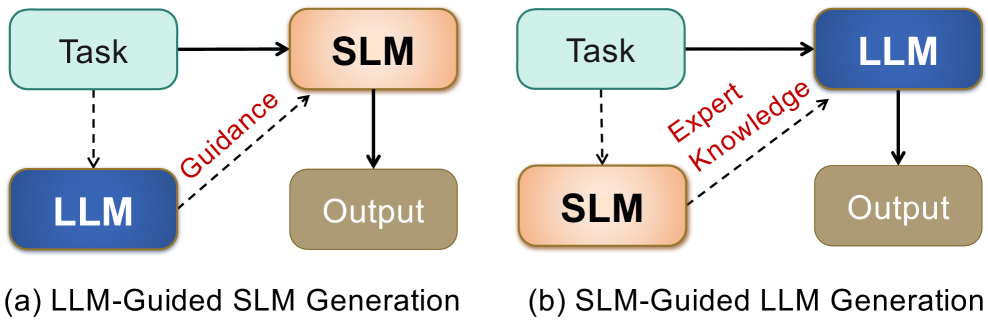

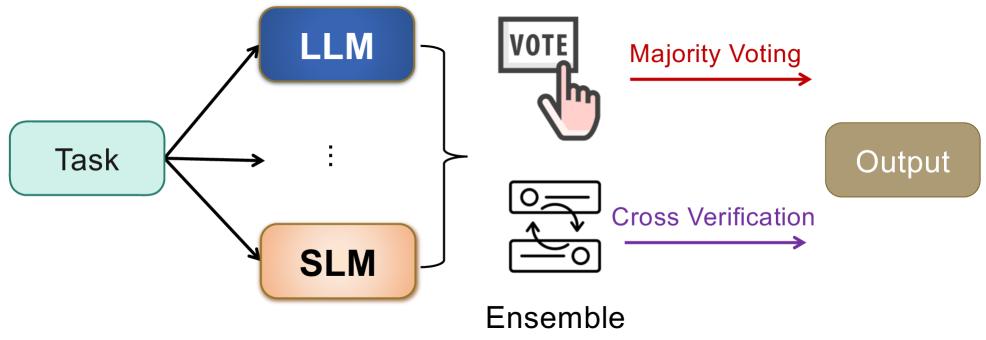

技术框架:论文将SLM-LLM协同的目标分为四个方面:性能增强、成本效益、云边隐私和可信性。针对每个目标,论文回顾了相关的研究工作,并总结了不同的设计范式。例如,在性能增强方面,可以采用知识蒸馏、模型融合等方法;在成本效益方面,可以采用模型压缩、量化等技术;在云边隐私方面,可以采用联邦学习、差分隐私等方法。

关键创新:该论文的主要创新在于对SLM-LLM协同的研究进行了系统性的分类和总结,提出了一个包含四个目标的分类框架,并对每个目标下的代表性方法进行了详细的分析。此外,论文还指出了当前研究的开放挑战和未来发展方向,为后续研究提供了有价值的参考。

关键设计:论文中涉及的关键设计包括:针对不同任务选择合适的SLM和LLM;设计有效的知识蒸馏方法,将LLM的知识迁移到SLM;采用合适的模型压缩和量化技术,降低模型的计算复杂度和存储空间;利用联邦学习和差分隐私等技术,保护用户数据的隐私;设计可信的评估指标,评估SLM-LLM协同系统的可靠性和安全性。

🖼️ 关键图片

📊 实验亮点

该综述总结了现有SLM-LLM协同研究的成果,并提出了一个包含四个目标的分类框架,为后续研究提供了指导。论文收集了大量相关论文,并进行了详细的分析和比较。此外,论文还指出了当前研究的开放挑战和未来发展方向,例如如何设计更有效的知识蒸馏方法,如何保护用户数据的隐私,如何提高系统的可信性等。

🎯 应用场景

该研究成果可应用于多种场景,如智能客服、自动驾驶、边缘计算等。通过SLM-LLM协同,可以在资源受限的环境下部署高性能的语言模型,降低计算成本,保护用户隐私,并提高系统的可靠性。例如,在智能客服中,可以使用SLM处理常见问题,LLM处理复杂问题,从而提高响应速度和准确率。在自动驾驶中,可以使用SLM进行实时决策,LLM进行全局规划,从而提高驾驶安全性和效率。

📄 摘要(原文)

Large language models (LLMs) have achieved remarkable progress across domains and applications but face challenges such as high fine-tuning costs, inference latency, limited edge deployability, and reliability concerns. Small language models (SLMs), with compact, efficient, and adaptable features, offer promising solutions. Building on this potential, recent research explores collaborative frameworks that integrate their complementary strengths, leveraging SLMs' specialization and efficiency with LLMs' generalization and reasoning to address diverse objectives across tasks and deployment scenarios. Motivated by these developments, this paper presents a systematic survey of SLM-LLM collaboration from the perspective of collaboration objectives. We propose a taxonomy covering four goals: performance enhancement, cost-effectiveness, cloud-edge privacy, and trustworthiness. Under this framework, we review representative methods, summarize design paradigms, and outline open challenges and future directions toward efficient and secure SLM-LLM collaboration. The collected papers are available at https://github.com/FairyFali/SLMs-Survey.