EduDial: Constructing a Large-scale Multi-turn Teacher-Student Dialogue Corpus

作者: Shouang Wei, Min Zhang, Xin Lin, Bo Jiang, Zhongxiang Dai, Kun Kuang

分类: cs.CL

发布日期: 2025-10-14

🔗 代码/项目: GITHUB

💡 一句话要点

构建大规模师生对话语料库EduDial,提升LLM在教育场景下的教学能力

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 师生对话 教育领域 大型语言模型 对话数据集 差异化教学

📋 核心要点

- 现有对话基准缺乏对师生互动场景的针对性,难以有效评估LLM在教育领域的应用能力。

- 构建EduDial数据集,模拟真实课堂互动,并设计差异化教学策略,提升LLM的教学质量。

- 实验表明,EduDial-LLM在教学质量和内容质量上均显著优于其他LLM,验证了该方法的有效性。

📝 摘要(中文)

本文提出了EduDial,一个全面的师生多轮对话数据集。EduDial覆盖了345个核心知识点,包含34250个由师生智能体交互生成的对话会话。其设计遵循布鲁姆教育目标分类法,并融入了情境式提问、最近发展区提问和元认知提问等十种提问策略,从而更好地捕捉真实的课堂互动。此外,针对不同认知水平的学生,设计了差异化的教学策略,提供更具针对性的教学指导。基于EduDial,进一步训练了EduDial-LLM 32B,并提出了一个11维的评估框架,系统地衡量LLM的教学能力,包括整体教学质量和内容质量。在17个主流LLM上的实验表明,大多数模型在以学生为中心的教学场景中表现不佳,而EduDial-LLM取得了显著的提升,在所有指标上始终优于所有基线模型。

🔬 方法详解

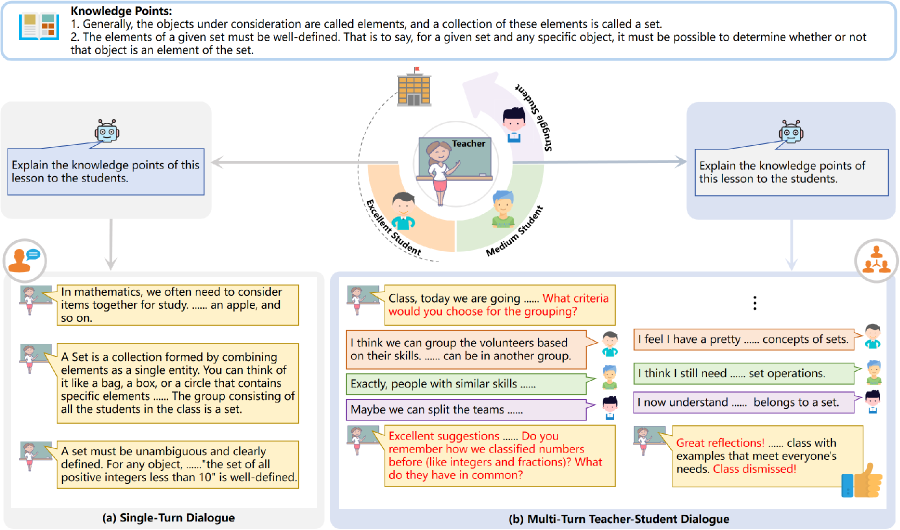

问题定义:现有的大型语言模型(LLMs)在通用对话任务上表现出色,但在教育领域,特别是师生互动场景下的应用仍面临挑战。现有的对话数据集通常缺乏对教学目标的明确指导,难以模拟真实的课堂互动,并且忽略了学生认知水平的差异,导致LLMs难以提供个性化的教学指导。因此,如何构建一个能够反映真实课堂互动、并支持差异化教学的师生对话数据集,是本文要解决的关键问题。

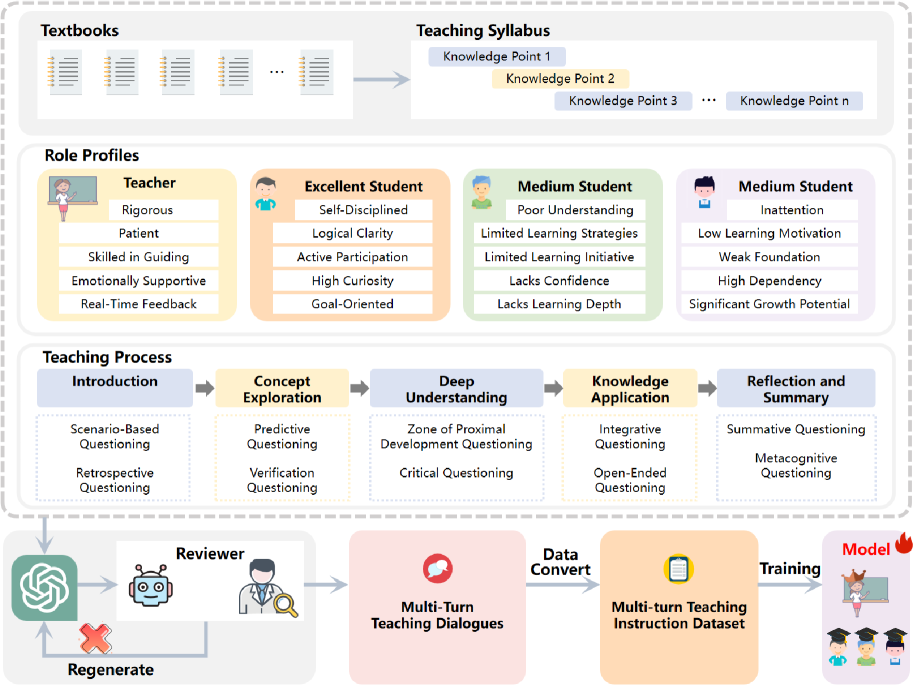

核心思路:本文的核心思路是构建一个高质量的师生对话数据集EduDial,该数据集的设计遵循布鲁姆教育目标分类法,并融入了多种提问策略,以模拟真实的课堂互动。同时,针对不同认知水平的学生,设计了差异化的教学策略,从而使LLMs能够提供更具针对性的教学指导。通过在EduDial上训练LLM,可以显著提升其在教育场景下的教学能力。

技术框架:EduDial的构建主要包括以下几个阶段:1) 知识点选择:选择345个核心知识点作为教学内容。2) 师生智能体设计:设计教师和学生智能体,教师智能体负责提供教学指导,学生智能体负责提出问题和反馈。3) 对话生成:通过教师和学生智能体的交互,生成多轮对话会话。4) 差异化教学策略:针对不同认知水平的学生,设计不同的教学策略,例如,对于认知水平较低的学生,提供更详细的解释和示例。5) 评估框架:设计一个11维的评估框架,用于系统地衡量LLM的教学能力。

关键创新:本文的关键创新点在于:1) 构建了一个大规模的师生对话数据集EduDial,该数据集的设计遵循布鲁姆教育目标分类法,并融入了多种提问策略,从而更好地捕捉真实的课堂互动。2) 提出了差异化的教学策略,针对不同认知水平的学生,提供更具针对性的教学指导。3) 设计了一个11维的评估框架,用于系统地衡量LLM的教学能力。与现有方法相比,EduDial更注重模拟真实的课堂互动,并支持差异化教学,从而使LLMs能够提供更个性化的教学指导。

关键设计:在对话生成过程中,采用了十种提问策略,包括情境式提问、最近发展区提问和元认知提问等。针对不同认知水平的学生,采用了不同的教学策略,例如,对于认知水平较低的学生,提供更详细的解释和示例,并采用更简单的语言。在评估框架中,考虑了整体教学质量和内容质量两个方面,并设计了11个维度来衡量LLM的教学能力。

🖼️ 关键图片

📊 实验亮点

实验结果表明,EduDial-LLM在17个主流LLM中表现最佳,在所有指标上均优于所有基线模型。例如,在整体教学质量方面,EduDial-LLM的得分显著高于其他模型,表明其能够提供更有效的教学指导。此外,在内容质量方面,EduDial-LLM也取得了显著的提升,表明其能够更准确地传达知识。

🎯 应用场景

该研究成果可应用于智能教育领域,例如,构建智能辅导系统,为学生提供个性化的学习指导。此外,该数据集和评估框架也可用于评估和提升LLM在教育领域的应用能力,推动智能教育的发展。未来,可以将该方法扩展到其他学科和教育场景,例如,职业培训和终身学习。

📄 摘要(原文)

Recently, several multi-turn dialogue benchmarks have been proposed to evaluate the conversational abilities of large language models (LLMs). As LLMs are increasingly recognized as a key technology for advancing intelligent education, owing to their ability to deeply understand instructional contexts and provide personalized guidance, the construction of dedicated teacher-student dialogue benchmarks has become particularly important. To this end, we present EduDial, a comprehensive multi-turn teacher-student dialogue dataset. EduDial covers 345 core knowledge points and consists of 34,250 dialogue sessions generated through interactions between teacher and student agents. Its design is guided by Bloom's taxonomy of educational objectives and incorporates ten questioning strategies, including situational questioning, zone of proximal development (ZPD) questioning, and metacognitive questioning-thus better capturing authentic classroom interactions. Furthermore, we design differentiated teaching strategies for students at different cognitive levels, thereby providing more targeted teaching guidance. Building on EduDial, we further develop EduDial-LLM 32B via training and propose an 11-dimensional evaluation framework that systematically measures the teaching abilities of LLMs, encompassing both overall teaching quality and content quality. Experiments on 17 mainstream LLMs reveal that most models struggle in student-centered teaching scenarios, whereas our EduDial-LLM achieves significant gains, consistently outperforming all baselines across all metrics. The code is available at https://github.com/Mind-Lab-ECNU/EduDial/tree/main.