DPO-Tuned Large Language Models for Segmentation in Simultaneous Speech Translation

作者: Zeyu Yang, Satoshi Nakamura

分类: cs.CL

发布日期: 2025-10-14

💡 一句话要点

提出基于DPO微调的大语言模型,用于提升同声传译中的语音分割质量

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 同声传译 语音分割 大语言模型 直接偏好优化 DPO 实时翻译 偏好对齐

📋 核心要点

- 现有同声传译语音分割模型受限于监督学习目标,缺乏人类偏好对齐,影响实时翻译的自然性。

- 提出基于DPO微调的大语言模型,通过偏好对齐,预测更符合人类习惯的自然分割点。

- 实验表明,该方法在分割精度、翻译质量和延迟方面均优于现有模型,提升了同声传译性能。

📝 摘要(中文)

同声传译需要精确的语音分割,以平衡翻译质量和延迟。近期的研究,如SHAS,引入了预训练的分割模型,获得了比启发式规则更强的性能。然而,像SHAS这样的分割模型,尽管经过预训练且比启发式方法更鲁棒,仍然受到监督学习目标的约束,并且没有结合人类偏好对齐,这对于自然的实时翻译至关重要。在这项工作中,我们提出了一个基于大语言模型(LLM)的分割框架,该框架使用直接偏好优化(DPO)进行训练。通过利用偏好对齐,我们的方法使LLM能够预测更自然的分割点,从而更好地满足实时翻译的需求。我们在ACL 60/60语料库上,针对三个语言对(英语-日语、中文、德语)评估了该系统,使用SeamlessM4T v2作为翻译骨干。实验结果表明,我们DPO微调的LLM实现了比SHAS更高的分割准确率,并在翻译质量(BLEU、COMET)和延迟(平均滞后)方面产生了持续的改进。此外,我们的系统受益于IWSLT基线,可用于直接比较。这些发现突出了偏好调整的LLM超越现有预训练分割模型的潜力,并推进自适应、人类对齐的同声传译。

🔬 方法详解

问题定义:论文旨在解决同声传译中语音分割不准确的问题。现有的语音分割模型,例如SHAS,虽然使用了预训练技术,但仍然依赖于监督学习,无法很好地捕捉人类的偏好,导致分割结果不够自然,影响同声传译的质量和流畅性。

核心思路:论文的核心思路是利用大语言模型(LLM)强大的语言建模能力,并通过直接偏好优化(DPO)进行微调,使LLM能够学习人类对于语音分割的偏好。DPO方法允许模型直接从人类的偏好数据中学习,而无需显式地定义奖励函数,从而更好地对齐人类的意图。

技术框架:该框架主要包含以下几个步骤:1) 使用大语言模型作为分割模型的基础;2) 构建包含人类偏好的数据集,例如,对于同一个语音片段,标注者会给出不同的分割方案,并对这些方案进行排序;3) 使用DPO算法,根据人类偏好数据对LLM进行微调,使模型能够预测更符合人类偏好的分割点;4) 将分割后的语音片段输入到翻译模型(例如SeamlessM4T v2)中进行翻译。

关键创新:该论文的关键创新在于将直接偏好优化(DPO)应用于同声传译的语音分割任务。与传统的监督学习方法相比,DPO能够更好地学习人类的偏好,从而生成更自然的分割结果。此外,利用大语言模型的强大能力,可以更好地理解语音的上下文信息,从而做出更准确的分割决策。

关键设计:DPO的损失函数旨在最大化模型对人类偏好分割结果的打分,同时最小化对非偏好分割结果的打分。具体的参数设置包括DPO的学习率、batch size等。此外,论文还可能探索了不同的LLM架构和规模,以及不同的偏好数据构建方法。

🖼️ 关键图片

📊 实验亮点

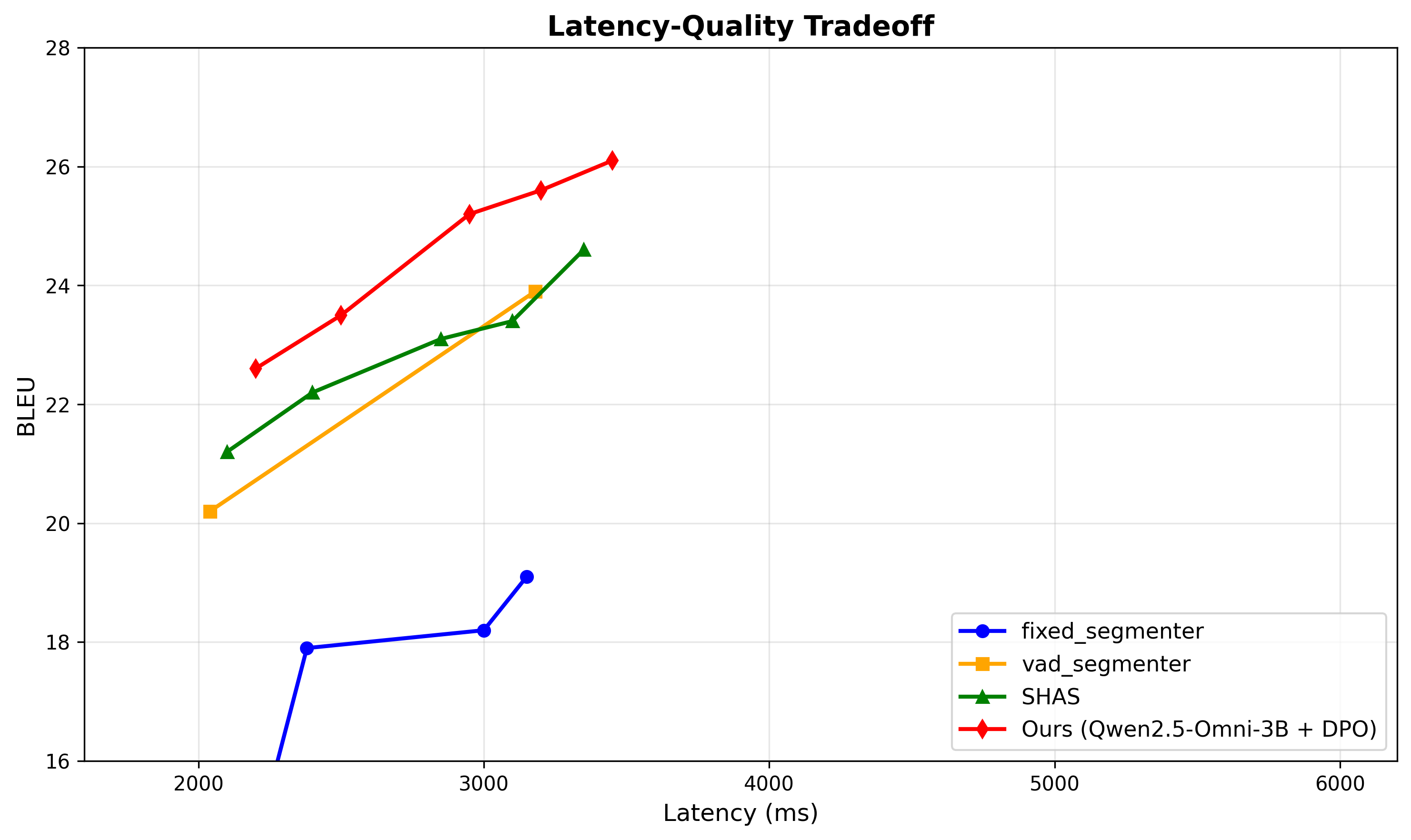

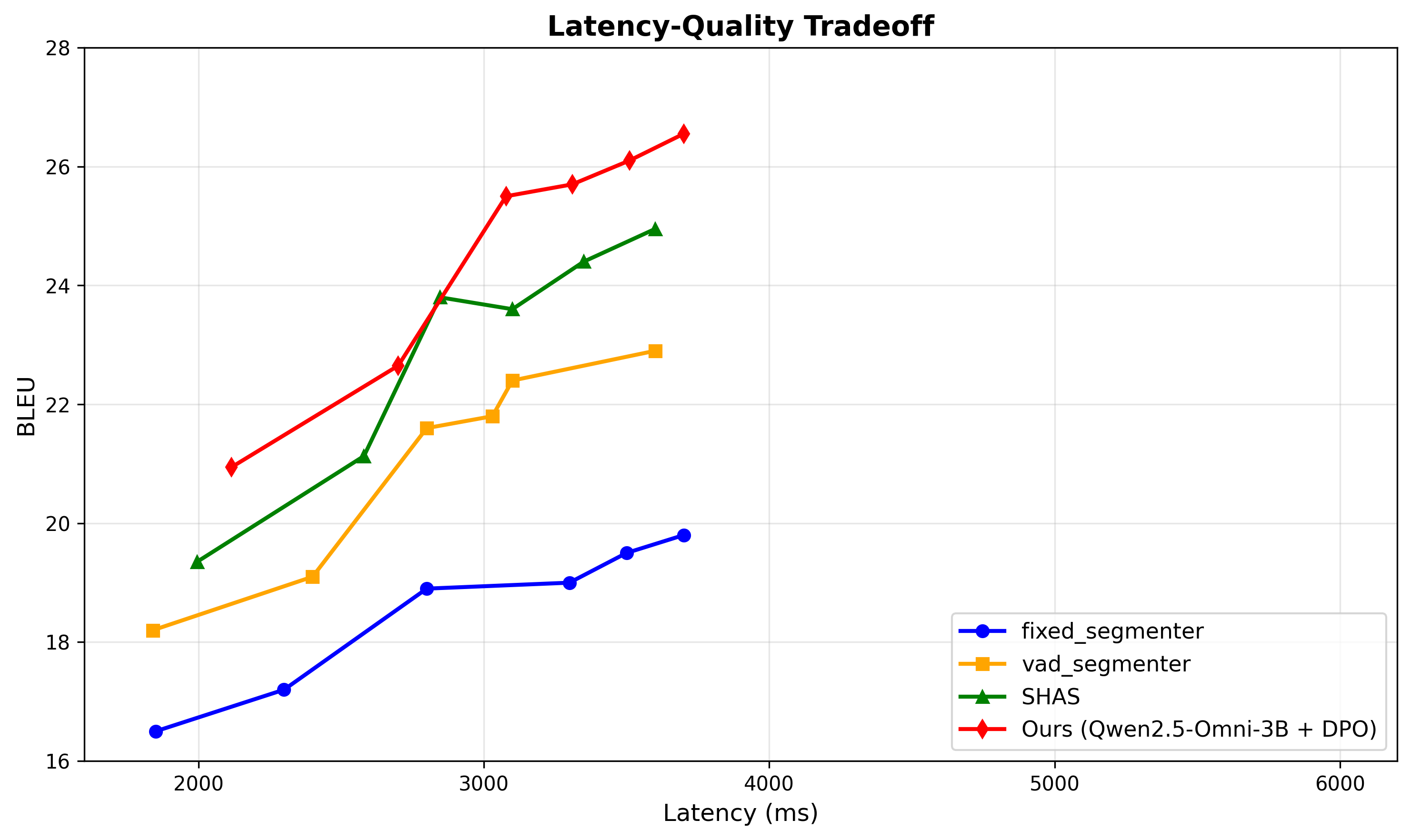

实验结果表明,DPO微调的LLM在ACL 60/60语料库上,针对英语-日语、中文、德语三个语言对,实现了比SHAS更高的分割准确率。同时,在翻译质量(BLEU、COMET)和延迟(平均滞后)方面也取得了持续的改进。该系统还与IWSLT基线进行了比较,进一步验证了其优越性。

🎯 应用场景

该研究成果可应用于各种同声传译系统和实时语音翻译应用中,例如国际会议、在线课程、跨国商务谈判等。通过提高语音分割的准确性和自然性,可以显著提升同声传译的质量和用户体验,促进跨语言交流和理解。未来,该技术还可以扩展到其他语音处理任务,如语音识别和语音合成。

📄 摘要(原文)

Simultaneous speech translation requires accurate segmentation to balance translation quality and latency. Recent studies such as SHAS have introduced pretrained segmentation models, achieving stronger performance than heuristic rules. However, segmentation models such as SHAS, though pretrained and more robust than heuristic methods, are still constrained by supervised learning objectives and do not incorporate human preference alignment, which is crucial for natural real-time interpretation. In this work, we propose a segmentation framework based on large language models (LLMs) trained with Direct Preference Optimization (DPO). By leveraging preference alignment, our method enables LLMs to predict natural segmentation points that better meet the demands of real-time translation. We evaluate the system on the ACL 60/60 corpus across three language pairs (English-Japanese, Chinese, German), using SeamlessM4T v2 as the translation backbone. Experimental results show that our DPO-tuned LLM achieves higher segmentation accuracy than SHAS and yields consistent improvements in translation quality (BLEU, COMET) as well as latency (Average Lagging). Furthermore, our system benefits from IWSLT baselines for direct comparison. These findings highlight the potential of preference-tuned LLMs to surpass existing pretrained segmentation models and advance adaptive, human-aligned simultaneous interpretation.