Towards Inference-time Scaling for Continuous Space Reasoning

作者: Minghan Wang, Thuy-Trang Vu, Ehsan Shareghi, Gholamreza Haffari

分类: cs.CL

发布日期: 2025-10-14 (更新: 2025-10-17)

备注: Submitted to AAAI 2026 on July 25, 2025. Under review

💡 一句话要点

探索推理时缩放技术在连续空间推理中的应用与挑战

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 连续空间推理 推理时缩放 奖励模型 归纳偏置 轨迹分析

📋 核心要点

- 现有基于文本的推理时缩放技术在连续空间推理中的适用性有待考察,面临着独特的挑战。

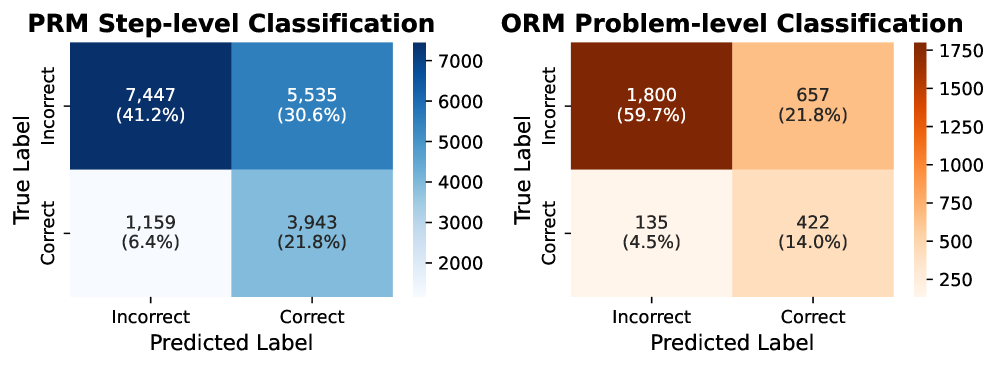

- 该研究探索了基于dropout的采样方法,生成多样化的连续空间推理路径,并尝试利用PRM/ORM进行重排序。

- 实验表明,直接将离散空间的PRM/ORM方法应用于连续空间推理效果不佳,需要更深入地理解连续空间表示。

📝 摘要(中文)

本文研究了在大型语言模型中,通过多样本生成并结合过程或结果奖励模型(PRM或ORM)重排序的推理时缩放技术,是否能成功应用于连续空间推理。该研究以COCONUT连续空间推理LM为基础,验证了基于dropout的采样生成多样推理路径的可行性。Pass@N分析表明,生成的样本具有实现类似离散空间性能增益的潜力。然而,研究强调了在连续思想空间中实现这一增益所面临的独特挑战。离散空间中有效的数据生成和PRM/ORM模型训练方法在连续空间中仅带来边际改进。通过探测几何属性和轨迹动态等多个方面,研究揭示了阻碍有效区分正确和错误推理的根本原因,即连续思想表示中缺乏关键的归纳偏置。研究认为,连续推理LM的训练框架不仅需要优化准确性,还需要显式地结合归纳偏置,以便在推理时区分正确和错误的思想。

🔬 方法详解

问题定义:论文旨在研究推理时缩放技术,特别是通过多样本生成和奖励模型重排序,在连续空间推理中的有效性。现有方法在离散空间(如文本推理)表现良好,但直接应用于连续空间时效果不佳,这表明连续空间推理存在独特的挑战,需要专门的解决方案。

核心思路:核心思路是借鉴离散空间推理的成功经验,尝试将推理时缩放技术应用于连续空间推理。具体来说,通过生成多个推理路径,并利用奖励模型对这些路径进行排序,从而提高推理的准确性。研究重点在于理解为什么在离散空间有效的技术在连续空间失效,并探索可能的改进方向。

技术框架:整体框架包括三个主要步骤:1) 使用连续空间推理LM(COCONUT)生成多个推理路径,通过dropout采样实现路径的多样性。2) 训练过程奖励模型(PRM)和结果奖励模型(ORM),用于评估每个推理路径的质量。3) 使用PRM/ORM对生成的推理路径进行重排序,选择得分最高的路径作为最终结果。研究还深入分析了连续空间推理轨迹的几何属性和动态特性,以理解PRM/ORM失效的原因。

关键创新:该研究的关键创新在于对连续空间推理的深入分析,揭示了连续思想表示中缺乏关键归纳偏置的问题。这与离散空间推理有本质区别,因为离散空间推理通常具有更强的结构化约束。研究强调,未来的连续空间推理模型不仅需要优化准确性,还需要显式地引入归纳偏置,以便更好地进行推理和判别。

关键设计:在dropout采样方面,研究探索了不同的dropout率,以控制生成路径的多样性。在PRM/ORM训练方面,研究尝试了不同的损失函数和网络结构,但效果均不理想。研究还设计了一系列探针实验,用于分析连续空间推理轨迹的几何属性(如曲率、长度)和动态特性(如速度、加速度),以理解PRM/ORM的判别能力。

🖼️ 关键图片

📊 实验亮点

实验结果表明,直接将离散空间的PRM/ORM方法应用于连续空间推理只能带来边际改进。通过对连续空间推理轨迹的深入分析,研究发现连续思想表示中缺乏关键的归纳偏置,这是导致PRM/ORM失效的主要原因。Pass@N分析表明,如果能够有效地利用生成的多个推理路径,连续空间推理的性能有很大的提升潜力。

🎯 应用场景

该研究成果可应用于机器人导航、运动规划、物理模拟等领域,提升连续空间推理任务的性能和鲁棒性。通过引入合适的归纳偏置,可以使模型更好地理解和利用连续空间中的信息,从而实现更智能、更可靠的决策。

📄 摘要(原文)

Inference-time scaling through multiple sample generation in combination with Process- or Outcome-Reward Model (PRM or ORM) re-ranking has proven effective for text-based reasoning in large language models. This paper investigates whether such established techniques can be successfully adapted to reasoning in the continuous space, using COCONUT (Hao et al. 2024) continuous space reasoning LM as the backbone. We demonstrate the feasibility of generating diverse reasoning paths through dropout-based sampling. Our Pass@N analysis on the generated samples reveals the potential that could enable a significant gain in performance akin to observed gain in the discrete space. However, we highlight unique challenges faced for materializing this gain in the continuous thought space. In particular, working recipes for data generation and training PRM and ORM models in the discrete space unlocks only marginal improvements in the continuous space. Through probing various aspects including geometric properties and trajectory dynamics we identify the underlying reasons that prevent effective discrimination between correct and incorrect reasoning (essential for the functioning of PRM and ORM). Our findings reveal that current limitations stem from the absence of key inductive biases in continuous thought representations. We argue that the training frameworks for continuous reasoning LMs require not only to optimize for accuracy but also to explicitly incorporate inductive biases that could be utilized during inference-time for discrimination of correct and incorrect thoughts.\footnote{Our code and data will be publicly available.}