Credal Transformer: A Principled Approach for Quantifying and Mitigating Hallucinations in Large Language Models

作者: Shihao Ji, Zihui Song, Jiajie Huang

分类: cs.CL, cs.AI

发布日期: 2025-10-14

💡 一句话要点

提出Credal Transformer,通过不确定性建模缓解大语言模型的幻觉问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 幻觉 不确定性量化 证据理论 Credal注意力

📋 核心要点

- 现有大语言模型易产生幻觉,即生成错误但自信的答案,根本原因是Transformer的Softmax层丢弃了不确定性信息。

- Credal Transformer用Credal注意力机制取代标准注意力,生成代表不确定性的“credal集合”,从而量化模型的不确定性。

- 实验表明,Credal Transformer能有效识别异常输入,量化模糊性,并减少在无法回答问题上的自信错误。

📝 摘要(中文)

大型语言模型(LLMs)存在幻觉问题,即生成事实不正确但自信的断言。作者认为这源于Transformer的Softmax函数,它通过将模糊的注意力分数坍缩为单一概率分布来产生“人为确定性”,从而在每一层丢弃了不确定性信息。为了解决这个问题,作者提出了Credal Transformer,它用基于证据理论的Credal注意力机制(CAM)取代了标准注意力。CAM产生一个“credal集合”(一组分布),而不是单一的注意力向量,集合的大小直接衡量模型的不确定性。通过将注意力分数重新概念化为Dirichlet分布的证据质量来实现这一点:充分的证据恢复标准注意力,而不足的证据产生扩散分布,代表模糊性。实验表明,Credal Transformer可以识别超出分布的输入,量化模糊性,并通过弃权显著减少无法回答问题上的自信错误。该研究贡献了一种新的架构来缓解幻觉,以及一种将不确定性量化直接集成到模型中的设计范式,为更可靠的AI奠定了基础。

🔬 方法详解

问题定义:大语言模型(LLMs)的幻觉问题,即生成不真实但看似合理的答案。现有方法的痛点在于Transformer架构中的Softmax函数,它将注意力分数强制转化为单一概率分布,忽略了潜在的不确定性信息,导致模型过度自信。

核心思路:核心思路是引入Credal注意力机制(CAM),将注意力分数视为证据,并使用证据理论来建模不确定性。通过构建一个“credal集合”(一组概率分布)来表示模型对不同答案的置信度,集合的大小反映了模型的不确定性。

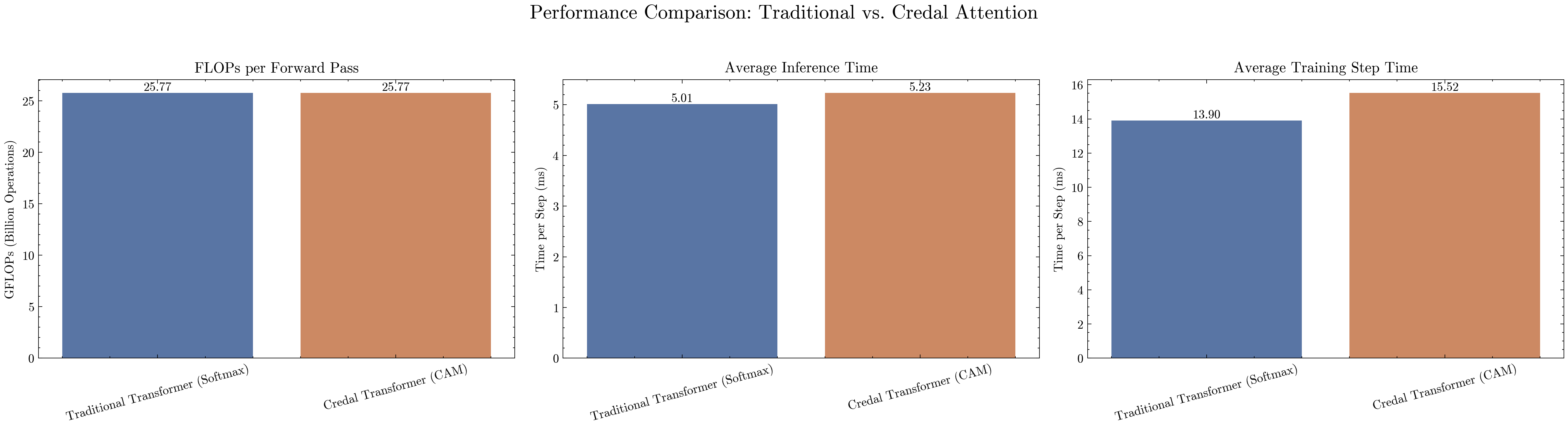

技术框架:Credal Transformer的整体架构与标准Transformer类似,主要区别在于注意力机制的实现。标准注意力机制被CAM取代,CAM将注意力分数转化为Dirichlet分布的参数,从而生成一个credal集合。该集合用于后续的加权求和,最终得到输出。

关键创新:最重要的创新点在于Credal注意力机制(CAM),它将注意力分数视为证据,并利用Dirichlet分布来建模不确定性。与标准注意力机制相比,CAM能够显式地表示模型的不确定性,并允许模型在不确定性较高时选择弃权。

关键设计:CAM的关键设计在于将注意力分数映射到Dirichlet分布的参数。具体来说,注意力分数被视为Dirichlet分布的证据质量,证据质量越高,分布越集中,代表模型越自信;证据质量越低,分布越分散,代表模型越不确定。此外,模型还引入了一个弃权机制,当模型的不确定性超过一定阈值时,选择不给出答案。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Credal Transformer在识别超出分布的输入方面表现出色,能够有效量化模型的不确定性。在无法回答的问题上,Credal Transformer通过弃权显著减少了自信错误,相比基线模型取得了显著的性能提升。具体数据未知,但结果表明该方法在缓解幻觉问题上具有潜力。

🎯 应用场景

该研究成果可应用于对可靠性要求高的自然语言处理任务,例如医疗诊断、金融分析和法律咨询等。通过量化和缓解大语言模型的幻觉,可以提高AI系统的可信度和安全性,并为构建更负责任的AI系统奠定基础。未来,该方法可以扩展到其他深度学习模型和任务中。

📄 摘要(原文)

Large Language Models (LLMs) hallucinate, generating factually incorrect yet confident assertions. We argue this stems from the Transformer's Softmax function, which creates "Artificial Certainty" by collapsing ambiguous attention scores into a single probability distribution, discarding uncertainty information at each layer. To fix this, we introduce the Credal Transformer, which replaces standard attention with a Credal Attention Mechanism (CAM) based on evidential theory. CAM produces a "credal set" (a set of distributions) instead of a single attention vector, with the set's size directly measuring model uncertainty. We implement this by re-conceptualizing attention scores as evidence masses for a Dirichlet distribution: sufficient evidence recovers standard attention, while insufficient evidence yields a diffuse distribution, representing ambiguity. Empirically, the Credal Transformer identifies out-of-distribution inputs, quantifies ambiguity, and significantly reduces confident errors on unanswerable questions by abstaining. Our contribution is a new architecture to mitigate hallucinations and a design paradigm that integrates uncertainty quantification directly into the model, providing a foundation for more reliable AI.