CPR: Mitigating Large Language Model Hallucinations with Curative Prompt Refinement

作者: Jung-Woo Shim, Yeong-Joon Ju, Ji-Hoon Park, Seong-Whan Lee

分类: cs.CL, cs.AI, cs.LG

发布日期: 2025-10-14

备注: 2024 IEEE International Conference on Systems, Man, and Cybernetics (SMC), 7 pages, 2 figures

期刊: 2024 IEEE International Conference on Systems, Man, and Cybernetics (SMC), Kuching, Malaysia, 2024, pp. 1604-1609

DOI: 10.1109/SMC54092.2024.10830938

💡 一句话要点

提出CPR框架,通过优化提示词缓解大语言模型幻觉问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 幻觉缓解 提示工程 提示优化 自然语言处理

📋 核心要点

- 大语言模型易受结构不良或模糊提示的影响,产生基于假设的错误信息,即“幻觉”。

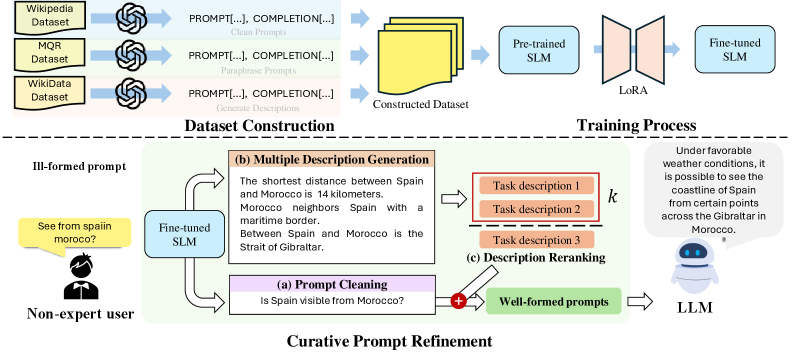

- CPR框架通过清理不良提示并生成补充信息,对齐用户意图与模型输入,从而缓解幻觉。

- 实验表明,CPR显著提升生成质量并减轻幻觉,应用CPR的提示胜率超过90%。

📝 摘要(中文)

大语言模型(LLM)的最新进展表明,它们能够流畅地生成对各种提示的响应。然而,这些模型有时会产生看似合理但不正确的“幻觉”事实,从而降低了信任度。 这种错误的常见但经常被忽视的原因是用户使用了结构不良或模糊的提示,导致LLM基于假设而非实际意图进行响应。 为了减轻由这些结构不良的提示引起的幻觉,我们引入了Curative Prompt Refinement(CPR),这是一个用于治疗性提示改进的即插即用框架,该框架1)清理结构不良的提示,以及2)生成额外的,信息丰富的任务描述,以使用微调的小型语言模型来对齐用户和提示的意图。 当应用于语言模型时,我们发现CPR显着提高了生成质量,同时也减轻了幻觉。 实证研究表明,应用CPR的提示比没有任何外部知识的原始提示实现了超过90%的胜率。

🔬 方法详解

问题定义:论文旨在解决大语言模型(LLM)中由于用户提供的提示(prompt)质量不高而导致的“幻觉”问题。现有的LLM容易受到结构不良或模糊的提示的影响,从而产生不准确或虚假的信息,降低了用户对模型的信任度。现有方法往往忽略了提示本身的问题,而是侧重于模型内部的知识增强或解码策略改进。

核心思路:CPR的核心思路是在将提示输入LLM之前,先对其进行“治疗性”的改进。具体来说,CPR首先识别并清理结构不良的提示,然后生成额外的、信息丰富的任务描述,从而更准确地表达用户的意图。通过这种方式,CPR试图弥合用户意图与LLM实际理解之间的差距,减少模型产生幻觉的可能性。

技术框架:CPR是一个即插即用的框架,可以与各种LLM结合使用。它包含两个主要模块:1) 提示清理模块,用于识别和修正结构不良的提示;2) 提示增强模块,用于生成额外的任务描述,以补充原始提示的信息。这两个模块都基于一个微调的小型语言模型,该模型专门用于提示改进任务。整个流程是:用户输入原始提示 -> CPR框架进行提示清理和增强 -> 改进后的提示输入LLM -> LLM生成最终结果。

关键创新:CPR的关键创新在于它将提示本身视为一个需要优化的对象,而不是仅仅依赖于LLM的能力。通过显式地清理和增强提示,CPR能够更有效地引导LLM理解用户的意图,从而减少幻觉的产生。与现有方法相比,CPR更加注重提示工程,并提供了一种自动化的提示改进方案。

关键设计:CPR使用一个微调的小型语言模型来执行提示清理和增强任务。具体的微调策略和数据集选择未知。论文中提到CPR是一个“即插即用”的框架,这意味着它可以很容易地集成到现有的LLM系统中,而无需对LLM本身进行修改。具体的损失函数和网络结构等技术细节未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,CPR能够显著提高LLM生成信息的质量,并有效缓解幻觉问题。应用CPR的提示相比原始提示,在生成质量上取得了超过90%的胜率,无需任何外部知识。这一结果表明,CPR是一种有效的提示优化方法,能够显著提升LLM的性能。

🎯 应用场景

CPR框架可广泛应用于各种需要大语言模型提供信息服务的场景,例如问答系统、内容生成、智能助手等。通过提高LLM生成信息的准确性和可靠性,CPR有助于增强用户对这些系统的信任,并拓展LLM的应用范围。未来,CPR可以进一步发展为更智能的提示优化工具,自动适应不同用户和任务的需求。

📄 摘要(原文)

Recent advancements in large language models (LLMs) highlight their fluency in generating responses to diverse prompts. However, these models sometimes generate plausible yet incorrect ``hallucinated" facts, undermining trust. A frequent but often overlooked cause of such errors is the use of poorly structured or vague prompts by users, leading LLMs to base responses on assumed rather than actual intentions. To mitigate hallucinations induced by these ill-formed prompts, we introduce Curative Prompt Refinement (CPR), a plug-and-play framework for curative prompt refinement that 1) cleans ill-formed prompts, and 2) generates additional informative task descriptions to align the intention of the user and the prompt using a fine-tuned small language model. When applied to language models, we discover that CPR significantly increases the quality of generation while also mitigating hallucination. Empirical studies show that prompts with CPR applied achieves over a 90\% win rate over the original prompts without any external knowledge.