Ensembling Large Language Models to Characterize Affective Dynamics in Student-AI Tutor Dialogues

作者: Chenyu Zhang, Sharifa Alghowinem, Cynthia Breazeal

分类: cs.CL, cs.AI, cs.HC

发布日期: 2025-10-13

备注: 4 pages, 3 figures. Published in the 11th International Conference on Affective Computing and Intelligent Interaction (ACII 2025), Late-Breaking Results Track

期刊: Proceedings of the 11th International Conference on Affective Computing and Intelligent Interaction (ACII 2025), Late-Breaking Results Track, IEEE, 2025

💡 一句话要点

提出集成大语言模型框架,用于分析学生-AI辅导对话中的情感动态

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 情感计算 大语言模型 AI辅导 教育技术 情感分析

📋 核心要点

- 现有研究对LLM在教育中的学习影响关注较多,但对LLM介导的辅导过程中的情感动态理解不足。

- 提出集成LLM框架,通过融合多个LLM的情感标注,更准确地感知学生在AI辅导对话中的情感状态。

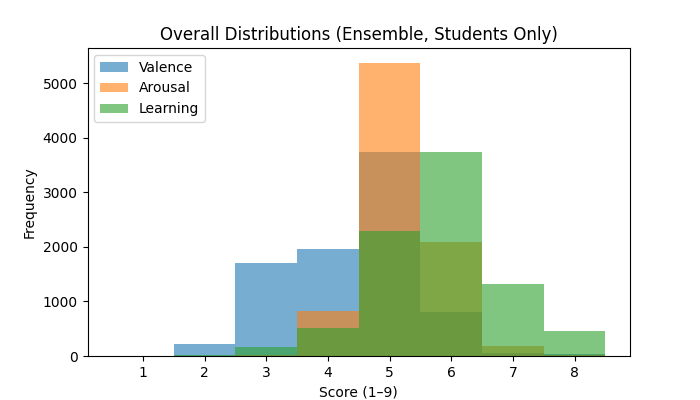

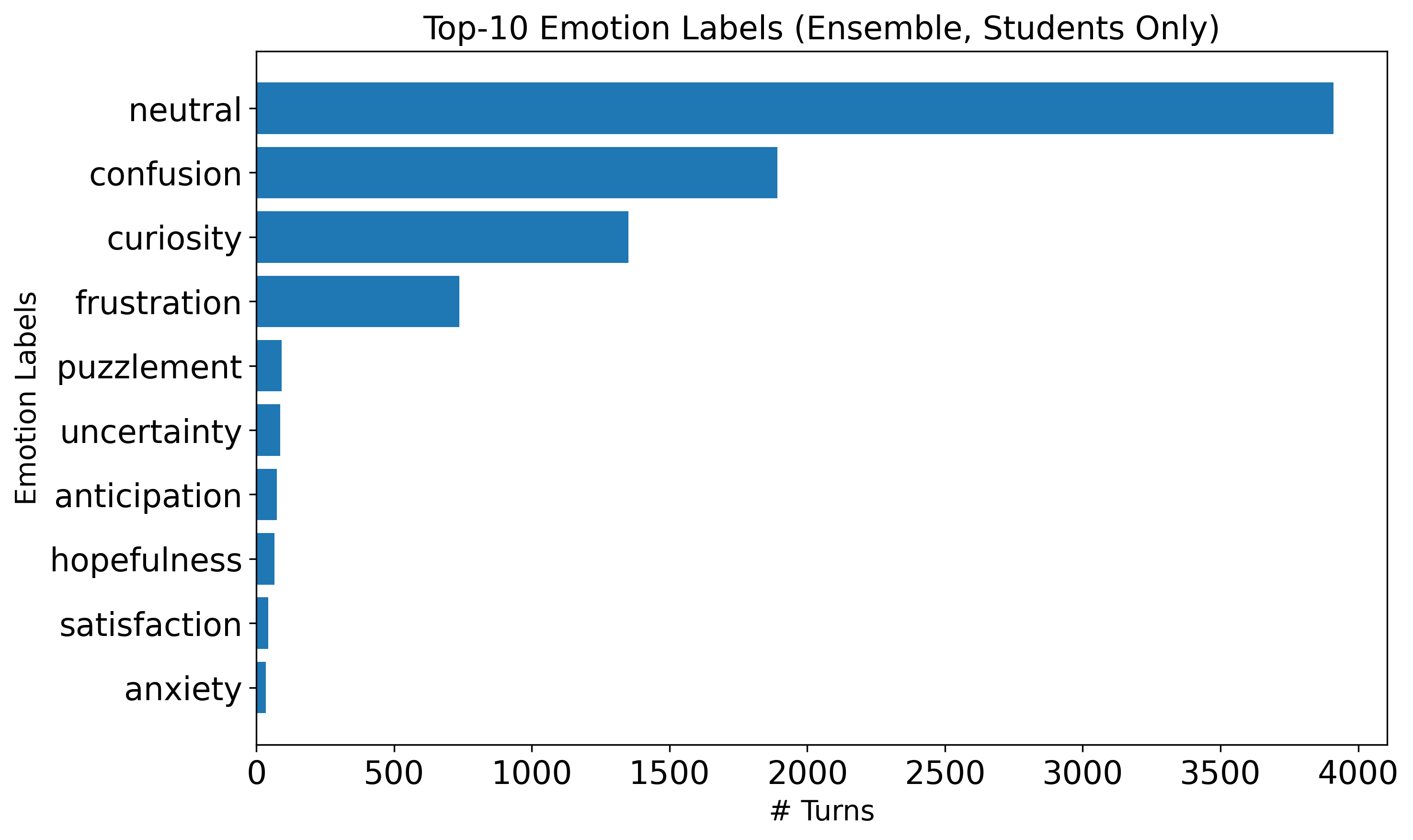

- 分析表明学生在AI辅导中通常表现出轻微积极情感和适度唤醒,但学习过程伴随困惑、好奇和挫败等情感。

📝 摘要(中文)

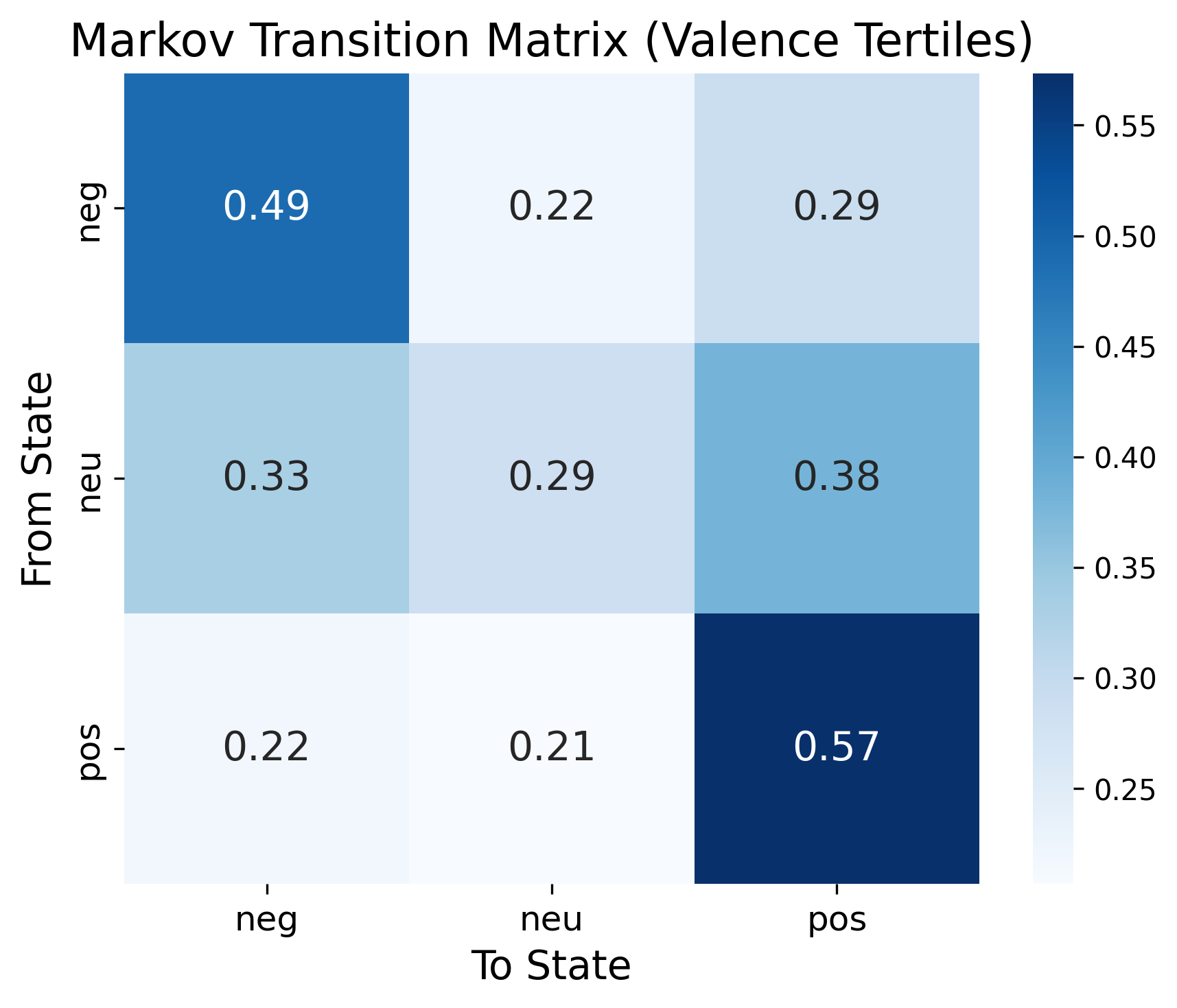

本研究旨在深入理解大语言模型(LLM)在教育场景中介导辅导过程中的情感动态。为此,我们提出了首个集成LLM框架,用于大规模情感感知,从而促进将生成式AI负责任地整合到教育中的讨论,关注学习者不断变化的情感状态。我们分析了来自三个美国机构的261名本科生与LLM驱动的AI辅导系统PyTutor之间进行的16986轮对话。为了研究学习者的情感体验,我们利用三个前沿LLM(Gemini、GPT-4o、Claude)生成了零样本情感标注,包括效价、唤醒度和学习帮助性的标量评级以及自由文本情感标签。这些估计通过模型内排序加权池化和跨模型多数共识进行融合,以产生稳健的情感概况。分析表明,学生在与AI辅导互动期间通常表现出轻微的积极情感和适度的唤醒。然而,学习并非一帆风顺:困惑和好奇心经常伴随着问题解决,而挫败感虽然不太常见,但仍会以可能破坏进展的方式出现。情感状态是短暂的——积极时刻持续时间略长于中性或消极时刻,但它们是脆弱且容易被打断的。令人鼓舞的是,负面情绪通常会迅速消退,有时会直接反弹到积极状态。中性时刻经常充当转折点,更频繁地引导学生向上而非向下,这表明辅导员有机会在这些关键时刻进行干预。

🔬 方法详解

问题定义:现有方法缺乏对学生在使用LLM驱动的AI辅导系统时的情感状态的深入理解。仅仅关注学习效果,而忽略情感因素,可能导致无法充分优化辅导策略,甚至可能对学生的学习体验产生负面影响。因此,需要一种能够准确、可靠地感知学生情感的方法,以便更好地理解和改善AI辅导过程。

核心思路:本研究的核心思路是利用多个大型语言模型(LLM)的集成来提高情感感知的准确性和鲁棒性。通过融合不同LLM的情感标注结果,可以减少单个模型的偏差,并获得更可靠的情感概况。这种集成方法借鉴了集成学习的思想,旨在利用多个模型的优势来提高整体性能。

技术框架:该框架主要包含以下几个阶段:1) 数据收集:收集学生与AI辅导系统PyTutor的对话数据。2) 情感标注:使用多个LLM(Gemini、GPT-4o、Claude)对对话数据进行零样本情感标注,包括效价、唤醒度和学习帮助性的标量评级以及自由文本情感标签。3) 模型内融合:对每个LLM的标注结果进行排序加权池化,以提高单个模型标注的准确性。4) 模型间融合:采用多数共识方法,融合不同LLM的标注结果,以获得最终的情感概况。

关键创新:该研究的关键创新在于提出了一个集成LLM框架,用于大规模情感感知。与传统的基于规则或机器学习的情感分析方法相比,该框架具有更高的灵活性和泛化能力。此外,该研究还探索了不同LLM在情感感知方面的性能差异,并提出了一种有效的模型融合方法。

关键设计:在模型内融合阶段,采用了排序加权池化方法,根据标注结果的排序赋予不同的权重。在模型间融合阶段,采用了多数共识方法,选择出现次数最多的情感标签作为最终结果。具体参数设置和损失函数信息未知。

🖼️ 关键图片

📊 实验亮点

研究结果表明,学生在与AI辅导互动期间通常表现出轻微的积极情感和适度的唤醒。情感状态是短暂的,积极时刻持续时间略长于中性或消极时刻,但它们是脆弱且容易被打断的。负面情绪通常会迅速消退,有时会直接反弹到积极状态。中性时刻经常充当转折点,更频繁地引导学生向上而非向下。

🎯 应用场景

该研究成果可应用于智能教育系统、个性化学习平台和情感计算等领域。通过实时感知学生的情感状态,AI辅导系统可以调整教学策略,提供更个性化的支持,从而提高学习效果和学习体验。此外,该研究还可以为教育工作者提供关于学生情感动态的洞察,帮助他们更好地理解学生的学习过程。

📄 摘要(原文)

While recent studies have examined the leaning impact of large language model (LLM) in educational contexts, the affective dynamics of LLM-mediated tutoring remain insufficiently understood. This work introduces the first ensemble-LLM framework for large-scale affect sensing in tutoring dialogues, advancing the conversation on responsible pathways for integrating generative AI into education by attending to learners' evolving affective states. To achieve this, we analyzed two semesters' worth of 16,986 conversational turns exchanged between PyTutor, an LLM-powered AI tutor, and 261 undergraduate learners across three U.S. institutions. To investigate learners' emotional experiences, we generate zero-shot affect annotations from three frontier LLMs (Gemini, GPT-4o, Claude), including scalar ratings of valence, arousal, and learning-helpfulness, along with free-text emotion labels. These estimates are fused through rank-weighted intra-model pooling and plurality consensus across models to produce robust emotion profiles. Our analysis shows that during interaction with the AI tutor, students typically report mildly positive affect and moderate arousal. Yet learning is not uniformly smooth: confusion and curiosity are frequent companions to problem solving, and frustration, while less common, still surfaces in ways that can derail progress. Emotional states are short-lived--positive moments last slightly longer than neutral or negative ones, but they are fragile and easily disrupted. Encouragingly, negative emotions often resolve quickly, sometimes rebounding directly into positive states. Neutral moments frequently act as turning points, more often steering students upward than downward, suggesting opportunities for tutors to intervene at precisely these junctures.