Information-Preserving Reformulation of Reasoning Traces for Antidistillation

作者: Jiayu Ding, Lei Cui, Li Dong, Nanning Zheng, Furu Wei

分类: cs.CL

发布日期: 2025-10-13

💡 一句话要点

提出PART方法,通过推理轨迹重构实现抗蒸馏,保护LLM知识产权。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 抗蒸馏 推理轨迹 知识产权保护 模型安全

📋 核心要点

- 现有LLM推理过程易被蒸馏,模型提供商为保护知识产权,牺牲了用户获取中间推理信息的需求。

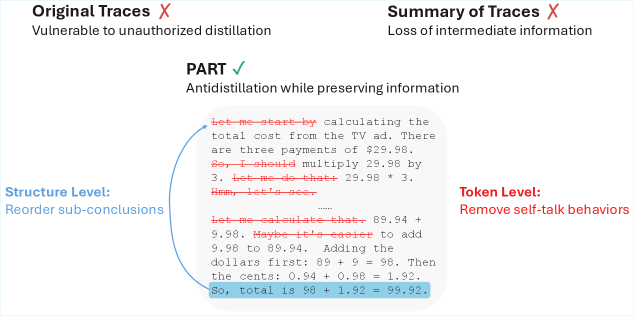

- PART通过移除自言自语和重排序子结论,重构推理轨迹,使之难以被学生模型有效学习,从而实现抗蒸馏。

- 实验表明,PART能有效降低学生模型的性能,例如在AIME 2024上,32B学生模型的性能下降了13.5%。

📝 摘要(中文)

大型语言模型(LLM)推理链的长度增加能显著提升复杂任务的性能。然而,公开这些推理过程虽有助于用户理解、验证和学习,但也使模型极易遭受未经授权的蒸馏。为缓解此风险,模型提供商常采取激进的保护策略,如用简短摘要代替详细推理,剥夺了用户宝贵的中间信息。为解决这一权衡,我们提出了PART,一种信息保持的推理轨迹抗蒸馏重构方法。基于人类理解推理轨迹的方式与LLM利用它们进行监督微调的差异,我们设计了一个简单而有效的两步重构:移除自言自语行为和重排序子结论。训练了一个小型辅助模型来执行此重构,计算开销极小。大量实验表明,PART能够持续扰乱不同大小和类型的学生模型在各种推理基准上的蒸馏。例如,在重构后的轨迹上训练时,即使是大型32B学生模型的性能在AIME 2024上也会从54.17降至46.88,降幅达13.5%。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)的推理轨迹容易被未经授权的蒸馏利用的问题。现有方法,如直接隐藏推理过程,虽然能防止蒸馏,但也损害了用户理解和学习模型推理过程的能力。因此,如何在保护模型知识产权的同时,保留用户获取有用推理信息的能力,是一个关键挑战。

核心思路:论文的核心思路是,人类和LLM对推理轨迹的理解和利用方式存在差异。人类可以从包含冗余信息和非标准顺序的推理轨迹中学习,而LLM在监督微调时,更容易受到这些因素的干扰。因此,通过对推理轨迹进行重构,使其对人类仍然有意义,但对LLM的蒸馏效果产生负面影响,从而实现抗蒸馏的目的。

技术框架:PART方法包含两个主要步骤:1) 移除自言自语行为(Removing Self-Talk Behaviors):识别并移除推理过程中模型产生的冗余或重复的语句,例如“Let's think step by step”等。2) 重排序子结论(Reordering Sub-Conclusions):改变推理过程中子结论的顺序,使其不再是严格的逻辑推导顺序。这两个步骤由一个小型辅助模型执行。该辅助模型通过少量数据进行训练,以学习如何识别和重构推理轨迹。

关键创新:PART的关键创新在于其信息保持的抗蒸馏策略。与直接隐藏推理过程的方法不同,PART通过重构推理轨迹,使其对人类仍然有意义,但对LLM的蒸馏效果产生负面影响。这种方法在保护模型知识产权的同时,保留了用户获取有用推理信息的能力。

关键设计:辅助模型的具体结构和训练方式未知,但论文强调其计算开销极小。移除自言自语行为的具体实现方法也未知,可能涉及到关键词匹配或更复杂的语义分析。重排序子结论的具体策略也未知,可能涉及到随机排序或基于某种规则的排序。

🖼️ 关键图片

📊 实验亮点

实验结果表明,PART能够有效降低学生模型的性能。例如,在AIME 2024数据集上,使用重构后的推理轨迹训练32B学生模型,其性能从54.17降至46.88,降幅达13.5%。此外,PART方法对不同大小和类型的学生模型都有效,表明其具有较强的泛化能力。

🎯 应用场景

PART方法可应用于保护大型语言模型的知识产权,尤其是在模型推理过程对外开放的场景下。例如,模型提供商可以使用PART对推理轨迹进行重构,然后再将其提供给用户,从而防止未经授权的蒸馏。这有助于维护模型提供商的商业利益,同时也能让用户受益于模型的推理能力。

📄 摘要(原文)

Recent advances in Large Language Models (LLMs) show that extending the length of reasoning chains significantly improves performance on complex tasks. While revealing these reasoning traces helps users better follow, verify, and learn from the model's problem-solving process, it also makes them highly vulnerable to unauthorized distillation. To mitigate this risk, proprietary model providers often adopt aggressive protection strategies, such as replacing detailed reasoning with brief summaries, which deprive users of valuable intermediate information. To address this trade-off, we propose PART, an information-preserving antidistillation reformulation of reasoning traces. Motivated by the difference between how humans understand reasoning traces and how LLMs exploit them for supervised fine-tuning, we design a simple but effective two-step reformulation: removing self-talk behaviors and reordering sub-conclusions. A small auxiliary model is trained to perform this reformulation, incurring minimal computational overhead. Extensive experiments demonstrate that PART consistently disrupts distillation across student models of different sizes and types on various reasoning benchmarks. For instance, when training on reformulated traces, even the performance of a large 32B student model decreases from 54.17 to 46.88 on AIME 2024, corresponding to a 13.5% degradation.