Investigating Large Language Models' Linguistic Abilities for Text Preprocessing

作者: Marco Braga, Gian Carlo Milanese, Gabriella Pasi

分类: cs.CL, cs.AI

发布日期: 2025-10-13

备注: Accepted in WI-IAT 2025. Pre-camera-ready version

🔗 代码/项目: GITHUB

💡 一句话要点

利用大型语言模型进行文本预处理,提升下游文本分类任务性能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 文本预处理 停用词移除 词干提取 词形还原 文本分类 上下文理解

📋 核心要点

- 传统文本预处理方法缺乏对上下文信息的考虑,限制了其在复杂NLP任务中的表现。

- 利用LLM强大的上下文理解能力,无需大量标注数据即可实现有效的文本预处理。

- 实验表明,LLM预处理后的文本能显著提升文本分类任务的性能,F1值最高提升6%。

📝 摘要(中文)

本文研究了使用大型语言模型(LLM)执行文本预处理任务的可能性。文本预处理是自然语言处理的基础环节,包括停用词移除、词干提取和词形还原等技术,旨在为后续处理和分析准备文本。传统方法通常忽略上下文信息,而LLM能够考虑上下文,且无需大量的特定语言标注资源。通过对网络数据的全面评估,我们将基于LLM的预处理(特别是停用词移除、词形还原和词干提取)与传统算法在六种欧洲语言的多个文本分类任务中进行了比较。分析表明,LLM能够复制传统的停用词移除、词形还原和词干提取方法,准确率分别达到97%、82%和74%。此外,与传统技术相比,使用LLM预处理的文本训练的机器学习算法在$F_1$指标上提高了高达6%。代码、提示和结果已公开。

🔬 方法详解

问题定义:论文旨在解决传统文本预处理方法忽略上下文信息的问题。现有的停用词移除、词干提取和词形还原等技术通常是静态的,无法根据文本的具体语境进行调整,导致预处理效果不佳,进而影响下游NLP任务的性能。

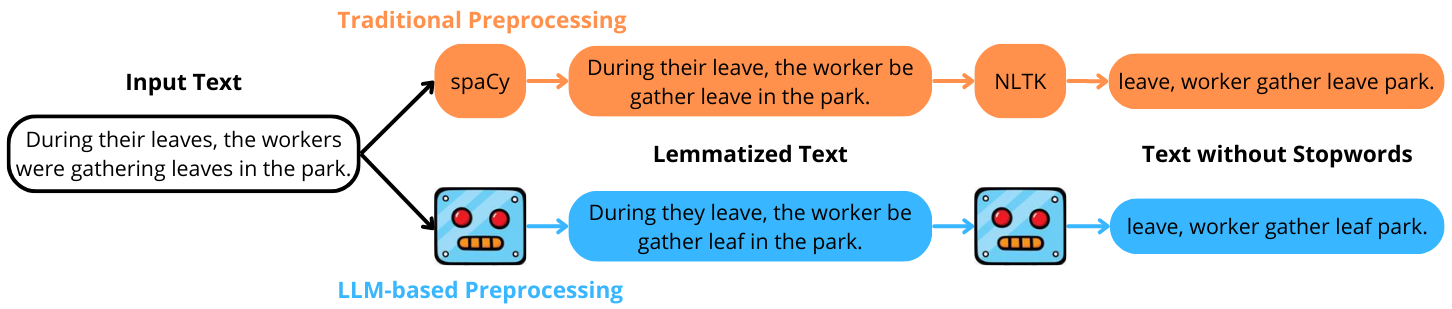

核心思路:论文的核心思路是利用大型语言模型(LLM)强大的上下文理解能力,将文本预处理任务转化为一个序列到序列的生成问题。通过合适的提示工程(Prompt Engineering),引导LLM根据上下文信息,动态地执行停用词移除、词干提取和词形还原等操作。

技术框架:整体流程包括以下几个主要阶段:1)输入原始文本;2)设计合适的Prompt,将文本预处理任务转化为LLM可以理解的指令;3)使用LLM对文本进行预处理,生成处理后的文本;4)使用预处理后的文本训练文本分类模型;5)评估文本分类模型的性能。

关键创新:最重要的技术创新点在于将LLM引入到文本预处理流程中,利用其强大的上下文理解能力,实现了动态的、上下文相关的文本预处理。与传统的静态方法相比,LLM能够根据文本的具体语境进行调整,从而提高预处理效果。

关键设计:论文的关键设计包括:1)针对不同的预处理任务(停用词移除、词干提取、词形还原)设计了不同的Prompt;2)选择了多种欧洲语言进行实验,验证了方法的跨语言适用性;3)使用了多种文本分类模型进行评估,验证了方法的有效性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LLM能够以高精度复制传统的文本预处理方法,停用词移除、词形还原和词干提取的准确率分别达到97%、82%和74%。更重要的是,使用LLM预处理后的文本训练的机器学习模型,在文本分类任务的F1值上相比传统方法提升高达6%,证明了LLM在文本预处理方面的有效性。

🎯 应用场景

该研究成果可广泛应用于各种自然语言处理任务中,例如文本分类、情感分析、机器翻译等。通过利用LLM进行文本预处理,可以提高这些任务的性能和准确性。此外,该方法还可以应用于信息检索、舆情分析等领域,具有重要的实际价值和广阔的应用前景。

📄 摘要(原文)

Text preprocessing is a fundamental component of Natural Language Processing, involving techniques such as stopword removal, stemming, and lemmatization to prepare text as input for further processing and analysis. Despite the context-dependent nature of the above techniques, traditional methods usually ignore contextual information. In this paper, we investigate the idea of using Large Language Models (LLMs) to perform various preprocessing tasks, due to their ability to take context into account without requiring extensive language-specific annotated resources. Through a comprehensive evaluation on web-sourced data, we compare LLM-based preprocessing (specifically stopword removal, lemmatization and stemming) to traditional algorithms across multiple text classification tasks in six European languages. Our analysis indicates that LLMs are capable of replicating traditional stopword removal, lemmatization, and stemming methods with accuracies reaching 97%, 82%, and 74%, respectively. Additionally, we show that ML algorithms trained on texts preprocessed by LLMs achieve an improvement of up to 6% with respect to the $F_1$ measure compared to traditional techniques. Our code, prompts, and results are publicly available at https://github.com/GianCarloMilanese/llm_pipeline_wi-iat.