Do LLMs "Feel"? Emotion Circuits Discovery and Control

作者: Chenxi Wang, Yixuan Zhang, Ruiji Yu, Yufei Zheng, Lang Gao, Zirui Song, Zixiang Xu, Gus Xia, Huishuai Zhang, Dongyan Zhao, Xiuying Chen

分类: cs.CL, cs.AI

发布日期: 2025-10-13

备注: 19 pages, 8 figures, 8 tables. Code and dataset available at https://github.com/Aurora-cx/EmotionCircuits-LLM

💡 一句话要点

揭示LLM中的情感回路,实现精准可控的情感表达

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 情感智能 情感回路 可解释性 情感控制

📋 核心要点

- 现有LLM情感表达机制尚不明确,缺乏有效的情感控制手段。

- 通过构建SEV数据集,提取情感方向,并识别关键神经元和注意力头,构建情感回路。

- 实验表明,直接调节情感回路可实现99.65%的情感表达准确率,优于现有方法。

📝 摘要(中文)

随着大型语言模型(LLM)对情感智能的需求增长,一个关键挑战在于理解产生情感表达的内部机制,并控制生成文本中的情感。本研究旨在解决三个核心问题:(1)LLM是否包含塑造情感表达的、与上下文无关的机制?(2)这些机制采取何种形式?(3)它们能否被用于通用情感控制?我们首先构建了一个受控数据集SEV(具有效价的场景-事件),以引发跨情感的可比较的内部状态。随后,我们提取了与上下文无关的情感方向,揭示了情感的一致的、跨上下文的编码(Q1)。我们通过分析分解和因果分析,识别出局部实现情感计算的神经元和注意力头,并通过消融和增强干预验证了它们的因果作用。接下来,我们量化了每个子层对模型最终情感表征的因果影响,并将识别出的局部组件整合到驱动情感表达的连贯的全局情感回路中(Q2)。直接调节这些回路在测试集上实现了99.65%的情感表达准确率,超过了基于提示和基于steering的方法(Q3)。据我们所知,这是第一个系统地揭示和验证LLM中情感回路的研究,为可解释性和可控情感智能提供了新的见解。

🔬 方法详解

问题定义:现有大型语言模型在情感表达方面存在黑盒问题,难以理解其内部机制,也缺乏有效的情感控制手段。现有方法如prompting和steering虽然可以影响情感表达,但缺乏对模型内部运作的深入理解,难以实现精准控制。因此,需要深入理解LLM如何编码和处理情感,并在此基础上实现可控的情感表达。

核心思路:本研究的核心思路是通过构建一个受控数据集,诱导出模型内部可比较的情感状态,然后通过分析分解和因果干预,识别出负责情感计算的关键神经元和注意力头,并将这些局部组件整合到全局情感回路中。通过直接操纵这些情感回路,可以实现对LLM情感表达的精准控制。

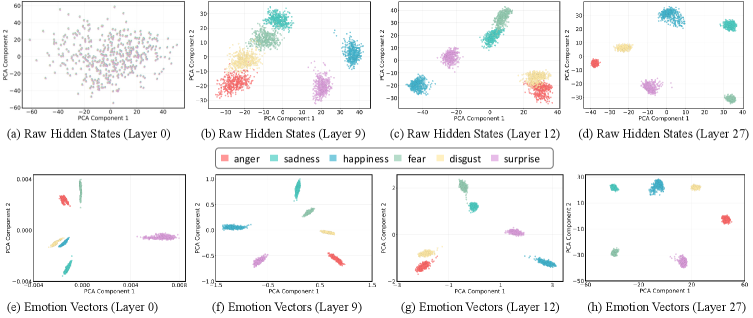

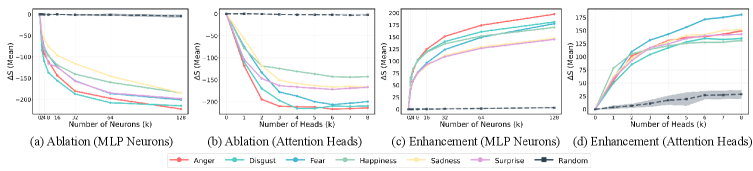

技术框架:该研究的技术框架主要包括以下几个阶段:1) 构建SEV数据集:设计包含不同情感效价的场景-事件对,用于诱导模型产生可比较的情感状态。2) 提取情感方向:通过分析模型在不同情感下的激活模式,提取与上下文无关的情感方向。3) 识别关键组件:通过分析分解和因果干预,识别出局部实现情感计算的神经元和注意力头。4) 构建情感回路:将识别出的局部组件整合到连贯的全局情感回路中,量化每个子层的影响。5) 情感控制:通过直接调节情感回路,实现对LLM情感表达的精准控制。

关键创新:本研究最重要的技术创新在于首次系统地揭示和验证了LLM中的情感回路。与现有方法相比,本研究不是简单地通过prompting或steering来影响情感表达,而是深入到模型内部,识别出负责情感计算的关键组件,并构建了情感回路。这种方法可以实现对情感表达的精准控制,并且为理解LLM的内部运作提供了新的视角。

关键设计:SEV数据集的设计保证了不同情感场景的可比性,从而可以提取与上下文无关的情感方向。通过分析分解,可以识别出对情感表达贡献最大的神经元和注意力头。因果干预(消融和增强)用于验证这些组件的因果作用。情感回路的构建考虑了每个子层对最终情感表征的影响,从而可以实现全局的情感控制。

🖼️ 关键图片

📊 实验亮点

实验结果表明,通过直接调节情感回路,在测试集上实现了99.65%的情感表达准确率,显著优于基于prompting和steering的方法。这表明该研究提出的方法可以实现对LLM情感表达的精准控制,并且验证了情感回路的存在和作用。

🎯 应用场景

该研究成果可应用于情感聊天机器人、情感客服、个性化内容生成等领域。通过控制LLM的情感表达,可以提升用户体验,增强人机交互的自然性和情感共鸣。此外,该研究也为理解和控制AI系统的情感智能提供了新的思路,有助于开发更安全、更可靠的AI系统。

📄 摘要(原文)

As the demand for emotional intelligence in large language models (LLMs) grows, a key challenge lies in understanding the internal mechanisms that give rise to emotional expression and in controlling emotions in generated text. This study addresses three core questions: (1) Do LLMs contain context-agnostic mechanisms shaping emotional expression? (2) What form do these mechanisms take? (3) Can they be harnessed for universal emotion control? We first construct a controlled dataset, SEV (Scenario-Event with Valence), to elicit comparable internal states across emotions. Subsequently, we extract context-agnostic emotion directions that reveal consistent, cross-context encoding of emotion (Q1). We identify neurons and attention heads that locally implement emotional computation through analytical decomposition and causal analysis, and validate their causal roles via ablation and enhancement interventions. Next, we quantify each sublayer's causal influence on the model's final emotion representation and integrate the identified local components into coherent global emotion circuits that drive emotional expression (Q2). Directly modulating these circuits achieves 99.65% emotion-expression accuracy on the test set, surpassing prompting- and steering-based methods (Q3). To our knowledge, this is the first systematic study to uncover and validate emotion circuits in LLMs, offering new insights into interpretability and controllable emotional intelligence.