XQuant: Achieving Ultra-Low Bit KV Cache Quantization with Cross-Layer Compression

作者: Haoqi Yang, Yao Yao, Zuchao Li, Baoyuan Qi, Guoming Liu, Hai Zhao

分类: cs.CL

发布日期: 2025-10-13

备注: To be published in The 2025 Conference on Empirical Methods in Natural Language Processing (EMNLP 2025)

💡 一句话要点

XQuant:通过跨层压缩实现超低比特KV缓存量化,提升长文本处理效率。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: KV缓存量化 大型语言模型 低比特量化 跨层压缩 无数据校准

📋 核心要点

- 大型语言模型部署面临内存瓶颈,尤其是在长文本处理中,KV缓存的增长加剧了资源消耗。

- XQuant提出一种无需训练的量化框架,通过无数据校准和跨层压缩,实现超低比特KV缓存量化。

- 实验表明,XQuant在更低比特宽度下,性能优于现有方法,在内存效率和模型精度间取得平衡。

📝 摘要(中文)

大型语言模型(LLMs)在各种自然语言处理任务中表现出卓越的能力。然而,它们庞大的内存需求,特别是由于长文本理解和生成过程中KV缓存的增长,对资源受限环境中的部署提出了重大挑战。量化已成为一种有前途的解决方案,可以在减少内存消耗的同时保留历史信息。我们提出了XQuant,一个无需训练且即插即用的框架,可实现超低等效比特宽度的KV缓存量化。XQuant引入了两项关键创新:一种计算量可忽略不计的无数据校准方法和跨层KV缓存压缩,从而能够量化到低于1.4比特。在TruthfulQA和LongBench上的大量实验表明,XQuant优于最先进的方法(例如,KIVI-2bit和AsymKV-1.5bit),实现了更低的比特宽度,同时保持了卓越的性能,从而在内存效率和模型精度之间建立了更好的权衡。

🔬 方法详解

问题定义:大型语言模型在处理长文本时,KV缓存会显著增长,导致内存需求激增,这限制了它们在资源受限环境中的部署。现有的量化方法虽然可以降低内存占用,但在极低比特量化时,性能下降明显,难以在精度和效率之间取得平衡。

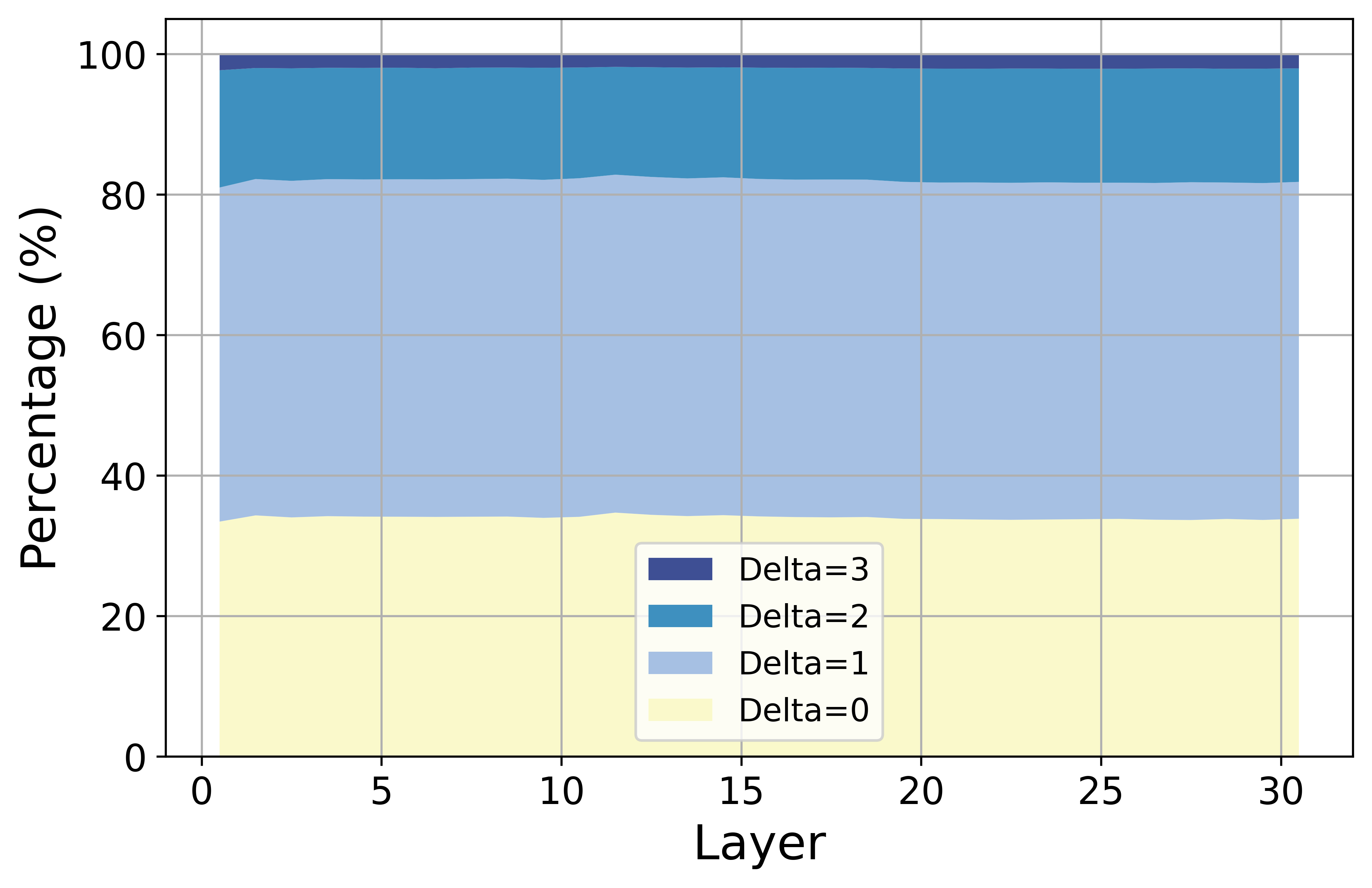

核心思路:XQuant的核心思路是通过跨层压缩和无数据校准,实现超低比特的KV缓存量化,从而在显著降低内存占用的同时,尽可能保持模型的性能。跨层压缩旨在利用不同层KV缓存之间的冗余信息,进一步压缩数据。无数据校准则避免了传统量化方法中对训练数据的依赖,使其更易于部署。

技术框架:XQuant框架主要包含两个阶段:无数据校准和跨层KV缓存压缩。首先,利用一种计算量小的无数据校准方法,确定量化参数,例如缩放因子和零点。然后,应用跨层KV缓存压缩技术,进一步减少KV缓存的冗余信息。最后,将压缩后的KV缓存用于模型的推理过程。

关键创新:XQuant的关键创新在于:1) 提出了一种计算量可忽略不计的无数据校准方法,避免了对训练数据的依赖,降低了部署成本。2) 引入了跨层KV缓存压缩技术,利用不同层KV缓存之间的冗余信息,实现了更低的比特量化。

关键设计:无数据校准方法基于统计特性,例如激活值的范围和分布,来确定量化参数。跨层KV缓存压缩的具体实现方式未知,可能涉及聚类、编码等技术。论文中未明确提及损失函数或网络结构等细节,但强调了该方法是即插即用的,可以应用于不同的模型架构。

🖼️ 关键图片

📊 实验亮点

XQuant在TruthfulQA和LongBench数据集上进行了广泛的实验,结果表明,XQuant在实现更低比特宽度(低于1.4比特)的同时,性能优于最先进的方法,例如KIVI-2bit和AsymKV-1.5bit。这表明XQuant在内存效率和模型精度之间取得了更好的平衡,为超低比特量化提供了一种有效的解决方案。

🎯 应用场景

XQuant技术可广泛应用于资源受限的设备上部署大型语言模型,例如移动设备、嵌入式系统和边缘计算设备。通过降低内存需求,XQuant使得这些设备能够运行更大规模的模型,从而提升自然语言处理任务的性能。此外,该技术还有助于降低云计算成本,提高推理效率,加速LLM在各行业的落地。

📄 摘要(原文)

Large Language Models (LLMs) have demonstrated remarkable capabilities across diverse natural language processing tasks. However, their extensive memory requirements, particularly due to KV cache growth during long-text understanding and generation, present significant challenges for deployment in resource-constrained environments. Quantization has emerged as a promising solution to reduce memory consumption while preserving historical information. We propose XQuant, a training-free and plug-and-play framework that achieves ultra-low equivalent bit-width KV cache quantization. XQuant introduces two key innovations: a computationally negligible data-free calibration method and cross-layer KV cache compression, enabling quantization to sub-1.4 bits. Extensive experiments on TruthfulQA and LongBench demonstrate that XQuant outperforms state-of-the-art methods (e.g., KIVI-2bit and AsymKV-1.5bit) by achieving lower bit-width while maintaining superior performance, establishing a better trade-off between memory efficiency and model accuracy.