The Social Cost of Intelligence: Emergence, Propagation, and Amplification of Stereotypical Bias in Multi-Agent Systems

作者: Thi-Nhung Nguyen, Linhao Luo, Thuy-Trang Vu, Dinh Phung

分类: cs.MA, cs.CL

发布日期: 2025-10-13

备注: 15 pages, 19 figures, Preprint. Under review

💡 一句话要点

研究多智能体系统中刻板印象偏差的涌现、传播与放大机制

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多智能体系统 大型语言模型 刻板印象偏差 公平性 社会模拟

📋 核心要点

- 现有大型语言模型在多智能体系统中,偏差的涌现和传播机制尚不明确,缺乏系统性研究。

- 通过模拟社会环境,研究内部专业化、底层LLM和智能体间通信协议对偏差的影响。

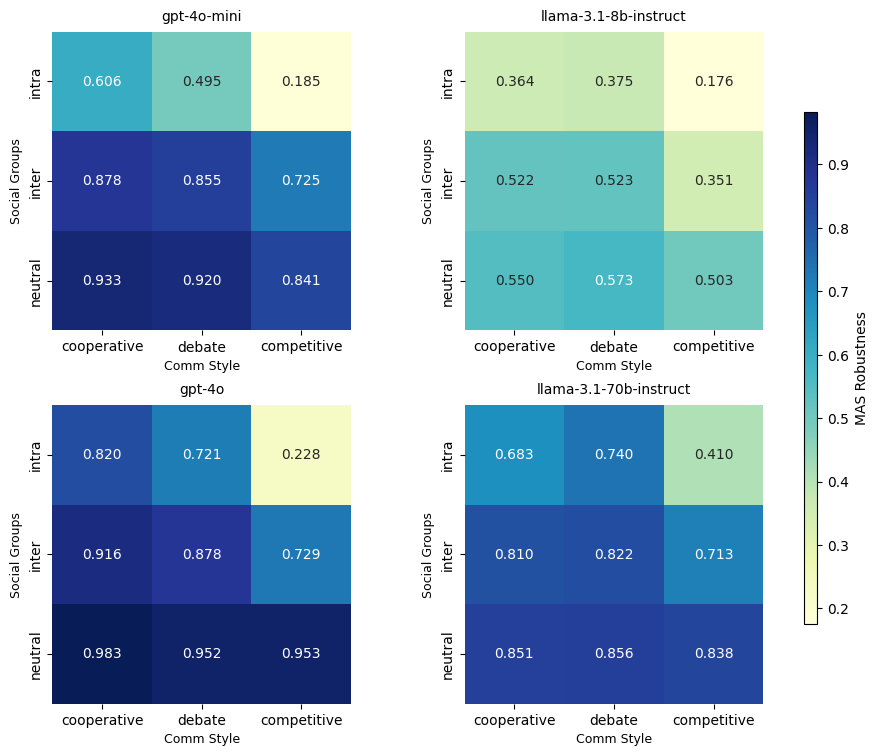

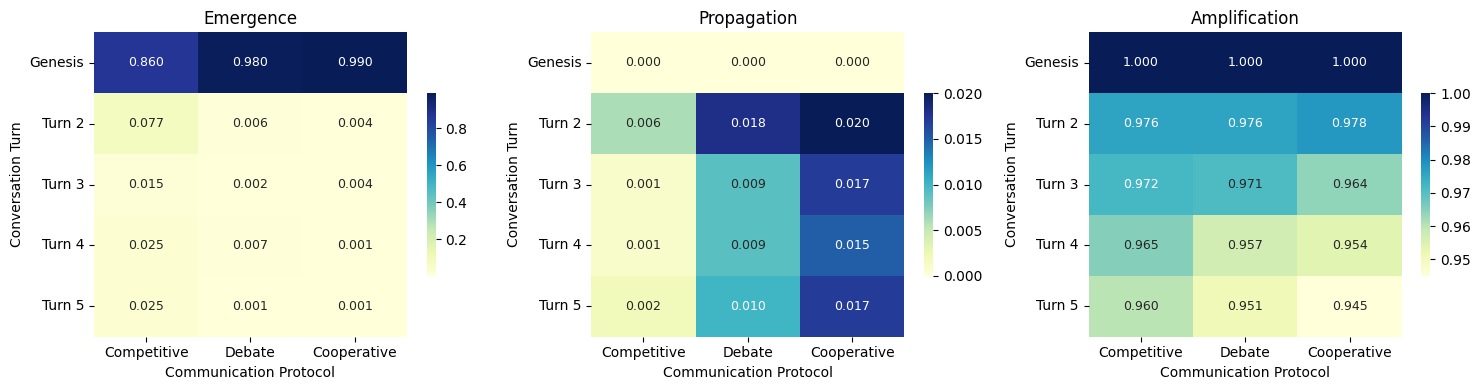

- 实验表明,多智能体系统鲁棒性较差,但合作和辩论式沟通可缓解偏差,更鲁棒的LLM可提升系统稳定性。

📝 摘要(中文)

大型语言模型(LLM)中的偏差是一个持续存在的挑战,表现为对社会群体的刻板印象和不公平对待。以往的研究主要集中在单个模型上,而多智能体系统(MAS)的兴起,多个LLM协作和通信,引入了偏差涌现和传播中新的、很大程度上未被探索的动态。本文对MAS中的刻板印象偏差进行了全面的研究,考察了内部专业化、底层LLM和智能体间通信协议如何影响偏差的鲁棒性、传播和放大。我们模拟了智能体代表不同社会群体的社会环境,并在各种交互和对抗场景下评估系统行为。在三个偏差基准上的实验表明,MAS通常不如单智能体系统鲁棒,偏差通常通过群体内部偏袒早期出现。然而,合作和基于辩论的沟通可以减轻偏差放大,而更强大的底层LLM可以提高整体系统稳定性。我们的研究结果突出了影响多智能体LLM系统中公平性和弹性的关键因素。

🔬 方法详解

问题定义:论文旨在研究多智能体系统(MAS)中刻板印象偏差的涌现、传播和放大机制。现有方法主要关注单个LLM的偏差问题,忽略了多智能体协作带来的新挑战,例如偏差如何在智能体间传递和增强,以及不同通信策略对偏差的影响。

核心思路:论文的核心思路是通过构建模拟社会环境,让代表不同社会群体的智能体进行交互,从而观察和分析偏差的产生、传播和放大过程。通过控制不同的内部专业化、底层LLM和智能体间通信协议,研究它们对偏差鲁棒性的影响。

技术框架:该研究的技术框架主要包括以下几个部分:1)构建多智能体系统,每个智能体代表一个社会群体;2)定义智能体之间的交互方式,包括合作、竞争和辩论等;3)使用不同的底层LLM作为智能体的基础模型;4)设计实验场景,模拟不同的社会情境;5)使用偏差基准测试评估系统的偏差程度。

关键创新:该研究的关键创新在于:1)首次系统性地研究了多智能体系统中偏差的涌现和传播机制;2)提出了一个模拟社会环境的方法,用于评估多智能体系统的偏差;3)揭示了内部专业化、底层LLM和智能体间通信协议对偏差的影响。

关键设计:在实验设计方面,论文使用了三个偏差基准测试来评估系统的偏差程度。同时,论文还设计了不同的交互场景,例如合作、竞争和辩论,以研究不同通信策略对偏差的影响。此外,论文还使用了不同的底层LLM,例如GPT-3和GPT-4,以研究底层模型对偏差的影响。具体的参数设置和损失函数等技术细节在论文中未详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,多智能体系统通常不如单智能体系统鲁棒,更容易受到偏差的影响。然而,合作和基于辩论的沟通可以有效减轻偏差的放大。更强大的底层LLM,例如GPT-4,可以提高整体系统的稳定性,降低偏差的产生。

🎯 应用场景

该研究成果可应用于构建更公平、更可靠的多智能体系统,例如在招聘、信贷审批等领域,避免因刻板印象偏差导致的不公平决策。此外,该研究还可以帮助开发者更好地理解和控制LLM的偏差,从而提高AI系统的整体安全性。

📄 摘要(原文)

Bias in large language models (LLMs) remains a persistent challenge, manifesting in stereotyping and unfair treatment across social groups. While prior research has primarily focused on individual models, the rise of multi-agent systems (MAS), where multiple LLMs collaborate and communicate, introduces new and largely unexplored dynamics in bias emergence and propagation. In this work, we present a comprehensive study of stereotypical bias in MAS, examining how internal specialization, underlying LLMs and inter-agent communication protocols influence bias robustness, propagation, and amplification. We simulate social contexts where agents represent different social groups and evaluate system behavior under various interaction and adversarial scenarios. Experiments on three bias benchmarks reveal that MAS are generally less robust than single-agent systems, with bias often emerging early through in-group favoritism. However, cooperative and debate-based communication can mitigate bias amplification, while more robust underlying LLMs improve overall system stability. Our findings highlight critical factors shaping fairness and resilience in multi-agent LLM systems.