BitMar: Low-Bit Multimodal Fusion with Episodic Memory for Edge Devices

作者: Euhid Aman, Esteban Carlin, Hsing-Kuo Pao, Giovanni Beltrame, Ghaluh Indah Permata Sari, Yie-Tarng Chen

分类: cs.CL, cs.AI, cs.CV

发布日期: 2025-10-12

备注: 6 pages, BabyLM Workshop, EMNLP 2025

💡 一句话要点

BitMar:面向边缘设备的低比特多模态融合与情景记忆模型

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态融合 边缘计算 低比特量化 情景记忆 图像描述 BitNet Transformer

📋 核心要点

- 现有跨模态Transformer模型计算量大,难以在资源受限的边缘设备上部署。

- BitMar提出一种量化的多模态Transformer,利用低比特编码器和情景记忆实现高效的图像-文本生成。

- BitMar通过逐层调节和滑动窗口注意力,在低延迟和小模型体积下实现了具有竞争力的图像描述和多模态理解能力。

📝 摘要(中文)

跨注意力Transformer和其他多模态视觉-语言模型在对齐和生成方面表现出色;然而,它们庞大且全精度的骨干网络使其难以部署在边缘设备上。记忆增强架构提高了过去上下文的利用率;然而,大多数工作很少将它们与激进的面向边缘的量化相结合。我们介绍了BitMar,一种量化的多模态Transformer,它提出了一种类似人类的外部情景记忆,用于在资源有限的硬件上进行有效的图像-文本生成。BitMar利用1.58比特的编码器,一个用于文本(BitNet风格),一个用于视觉(基于DiNOv2),以创建紧凑的嵌入,这些嵌入被组合并用于查询固定大小的键值情景记忆。在向量检索期间,BitNet解码器应用逐层调节,这增加了生成内容的上下文相关性。解码器还采用带有滑动窗口机制的注意力汇聚,以在严格的内存预算下处理长输入或流输入。逐层调节和滑动窗口注意力的结合实现了强大的质量-速度权衡,以低延迟和小模型占用空间提供有竞争力的字幕和多模态理解。这些特性使BitMar非常适合边缘部署。

🔬 方法详解

问题定义:论文旨在解决多模态视觉-语言模型在边缘设备上部署的难题。现有方法,如全精度Transformer,计算量大,内存占用高,难以满足边缘设备的资源限制。此外,虽然记忆增强架构可以提高上下文利用率,但很少有工作将其与激进的量化技术结合,以进一步降低模型大小和计算复杂度。

核心思路:BitMar的核心思路是利用低比特量化、情景记忆和优化的注意力机制,在保证模型性能的同时,显著降低模型大小和计算复杂度,使其能够在边缘设备上高效运行。通过模仿人类的情景记忆,模型能够更好地利用过去的信息,提高生成内容的质量。

技术框架:BitMar的整体架构包括:1) 低比特视觉编码器(基于DiNOv2);2) 低比特文本编码器(BitNet风格);3) 情景记忆模块(固定大小的键值存储);4) BitNet解码器,带有逐层调节和滑动窗口注意力机制。视觉和文本编码器将输入图像和文本转换为紧凑的嵌入,然后用于查询情景记忆。解码器利用情景记忆中的信息生成目标文本,并通过逐层调节和滑动窗口注意力机制提高生成质量和效率。

关键创新:BitMar的关键创新在于:1) 采用极低比特(1.58-bit)的编码器,显著降低了模型大小和计算复杂度;2) 引入情景记忆模块,增强了模型对上下文信息的利用能力;3) 提出逐层调节和滑动窗口注意力机制,在保证生成质量的同时,提高了计算效率,特别是在处理长输入时。

关键设计:BitMar的关键设计包括:1) 使用BitNet风格的文本编码器,采用逐位操作,降低计算复杂度;2) 基于DiNOv2的视觉编码器,提取图像的有效特征;3) 固定大小的情景记忆,避免了无限增长的内存需求;4) 逐层调节,使解码器能够根据不同层的上下文信息进行调整;5) 滑动窗口注意力机制,限制了注意力范围,降低了计算复杂度,并允许处理长输入。

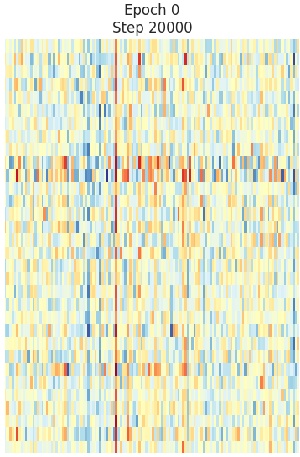

🖼️ 关键图片

📊 实验亮点

论文提出的BitMar模型在低延迟和小模型体积下实现了具有竞争力的图像描述和多模态理解能力。通过1.58比特的编码器和优化的注意力机制,BitMar在边缘设备上实现了高效的图像-文本生成。具体的性能数据和对比基线在论文中给出,展示了BitMar在模型大小、计算速度和生成质量方面的优势。

🎯 应用场景

BitMar适用于各种边缘计算场景,例如智能摄像头、机器人和可穿戴设备。它可以用于图像描述、视觉问答、多模态对话等任务,为用户提供更智能、更便捷的服务。该研究的实际价值在于降低了多模态模型的部署门槛,使其能够在资源受限的设备上运行,从而推动人工智能在边缘端的普及。未来,BitMar可以进一步扩展到其他模态,例如音频和触觉,以实现更全面的多模态理解和生成。

📄 摘要(原文)

Cross-attention transformers and other multimodal vision-language models excel at grounding and generation; however, their extensive, full-precision backbones make it challenging to deploy them on edge devices. Memory-augmented architectures enhance the utilization of past context; however, most works rarely pair them with aggressive edge-oriented quantization. We introduce BitMar, a quantized multimodal transformer that proposes an external human-like episodic memory for effective image-text generation on hardware with limited resources. BitMar utilizes 1.58-bit encoders, one for text (BitNet-style) and one for vision (DiNOv2-based), to create compact embeddings that are combined and used to query a fixed-size key-value episodic memory. During vector retrieval, the BitNet decoder applies per-layer conditioning, which increases the contextual relevance of generated content. The decoder also employs attention sinks with a sliding-window mechanism to process long or streaming inputs under tight memory budgets. The combination of per-layer conditioning and sliding-window attention achieves a strong quality-speed trade-off, delivering competitive captioning and multimodal understanding at low latency with a small model footprint. These characteristics make BitMar well-suited for edge deployment.