EvoEdit: Evolving Null-space Alignment for Robust and Efficient Knowledge Editing

作者: Sicheng Lyu, Yu Gu, Xinyu Wang, Jerry Huang, Sitao Luan, Yufei Cui, Xiao-Wen Chang, Peng Lu

分类: cs.CL, cs.LG

发布日期: 2025-10-11

💡 一句话要点

EvoEdit:通过演化零空间对齐实现鲁棒高效的知识编辑

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 知识编辑 大型语言模型 灾难性遗忘 零空间对齐 顺序学习

📋 核心要点

- 现有模型编辑方法在顺序编辑中存在灾难性干扰,导致新编辑破坏旧知识。

- EvoEdit通过顺序零空间对齐,在编辑过程中保持原始和已修改知识的表示。

- 实验表明,EvoEdit在速度上优于现有方法,并在知识保留方面表现出色。

📝 摘要(中文)

大型语言模型(LLMs)需要持续更新以纠正过时或错误的知识。模型编辑已成为一种引人注目的范例,用于引入有针对性的修改,而无需完全重新训练的计算负担。现有的方法主要基于“定位-然后-编辑”的框架。然而,在顺序编辑的上下文中,随着时间的推移应用多个更新时,它们表现出显著的局限性,并遭受灾难性干扰,即新的编辑会损害先前集成的更新并降低保留的知识。为了应对这些挑战,我们引入了EvoEdit,一种新颖的编辑策略,通过顺序零空间对齐来减轻灾难性干扰,从而实现稳定而高效的模型编辑。通过对每个传入的编辑执行顺序零空间对齐,EvoEdit保留了原始和先前修改的知识表示,并在保留的知识上保持输出不变性,即使在较长的编辑序列中也是如此,从而有效地减轻了干扰。在真实世界的顺序知识编辑基准上的评估表明,EvoEdit实现了比现有最先进的“定位-然后-编辑”技术更好或相当的性能,并且速度提高了3.53倍。总的来说,这些结果强调了在动态演变的信息环境中开发更具原则性的LLM设计方法的必要性,同时提供了一个简单而有效的解决方案,并具有强大的理论保证。

🔬 方法详解

问题定义:论文旨在解决大型语言模型在进行连续知识编辑时出现的灾难性遗忘问题。现有的“定位-然后-编辑”方法在顺序应用多个知识更新时,会相互干扰,导致先前编辑的知识被覆盖或损坏,从而降低模型的整体性能和可靠性。

核心思路:EvoEdit的核心思路是通过零空间对齐来避免不同编辑之间的干扰。具体来说,对于每一个新的知识编辑,EvoEdit会找到一个与先前所有编辑操作的零空间对齐的更新方向。这意味着新的编辑操作不会影响先前编辑所修改的知识,从而保证了知识的累积性和一致性。这种方法的设计目标是确保模型在不断学习新知识的同时,能够稳定地保持已有的知识。

技术框架:EvoEdit的技术框架主要包含以下几个步骤:1) 接收新的知识编辑请求;2) 计算当前编辑操作的更新方向;3) 将该更新方向投影到先前所有编辑操作的零空间中,得到最终的更新方向;4) 使用该更新方向更新模型参数。这个过程保证了新的编辑操作不会干扰到先前编辑的知识。

关键创新:EvoEdit最重要的技术创新点在于其顺序零空间对齐策略。与现有方法不同,EvoEdit不是简单地修改模型参数,而是通过寻找与先前编辑操作正交的更新方向来避免干扰。这种方法能够有效地缓解灾难性遗忘问题,并保证模型在进行连续知识编辑时的稳定性和可靠性。

关键设计:EvoEdit的关键设计包括:1) 使用正交投影算子来计算更新方向在零空间中的投影;2) 采用迭代的方式来计算零空间,以提高计算效率;3) 设计了一种损失函数,用于衡量编辑操作对先前知识的影响,并将其作为零空间对齐的约束条件。

🖼️ 关键图片

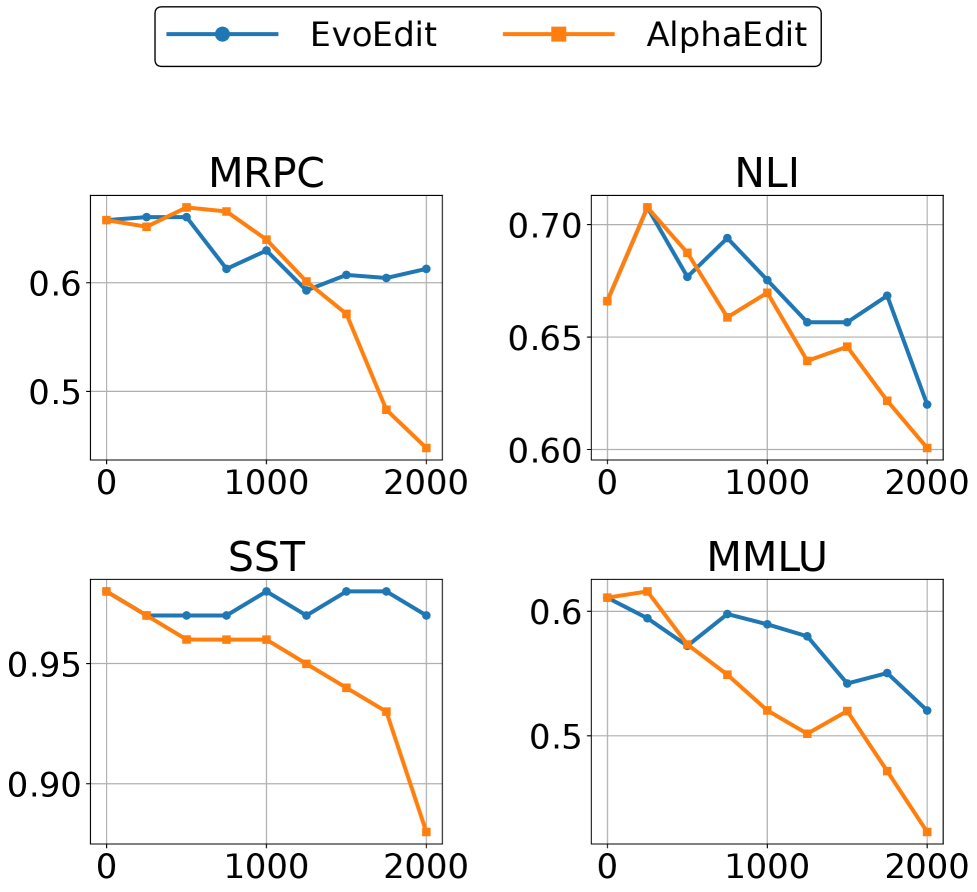

📊 实验亮点

EvoEdit在真实世界的顺序知识编辑基准测试中表现出色,与现有最先进的“定位-然后-编辑”技术相比,实现了更好或相当的性能,并且速度提高了3.53倍。这表明EvoEdit在保证知识编辑质量的同时,显著提升了编辑效率,为实际应用提供了更优的解决方案。

🎯 应用场景

EvoEdit可应用于需要持续更新知识的大型语言模型,例如问答系统、对话机器人和知识图谱。它能有效解决模型在动态信息环境中知识更新的难题,提高模型的长期性能和可靠性,并降低维护成本。未来,该技术有望应用于更广泛的AI系统中,提升其适应性和智能化水平。

📄 摘要(原文)

Large language models (LLMs) require continual updates to rectify outdated or erroneous knowledge. Model editing has emerged as a compelling paradigm for introducing targeted modifications without the computational burden of full retraining. Existing approaches are mainly based on a locate-then-edit framework. However, in sequential editing contexts, where multiple updates are applied over time, they exhibit significant limitations and suffer from catastrophic interference, i.e., new edits compromise previously integrated updates and degrade preserved knowledge. To address these challenges, we introduce EvoEdit, a novel editing strategy that mitigates catastrophic interference through sequential null-space alignment, enabling stable and efficient model editing. By performing sequential null-space alignment for each incoming edit, EvoEdit preserves both original and previously modified knowledge representations and maintains output invariance on preserved knowledge even across long edit sequences, effectively mitigating interference. Evaluations on real-world sequential knowledge-editing benchmarks show that EvoEdit achieves better or comparable performance than prior state-of-the-art locate-then-edit techniques, with up to 3.53 times speedup. Overall, these results underscore the necessity of developing more principled approaches for designing LLMs in dynamically evolving information settings, while providing a simple yet effective solution with strong theoretical guarantees.