Language steering in latent space to mitigate unintended code-switching

作者: Andrey Goncharov, Nikolai Kondusov, Alexey Zaytsev

分类: cs.CL, cs.LG

发布日期: 2025-10-11

💡 一句话要点

提出基于隐空间语言引导的方法,用于缓解大型语言模型中意外的代码切换问题。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 代码切换 多语言模型 隐空间 语言引导 主成分分析

📋 核心要点

- 多语言LLM的代码切换问题降低了模型在特定语言任务中的可靠性,现有方法难以有效控制。

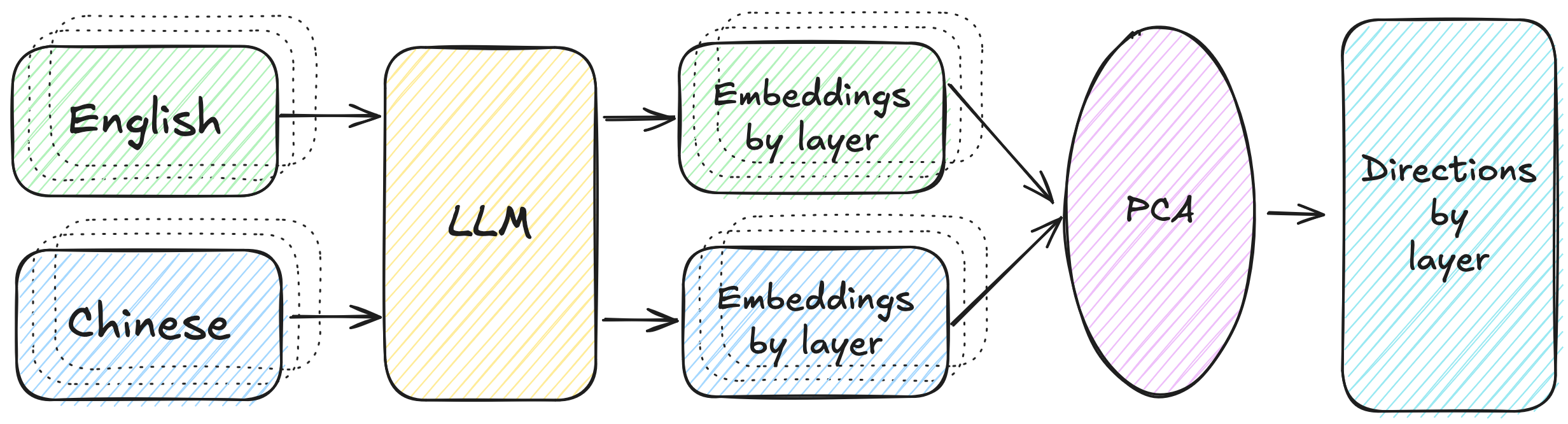

- 该论文提出隐空间语言引导方法,通过PCA识别语言方向,并在推理时引导token嵌入,从而控制语言身份。

- 实验表明,该方法能显著降低代码切换,提高语言分类准确率,且计算开销小,易于部署。

📝 摘要(中文)

多语言大型语言模型(LLM)经常表现出意外的代码切换现象,降低了其在下游任务中的可靠性。我们提出了一种隐空间语言引导方法,这是一种轻量级的推理时方法,通过对并行翻译进行主成分分析(PCA)来识别语言方向,并沿着这些轴引导token嵌入,以控制语言身份。我们的方法在保持语义的同时减轻了代码切换,计算开销可忽略不计,并且只需要最少的并行数据进行校准。实验结果表明,我们使用单个主成分实现了95-99%的语言分类准确率,并在Qwen2.5和Llama-3.2模型上,跨多个语言对,将下一个token的分布差异降低了高达42%。我们进一步分析了语言表征的逐层演变,揭示了语言身份集中在最后几层,并具有近乎完美的线性可分性。

🔬 方法详解

问题定义:论文旨在解决多语言大型语言模型中出现的意外代码切换问题。现有方法在控制语言输出方面存在不足,导致模型在生成文本时频繁切换语言,影响了其在特定语言任务中的性能和可靠性。这种不必要的代码切换是现有方法的一个痛点。

核心思路:论文的核心思路是在模型的隐空间中找到代表不同语言方向的向量,并在推理过程中引导token嵌入沿着目标语言的方向移动。通过这种方式,模型可以更好地保持语言一致性,减少代码切换的发生。这种方法的设计基于语言在隐空间中具有一定可分离性的假设。

技术框架:该方法主要包含以下几个阶段:1) 使用并行翻译数据。2) 对token嵌入进行主成分分析(PCA),以识别代表不同语言方向的主成分。3) 在推理时,根据目标语言,沿着相应的主成分方向调整token嵌入。4) 将调整后的token嵌入输入到LLM中生成文本。

关键创新:该方法的关键创新在于利用PCA在隐空间中识别语言方向,并使用这些方向来引导token嵌入。与现有方法相比,该方法更加轻量级,只需要少量的并行数据进行校准,并且计算开销很小,可以在推理时实时应用。此外,该方法直接作用于token嵌入,可以更直接地控制语言输出。

关键设计:该方法的关键设计包括:1) 使用PCA提取语言方向的主成分数量。论文实验表明,使用单个主成分即可达到较好的效果。2) 引导token嵌入的强度。需要仔细调整引导强度,以在减少代码切换和保持语义之间取得平衡。3) 语言方向的确定。需要高质量的并行翻译数据来准确地识别语言方向。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法使用单个主成分即可实现95-99%的语言分类准确率。在Qwen2.5和Llama-3.2模型上,跨多个语言对,该方法将下一个token的分布差异降低了高达42%。这些结果表明,该方法能够有效地减少代码切换,提高语言一致性,且具有良好的泛化能力。

🎯 应用场景

该研究成果可应用于需要高精度语言控制的场景,例如机器翻译、多语言对话系统、以及面向特定语言用户的文本生成应用。通过减少代码切换,可以提高这些应用的用户体验和可靠性。此外,该方法还可以用于分析和理解LLM中的语言表征,为模型改进提供 insights。

📄 摘要(原文)

Multilingual Large Language Models (LLMs) often exhibit unintended code-switching, reducing reliability in downstream tasks. We propose latent-space language steering, a lightweight inference-time method that identifies language directions via PCA on parallel translations and steers token embeddings along these axes to control language identity. Our approach mitigates code-switching while preserving semantics with negligible computational overhead and requires only minimal parallel data for calibration. Empirically, we achieve 95-99\% language classification accuracy using a single principal component and reduce next-token distributional divergence by up to 42% across multiple language pairs on Qwen2.5 and Llama-3.2 models. We further analyze the layer-wise evolution of language representations, revealing that language identity concentrates in final layers with near-perfect linear separability.