Unifying Tree Search Algorithm and Reward Design for LLM Reasoning: A Survey

作者: Jiaqi Wei, Xiang Zhang, Yuejin Yang, Wenxuan Huang, Juntai Cao, Sheng Xu, Xiang Zhuang, Zhangyang Gao, Muhammad Abdul-Mageed, Laks V. S. Lakshmanan, Chenyu You, Wanli Ouyang, Siqi Sun

分类: cs.CL

发布日期: 2025-10-11

💡 一句话要点

统一树搜索算法与奖励设计的LLM推理综述:形式化与未来方向

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 树搜索算法 奖励设计 推理 自我改进

📋 核心要点

- 现有LLM推理方法缺乏统一的形式化框架,尤其是在奖励信号的角色定义上存在模糊性,阻碍了领域内的系统性进展。

- 论文提出了一个统一的框架,将树搜索算法分解为搜索机制、奖励公式和转移函数三个核心组件,从而区分瞬时搜索指导和持久参数化奖励建模。

- 该综述构建了一个以组件为中心的分类法,对现有技术进行了综合,并为未来自主、自我改进的智能体研究规划了路线图。

📝 摘要(中文)

本文对大型语言模型(LLM)推理中基于树搜索的算法进行了综述,该算法是现代LLM研究的基石,推动了从暴力扩展到算法效率的转变。这种范式统一了两个关键前沿:测试时扩展(TTS),它部署按需计算来解决难题;以及自我改进,它使用搜索生成的数据来持久地增强模型参数。然而,这个新兴领域是分散的,缺乏一个共同的形式体系,特别是关于奖励信号的模糊作用——它是一个瞬时启发式还是一个持久的学习目标?本文通过引入一个统一的框架来解决这种模糊性,该框架将搜索算法解构为三个核心组成部分:搜索机制、奖励公式和转移函数。我们建立了TTS的瞬时搜索指导和自我改进的持久参数化奖励建模之间的正式区别。在此形式体系的基础上,我们引入了一个以组件为中心的分类法,综合了最先进的技术,并规划了一个研究路线图,以在创建自主、自我改进的代理方面取得更系统的进展。

🔬 方法详解

问题定义:现有的大型语言模型(LLM)推理方法,特别是基于树搜索的算法,虽然在解决复杂问题和自我改进方面展现出潜力,但缺乏一个统一的形式化框架。这导致研究方向分散,难以系统性地理解和改进这些算法。一个关键的痛点在于奖励信号的角色不明确,难以区分其作为瞬时启发式指导搜索和作为持久学习目标的参数化建模的不同作用。

核心思路:论文的核心思路是将树搜索算法解构为三个核心组件:搜索机制、奖励公式和转移函数。通过这种解构,可以更清晰地理解每个组件的作用,并区分奖励信号的两种不同角色:瞬时搜索指导(Search Guidance)和持久参数化奖励建模(Parametric Reward Modeling)。这种区分有助于更好地设计和优化树搜索算法,并促进LLM的自我改进。

技术框架:论文提出的统一框架包含以下几个主要部分:首先,对现有的树搜索算法进行形式化描述,将其分解为搜索机制、奖励公式和转移函数三个核心组件。其次,明确区分瞬时搜索指导和持久参数化奖励建模两种不同的奖励信号角色。第三,基于这种形式化和区分,构建一个以组件为中心的分类法,对现有的树搜索算法进行分类和比较。最后,基于对现有技术的综合分析,提出未来研究的路线图,旨在推动LLM在自主、自我改进方面的进展。

关键创新:论文最重要的技术创新点在于提出了一个统一的框架,用于形式化描述和分析基于树搜索的LLM推理算法。该框架通过将算法解构为搜索机制、奖励公式和转移函数三个核心组件,并明确区分瞬时搜索指导和持久参数化奖励建模两种不同的奖励信号角色,解决了现有研究中存在的模糊性和分散性问题。

关键设计:论文的关键设计在于对奖励信号角色的区分。瞬时搜索指导是指在搜索过程中使用的启发式信息,用于指导搜索方向,例如,使用模型置信度或中间步骤的正确性作为奖励。持久参数化奖励建模是指将奖励信号建模为一个可学习的函数,该函数可以根据搜索生成的数据进行更新,从而提高模型在未来推理中的性能。这种区分有助于更好地设计奖励函数,并利用搜索生成的数据来持久地改进模型参数。

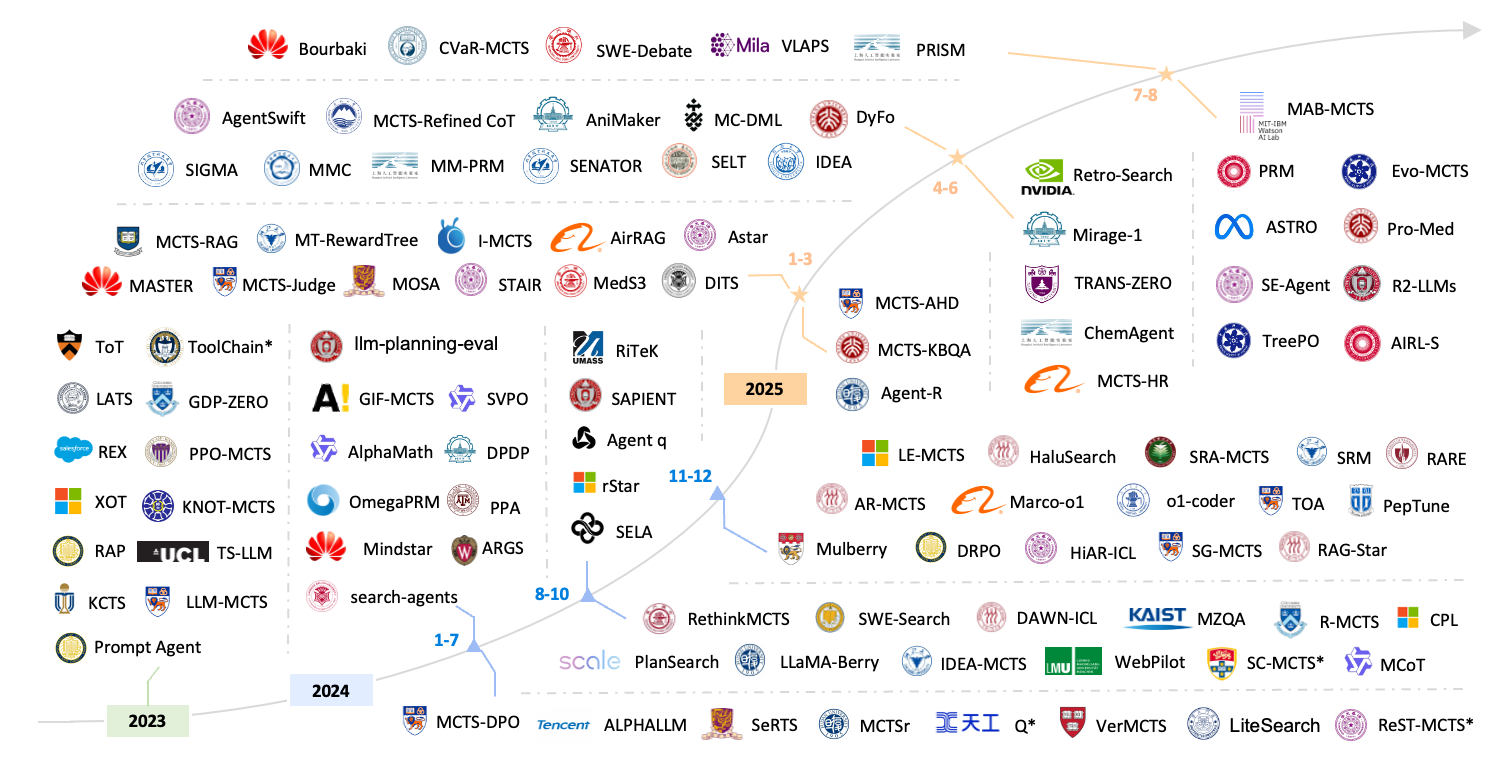

🖼️ 关键图片

📊 实验亮点

该综述论文的主要亮点在于提出了一个统一的框架,用于形式化描述和分析基于树搜索的LLM推理算法,并明确区分了瞬时搜索指导和持久参数化奖励建模两种不同的奖励信号角色。虽然论文本身是综述,没有提供具体的实验数据,但它为未来的研究方向提供了清晰的指导,有望推动LLM在复杂推理任务上的性能提升。

🎯 应用场景

该研究成果可应用于各种需要复杂推理和决策的领域,例如智能客服、自动驾驶、游戏AI、科学发现等。通过更有效地利用树搜索算法和奖励设计,可以提升LLM在这些领域的性能和可靠性,实现更智能、更自主的系统。未来的研究方向包括探索更有效的搜索机制、更精确的奖励建模方法,以及更有效的自我改进策略。

📄 摘要(原文)

Deliberative tree search is a cornerstone of modern Large Language Model (LLM) research, driving the pivot from brute-force scaling toward algorithmic efficiency. This single paradigm unifies two critical frontiers: \textbf{Test-Time Scaling (TTS)}, which deploys on-demand computation to solve hard problems, and \textbf{Self-Improvement}, which uses search-generated data to durably enhance model parameters. However, this burgeoning field is fragmented and lacks a common formalism, particularly concerning the ambiguous role of the reward signal -- is it a transient heuristic or a durable learning target? This paper resolves this ambiguity by introducing a unified framework that deconstructs search algorithms into three core components: the \emph{Search Mechanism}, \emph{Reward Formulation}, and \emph{Transition Function}. We establish a formal distinction between transient \textbf{Search Guidance} for TTS and durable \textbf{Parametric Reward Modeling} for Self-Improvement. Building on this formalism, we introduce a component-centric taxonomy, synthesize the state-of-the-art, and chart a research roadmap toward more systematic progress in creating autonomous, self-improving agents.