Abductive Preference Learning

作者: Yijin Ni, Peng Qi

分类: cs.CL

发布日期: 2025-10-10

💡 一句话要点

提出溯因偏好学习,提升大模型对反事实提示的敏感性

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 偏好学习 大语言模型 反事实推理 溯因推理 提示工程 DPO 多任务学习

📋 核心要点

- 现有偏好学习方法在处理反事实提示时存在不足,导致大模型在相似问题上给出相同保守回答。

- 论文提出溯因偏好学习,通过学习给定响应的提示偏好,提升模型对提示差异的敏感性。

- 实验结果表明,多任务溯因DPOP在响应选择和提示区分方面均有显著提升,并提高了胜率。

📝 摘要(中文)

大型语言模型(如GPT-5和Claude Sonnet)即使经过RLHF和DPO等对齐,仍然容易过度自信。例如,对于“隔夜的[食物/薯片]是否可以食用?”这类问题,模型倾向于给出保守的“否”回答,而后者在无需冷藏的情况下也可安全食用。研究发现,这可能归因于现有偏好学习的局限性:它强调为给定提示选择正确的响应,而忽略了应该改变响应的反事实提示。为了解决这个问题,论文提出溯因偏好学习,这是一种通过学习给定响应的提示偏好来逆转传统条件反射的微调范式。为了验证这个想法,论文构建了一个源自HaluEval QA基准的溯因数据集,包含1001个条目,并实现了溯因DPO及其变体DPOP。实验表明,标准方法改进了响应选择,溯因方法改进了提示区分,而多任务目标统一了两者。在溯因数据集上,多任务DPOP将响应选择的准确率从90.0%提高到99.5%,并将提示区分的准确率从54.7%提高到85.0%,定性证据表明模型对提示差异的敏感性有所提高。最后,在AlpacaEval上的评估表明,多任务DPOP提高了胜率(从5.26%到6.17%),证实了溯因偏好学习保留了传统偏好优化的优势,同时解决了反事实提示这一被忽视的挑战。

🔬 方法详解

问题定义:现有偏好学习方法主要关注给定提示下选择最佳响应,忽略了反事实提示(即改变提示内容,但期望模型给出不同响应)的处理。这导致模型在面对相似但需要不同答案的提示时,倾向于给出保守的、一概而论的回答,缺乏对提示细微差异的辨别能力。

核心思路:论文的核心思路是逆转传统的条件反射,不再是学习给定提示下的响应偏好,而是学习给定响应下的提示偏好。通过这种方式,模型能够更好地理解哪些提示应该导致特定的响应,从而提高对反事实提示的敏感性。这种“溯因”的方式,使得模型能够从结果反推原因,从而更好地理解提示的含义。

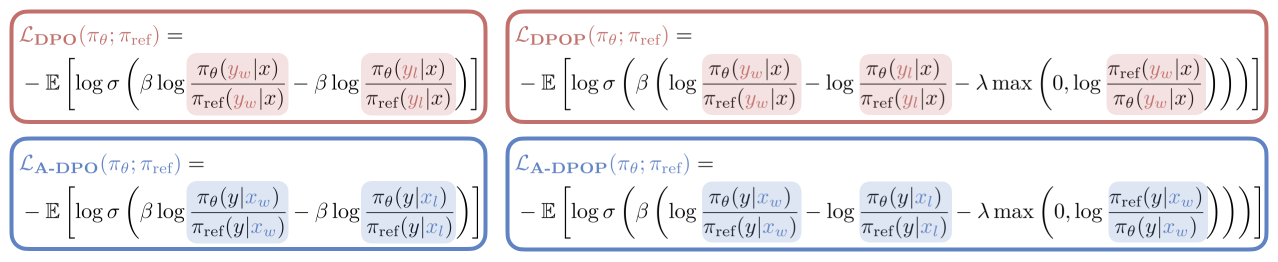

技术框架:整体框架基于Direct Preference Optimization (DPO),并进行了修改以适应溯因学习。主要包含以下步骤:1) 构建溯因数据集,该数据集包含提示、响应以及指示哪些提示应该导致特定响应的信息。2) 使用溯因数据集训练模型,目标是最大化模型对给定响应的正确提示的偏好。3) 采用多任务学习,同时优化传统的响应选择任务和溯因的提示区分任务。

关键创新:最重要的创新点在于提出了溯因偏好学习的概念,并将其应用于大模型的微调。与传统的偏好学习方法不同,溯因偏好学习关注的是给定响应下的提示偏好,从而提高了模型对反事实提示的敏感性。这种方法能够有效地解决大模型在面对相似但需要不同答案的提示时,倾向于给出保守回答的问题。

关键设计:论文采用了Direct Preference Optimization (DPO) 作为基础框架,并对其进行了修改以适应溯因学习。具体来说,损失函数被修改为最大化模型对给定响应的正确提示的偏好。此外,论文还采用了多任务学习,同时优化传统的响应选择任务和溯因的提示区分任务。这种多任务学习的方式能够有效地平衡模型的性能,使其在响应选择和提示区分方面都能够取得较好的效果。论文还提出了DPOP的变体,具体细节未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,多任务DPOP在溯因数据集上显著提升了响应选择和提示区分的准确率,响应选择准确率从90.0%提升到99.5%,提示区分准确率从54.7%提升到85.0%。此外,在AlpacaEval上的评估表明,多任务DPOP提高了胜率(从5.26%到6.17%),证实了溯因偏好学习在提升模型性能的同时,保留了传统偏好优化的优势。

🎯 应用场景

该研究成果可应用于提升大型语言模型在问答、对话等场景下的智能化水平,尤其是在需要模型对细微提示差异做出不同响应的场景中。例如,在医疗咨询、法律咨询等领域,模型需要能够准确理解用户提出的问题,并根据问题的具体情况给出个性化的回答。该研究还有助于提高模型的安全性和可靠性,避免模型给出不准确或误导性的回答。

📄 摘要(原文)

Frontier large language models such as GPT-5 and Claude Sonnet remain prone to overconfidence even after alignment through Reinforcement Learning with Human Feedback (RLHF) and Direct Preference Optimization (DPO). For instance, they tend to offer the same conservative answer "No" to both questions "Can I eat the [food / potato chips] that has been left out overnight?" despite the latter requiring no refridgeration for safe consumption. We find that this failure is potentially attributed to a limitation of existing preference learning: it emphasizes selecting the correct response for a given prompt, while neglecting counterfactual prompts that should alter the response. To address this limitation, we propose abductive preference learning, a fine-tuning paradigm that reverses the conventional conditioning by learning preferences over prompts given a response. To validate this idea, we construct an abductive dataset derived from the HaluEval QA benchmark with 1,001 entries, implementing abductive DPO and its variant DPOP. Experiments reveal complementary strengths: standard methods improve response selection, abductive methods improve prompt discrimination, while a multitask objective unifies both. On the abductive dataset, multitask DPOP boosts accuracy from $90.0\%$ to $99.5\%$ in response selection and $54.7\%$ to $85.0\%$ in prompt discrimination, with qualitative evidence highlighting improved sensitivity to prompt differences. Finally, evaluation on AlpacaEval shows multitask DPOP improves win rate (from $5.26\%$ to $6.17\%$), confirming that abductive preference learning preserves the benefits of conventional preference optimization while addressing the overlooked challenge of counterfactual prompts.