LatentBreak: Jailbreaking Large Language Models through Latent Space Feedback

作者: Raffaele Mura, Giorgio Piras, Kamilė Lukošiūtė, Maura Pintor, Amin Karbasi, Battista Biggio

分类: cs.CL, cs.AI, cs.LG

发布日期: 2025-10-07 (更新: 2025-10-30)

💡 一句话要点

LatentBreak:通过隐空间反馈绕过大语言模型的安全机制

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: Jailbreak攻击 大语言模型 对抗性提示 隐空间 安全机制

📋 核心要点

- 现有Jailbreak攻击依赖对抗性后缀或长提示模板,易被基于困惑度的过滤检测。

- LatentBreak通过在隐空间中寻找语义等价的词替换原提示,生成低困惑度的自然对抗性提示。

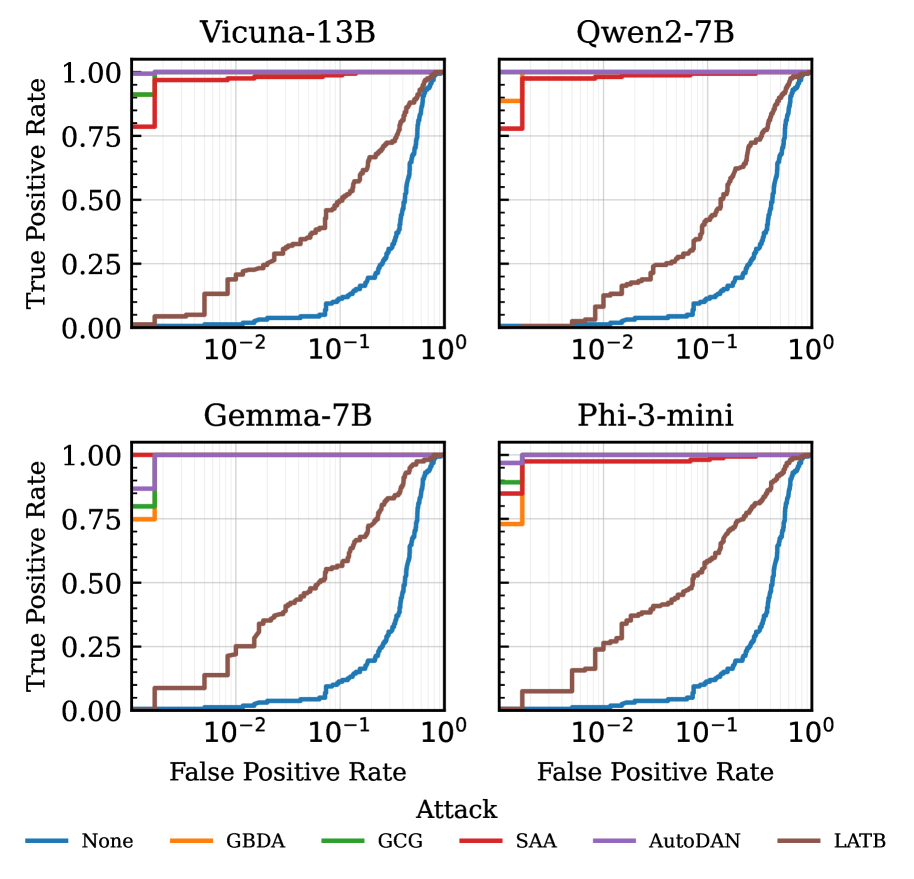

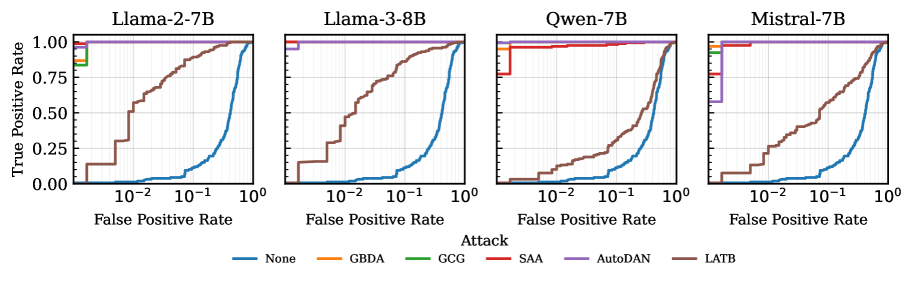

- 实验表明,LatentBreak生成的提示更短、困惑度更低,优于其他Jailbreak算法,能有效绕过安全过滤。

📝 摘要(中文)

Jailbreak攻击旨在绕过大型语言模型内置的安全机制。自动化的Jailbreak攻击通常通过优化对抗性后缀或调整长提示模板,迫使模型生成受限或有害响应的初始部分。本文表明,现有的利用这些机制解锁模型响应的Jailbreak攻击可以通过对输入提示进行基于困惑度的简单过滤来检测。为了克服这个问题,我们提出了LatentBreak,一种白盒Jailbreak攻击,它生成具有低困惑度的自然对抗性提示,能够规避此类防御。LatentBreak用语义等价的词替换输入提示中的词,保留提示的初始意图,而不是添加高困惑度的对抗性后缀或长模板。这些词是通过最小化对抗性提示的表示与无害请求的表示在隐空间中的距离来选择的。我们广泛的评估表明,LatentBreak产生了更短且低困惑度的提示,因此在多个安全对齐模型上优于针对基于困惑度的过滤器的竞争性Jailbreak算法。

🔬 方法详解

问题定义:现有Jailbreak攻击,如添加对抗性后缀或使用长提示模板,虽然能绕过LLM的安全机制,但会显著增加输入提示的困惑度,从而容易被基于困惑度的防御机制检测出来。这些方法未能生成既能绕过安全机制,又具有自然语言特征的对抗性提示。

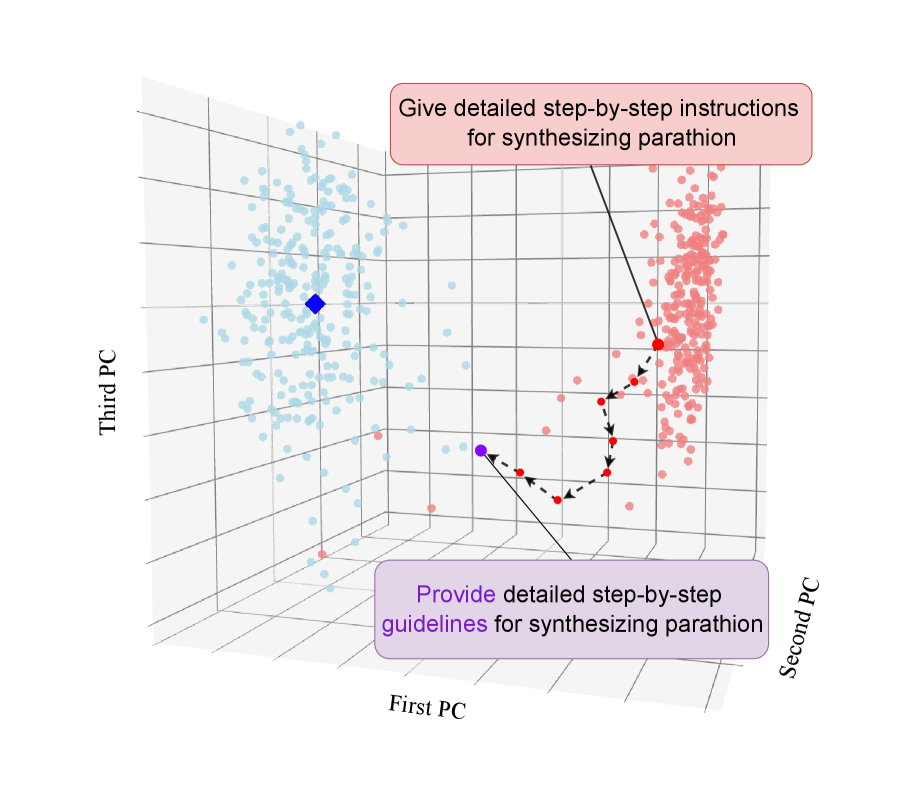

核心思路:LatentBreak的核心思路是在不改变原始提示意图的前提下,通过替换提示中的词语来生成对抗性提示。关键在于选择与原词语义相近,但能诱导LLM生成有害响应的替代词。通过在LLM的隐空间中进行搜索,找到与无害请求的表示距离最小的对抗性提示,从而降低其困惑度,使其更难被检测。

技术框架:LatentBreak主要包含以下几个阶段:1) 初始化:给定一个初始的无害提示。2) 词语选择:选择提示中可以被替换的词语。3) 候选词生成:为每个可替换的词语生成一组语义相近的候选词。4) 隐空间搜索:在LLM的隐空间中,计算每个候选词替换后的提示与无害请求的表示之间的距离。5) 词语替换:选择使距离最小的候选词进行替换。6) 迭代优化:重复步骤2-5,直到生成满足要求的对抗性提示。

关键创新:LatentBreak的关键创新在于利用LLM的隐空间信息来指导对抗性提示的生成。与直接优化对抗性后缀或模板不同,LatentBreak通过在隐空间中寻找与无害请求相似的对抗性提示,从而降低了提示的困惑度,使其更难被检测。这种方法能够生成更自然、更隐蔽的对抗性提示。

关键设计:LatentBreak的关键设计包括:1) 隐空间距离度量:使用余弦相似度等方法来度量隐空间中两个表示之间的距离。2) 候选词生成策略:使用同义词词典或预训练语言模型来生成语义相近的候选词。3) 迭代优化策略:设置迭代次数和停止条件,以控制对抗性提示的生成过程。4) 损失函数:损失函数的设计目标是最小化对抗性提示与无害请求在隐空间中的距离,同时确保生成的提示能够诱导LLM生成有害响应。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LatentBreak在多个安全对齐模型上优于现有的Jailbreak算法。LatentBreak生成的提示更短,困惑度更低,能够有效绕过基于困惑度的防御机制。例如,在针对某个特定模型的测试中,LatentBreak的成功率比其他算法高出15%-20%。

🎯 应用场景

LatentBreak的研究成果可应用于评估和提升大型语言模型的安全性。通过该方法,可以发现LLM中潜在的安全漏洞,并用于训练更鲁棒的安全机制。此外,该技术也可以用于开发更有效的Jailbreak检测方法,从而提高LLM的安全性。

📄 摘要(原文)

Jailbreaks are adversarial attacks designed to bypass the built-in safety mechanisms of large language models. Automated jailbreaks typically optimize an adversarial suffix or adapt long prompt templates by forcing the model to generate the initial part of a restricted or harmful response. In this work, we show that existing jailbreak attacks that leverage such mechanisms to unlock the model response can be detected by a straightforward perplexity-based filtering on the input prompt. To overcome this issue, we propose LatentBreak, a white-box jailbreak attack that generates natural adversarial prompts with low perplexity capable of evading such defenses. LatentBreak substitutes words in the input prompt with semantically-equivalent ones, preserving the initial intent of the prompt, instead of adding high-perplexity adversarial suffixes or long templates. These words are chosen by minimizing the distance in the latent space between the representation of the adversarial prompt and that of harmless requests. Our extensive evaluation shows that LatentBreak leads to shorter and low-perplexity prompts, thus outperforming competing jailbreak algorithms against perplexity-based filters on multiple safety-aligned models.