Peeking inside the Black-Box: Reinforcement Learning for Explainable and Accurate Relation Extraction

作者: Xinyu Guo, Zhengliang Shi, Minglai Yang, Mahdi Rahimi, Mihai Surdeanu

分类: cs.CL, cs.IR

发布日期: 2025-10-07

备注: Working in process

💡 一句话要点

CogRE:利用强化学习提升关系抽取准确性和可解释性

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 关系抽取 强化学习 可解释性 认知科学 一次性学习

📋 核心要点

- 现有关系抽取方法缺乏对语言解释的有效监督,难以提供可信的推理过程。

- CogRE框架通过认知科学启发的推理步骤和强化学习优化,提升关系抽取的准确性和可解释性。

- 实验表明,CogRE在一次性关系抽取任务中显著提升了性能,并生成了与人工标注更一致的解释。

📝 摘要(中文)

本文提出了一种关系抽取(RE)框架,旨在提高准确性和可解释性。该框架包含两个关键组成部分:(i)一种受认知科学启发的推理机制,将关系抽取构建为一系列文本处理步骤;(ii)一个由强化学习(RL)驱动的优化过程,该过程采用一种新颖的奖励函数,旨在提高任务准确性和解释质量。我们将该方法称为CogRE。我们的框架通过促进包含重要关系关键词的输出来解决传统RE中缺乏基于语言的解释监督的问题。这些关键词来自使用LLM自动构建的高质量词典。我们使用两个LLM和两个RE数据集评估了我们方法在一次性RE任务上的性能。实验表明,CogRE通过解决一次性RE中的两个常见失败模式(注意力焦点不佳和一次性学习能力有限)来提高解释质量。例如,我们在One-shot NYT29上使用Qwen2.5-15B-Instruct的认知结构化推理实现了24.65%的F1值,超过了先前的基于推理的设计。使用我们的奖励通过RL优化这种方法进一步提高了+23.46%(绝对值)的性能。最后,人工评估表明,我们最好的模型生成的关系关键词与黄金标签高度一致,使人工解释质量评分提高了54%(相对值)。

🔬 方法详解

问题定义:论文旨在解决关系抽取任务中准确性和可解释性不足的问题。现有方法通常缺乏对模型推理过程的有效监督,导致模型难以提供清晰、可信的解释,尤其是在一次性学习场景下,模型容易出现注意力分散和泛化能力不足的问题。

核心思路:论文的核心思路是将关系抽取过程建模为一系列受认知科学启发的文本处理步骤,并利用强化学习来优化这些步骤,从而提高模型的准确性和可解释性。通过引入奖励函数,鼓励模型生成包含重要关系关键词的解释,从而提高解释质量。

技术框架:CogRE框架包含两个主要组成部分:一是基于认知科学的推理机制,将关系抽取分解为多个文本处理步骤;二是基于强化学习的优化过程,利用奖励函数来指导模型的学习,提高准确性和解释质量。框架首先使用大型语言模型(LLM)自动构建高质量的关系关键词词典,然后利用该词典来指导模型的推理过程。

关键创新:论文的关键创新在于将认知科学的推理过程与强化学习相结合,从而实现关系抽取的准确性和可解释性的同步提升。此外,论文还提出了一种新颖的奖励函数,该函数旨在鼓励模型生成包含重要关系关键词的解释,从而提高解释质量。

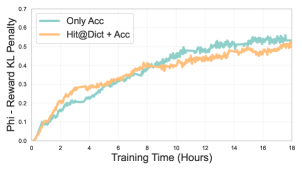

关键设计:奖励函数的设计是关键。它综合考虑了任务的准确性和解释的质量。具体来说,奖励函数会根据模型预测的准确性以及生成的解释中包含的关系关键词与黄金标签的匹配程度来给予奖励。此外,论文还使用了Qwen2.5-15B-Instruct等大型语言模型作为基础模型,并针对一次性学习场景进行了优化。

🖼️ 关键图片

📊 实验亮点

CogRE在One-shot NYT29数据集上,使用Qwen2.5-15B-Instruct模型实现了24.65%的F1值,超过了先前的基于推理的设计。通过强化学习优化,性能进一步提升了23.46%(绝对值)。人工评估显示,CogRE生成的关系关键词与黄金标签高度一致,使人工解释质量评分提高了54%(相对值)。

🎯 应用场景

该研究成果可应用于智能问答、知识图谱构建、信息抽取等领域。通过提供更准确和可解释的关系抽取结果,可以提升下游任务的性能和用户体验。未来,该方法可以扩展到其他自然语言处理任务,例如文本摘要和机器翻译。

📄 摘要(原文)

This paper introduces a framework for relation extraction (RE) that enhances both accuracy and explainability. The framework has two key components: (i) a reasoning mechanism that formulates relation extraction as a series of text-processing steps inspired by cognitive science, and (ii) an optimization process driven by reinforcement learning (RL) with a novel reward function designed to improve both task accuracy and explanation quality. We call our approach CogRE. Our framework addresses the lack of supervision for language-based explanations in traditional RE by promoting outputs that include important relation keywords. These keywords are drawn from a high-quality dictionary that is automatically constructed using an LLM. We evaluate our approach for the task of one-shot RE using two LLMs and two RE datasets. Our experiments show that CogRE improves explanation quality by addressing two common failure patterns in one-shot RE: poor attention focus and limited one-shot learning capability. For example, our cognitive-structured reasoning with Qwen2.5-15B-Instruct on One-shot NYT29 achieves 24.65% F1, surpassing prior reasoning-based designs. Optimizing this approach with RL using our reward further improves performance by +23.46% (absolute). Finally, human evaluation shows that our best model generates relational keywords closely aligned with gold labels, increasing human explanation quality ratings by 54% (relative).