Diversity Is All You Need for Contrastive Learning: Spectral Bounds on Gradient Magnitudes

作者: Peter Ochieng

分类: cs.CL

发布日期: 2025-10-07

💡 一句话要点

提出谱约束的对比学习方法以提升梯度稳定性

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 对比学习 谱约束 梯度稳定性 有效秩 批次选择 计算机视觉 深度学习

📋 核心要点

- 现有对比学习方法在梯度稳定性和收敛速度上存在不足,影响模型性能。

- 本文提出了一种谱约束的批次选择方法,通过有效秩R_eff优化梯度计算。

- 实验结果显示,Greedy-64在ImageNet-100上提升了15%的时间效率,同时保持相同的准确率。

📝 摘要(中文)

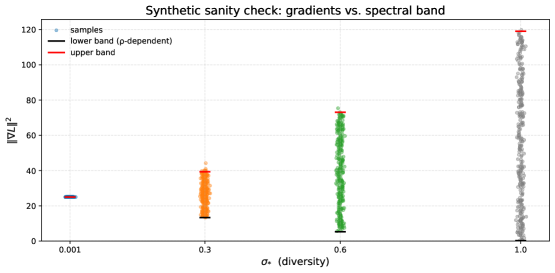

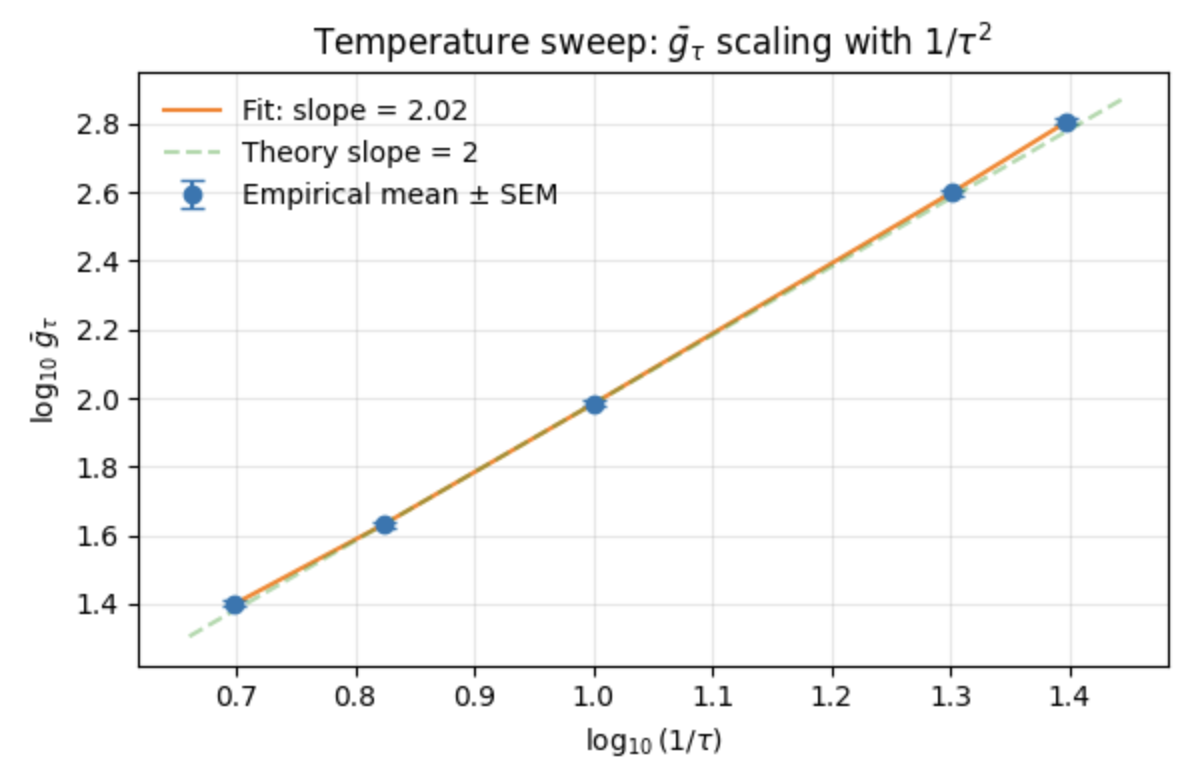

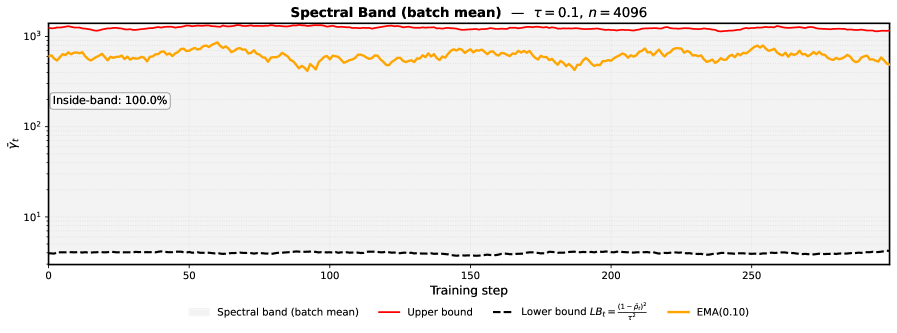

本文推导了非渐近谱带,界定了通过对齐、温度和批次谱来限制平方InfoNCE梯度范数,恢复了1/τ²法则,并在合成数据和ImageNet上紧密跟踪批均梯度。通过将有效秩R_eff作为各向异性代理,设计了谱感知的批次选择方法,包括快速贪婪构建器。在ImageNet-100上,Greedy-64相较于随机方法将时间缩短15%,在相同准确率下提升了67.5%的top-1准确率;CIFAR-10也显示出类似的提升。批内白化促进了各向同性,将50步梯度方差降低了1.37倍,符合理论上限。

🔬 方法详解

问题定义:本文旨在解决现有对比学习方法中梯度不稳定和收敛速度慢的问题,尤其是在大规模数据集上表现不佳。现有方法在处理批次数据时,未能有效利用数据的谱特性,导致梯度计算的方差较大。

核心思路:论文提出通过谱约束来优化批次选择,利用有效秩R_eff作为各向异性代理,从而提高梯度的稳定性和收敛速度。通过设计谱感知的批次选择策略,能够更好地利用数据的内在结构。

技术框架:整体方法包括以下几个主要模块:首先,通过谱分析计算有效秩R_eff;其次,基于有效秩进行批次选择,采用贪婪算法快速构建批次;最后,实施批内白化以促进各向同性,降低梯度方差。

关键创新:最重要的技术创新在于引入谱约束和有效秩R_eff作为批次选择的依据,这与传统随机选择方法本质上不同,能够显著提升梯度的稳定性和模型的训练效率。

关键设计:在参数设置上,采用了温度参数来调节对比损失的敏感度;损失函数采用InfoNCE形式;网络结构保持与现有对比学习模型一致,但在批次选择和白化处理上进行了优化。具体的实现细节包括快速贪婪构建器的设计和批内白化的具体算法。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Greedy-64方法在ImageNet-100上将时间缩短了15%,在相同准确率下提升了67.5%的top-1准确率。CIFAR-10实验也显示出类似的性能提升。此外,批内白化技术有效降低了50步梯度方差1.37倍,验证了理论上限的有效性。

🎯 应用场景

该研究的潜在应用领域包括计算机视觉、自然语言处理和其他需要对比学习的任务。通过提升对比学习的效率和稳定性,能够在图像分类、目标检测等任务中实现更快的收敛和更高的准确率,具有重要的实际价值和广泛的应用前景。

📄 摘要(原文)

We derive non-asymptotic spectral bands that bound the squared InfoNCE gradient norm via alignment, temperature, and batch spectrum, recovering the (1/τ^{2}) law and closely tracking batch-mean gradients on synthetic data and ImageNet. Using effective rank (R_{\mathrm{eff}}) as an anisotropy proxy, we design spectrum-aware batch selection, including a fast greedy builder. On ImageNet-100, Greedy-64 cuts time-to-67.5\% top-1 by 15\% vs.\ random (24\% vs.\ Pool--P3) at equal accuracy; CIFAR-10 shows similar gains. In-batch whitening promotes isotropy and reduces 50-step gradient variance by (1.37\times), matching our theoretical upper bound.