KEO: Knowledge Extraction on OMIn via Knowledge Graphs and RAG for Safety-Critical Aviation Maintenance

作者: Kuangshi Ai, Jonathan A. Karr, Meng Jiang, Nitesh V. Chawla, Chaoli Wang

分类: cs.CL, cs.IR

发布日期: 2025-10-07

💡 一句话要点

KEO:面向航空维护,利用知识图谱与RAG进行OMIn知识抽取

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 知识图谱 检索增强生成 大型语言模型 航空维护 知识抽取

📋 核心要点

- 现有文本块RAG方法在处理需要全局理解和系统级推理的复杂航空维护任务时存在局限性。

- KEO框架通过构建知识图谱并集成到RAG流程中,增强了LLM的推理能力,实现更全面的知识抽取。

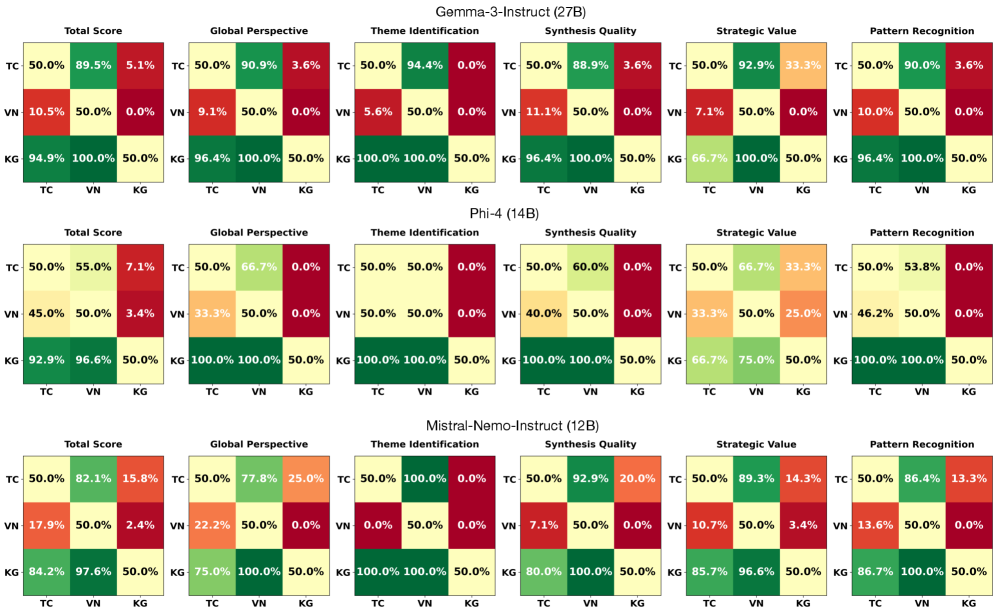

- 实验结果表明,KEO在全局理解方面优于传统文本块RAG,尤其是在揭示模式和系统级见解方面。

📝 摘要(中文)

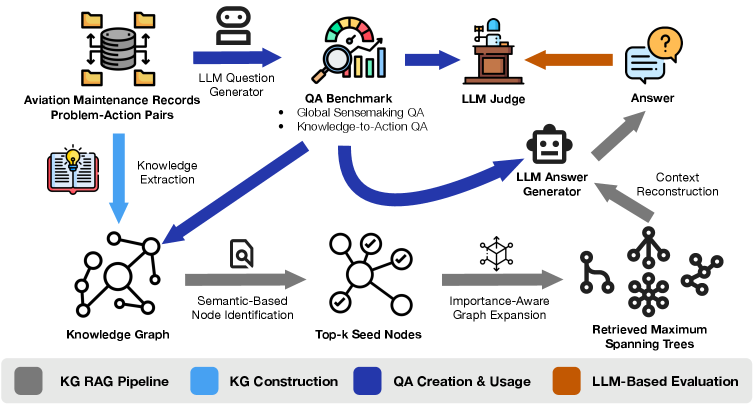

本文提出了一种名为KEO的领域特定知识抽取与推理框架,该框架利用大型语言模型(LLMs)解决安全关键场景下的问题。该框架使用运营与维护情报(OMIn)数据集构建了一个QA基准,涵盖全局理解和可执行的维护任务。KEO构建了一个结构化的知识图谱(KG),并将其集成到检索增强生成(RAG)流程中,从而实现比传统文本块RAG更连贯、数据集范围更广的推理。本文评估了本地部署的LLMs(Gemma-3、Phi-4、Mistral-Nemo),并使用更强大的模型(GPT-4o、Llama-3.3)作为评判者。实验表明,KEO通过揭示模式和系统级见解,显著提高了全局理解能力,而文本块RAG对于需要局部检索的细粒度程序任务仍然有效。这些发现强调了KG增强的LLMs在安全、领域特定的QA中的前景及其在高风险推理中的潜力。

🔬 方法详解

问题定义:论文旨在解决安全关键航空维护领域中,如何利用LLM进行有效的知识抽取和推理的问题。现有方法,特别是传统的文本块RAG,在处理需要全局理解和系统级推理的任务时表现不足,无法充分利用领域知识。

核心思路:论文的核心思路是构建一个结构化的知识图谱(KG),并将其集成到检索增强生成(RAG)流程中。通过知识图谱,LLM可以更好地理解实体之间的关系,从而进行更准确、更全面的推理。

技术框架:KEO框架包含以下主要模块:1) 从OMIn数据集中提取实体和关系,构建知识图谱;2) 将知识图谱集成到RAG流程中,用于增强LLM的检索能力;3) 使用LLM(如Gemma-3、Phi-4、Mistral-Nemo)进行QA任务,并使用更强大的模型(如GPT-4o、Llama-3.3)作为评判者。

关键创新:KEO的关键创新在于将知识图谱与RAG流程相结合,从而增强了LLM在领域特定任务中的推理能力。与传统的文本块RAG相比,KEO能够更好地理解实体之间的关系,从而进行更准确、更全面的推理。

关键设计:论文中没有详细说明具体的参数设置、损失函数或网络结构等技术细节。但是,知识图谱的构建和集成是关键设计,需要仔细考虑实体和关系的提取方法,以及如何将知识图谱的信息有效地传递给LLM。

🖼️ 关键图片

📊 实验亮点

实验结果表明,KEO在全局理解方面显著优于传统的文本块RAG。具体来说,KEO能够更好地揭示模式和系统级见解,从而提高问题解答的准确性和全面性。虽然论文中没有给出具体的性能数据,但强调了KEO在复杂推理任务中的优势。

🎯 应用场景

KEO框架可应用于安全关键领域,如航空维护、医疗诊断等,帮助专业人员进行知识抽取、问题解答和决策支持。通过构建领域知识图谱并结合LLM,可以提高问题解答的准确性和效率,降低人为错误风险,并为复杂系统提供更深入的理解。

📄 摘要(原文)

We present Knowledge Extraction on OMIn (KEO), a domain-specific knowledge extraction and reasoning framework with large language models (LLMs) in safety-critical contexts. Using the Operations and Maintenance Intelligence (OMIn) dataset, we construct a QA benchmark spanning global sensemaking and actionable maintenance tasks. KEO builds a structured Knowledge Graph (KG) and integrates it into a retrieval-augmented generation (RAG) pipeline, enabling more coherent, dataset-wide reasoning than traditional text-chunk RAG. We evaluate locally deployable LLMs (Gemma-3, Phi-4, Mistral-Nemo) and employ stronger models (GPT-4o, Llama-3.3) as judges. Experiments show that KEO markedly improves global sensemaking by revealing patterns and system-level insights, while text-chunk RAG remains effective for fine-grained procedural tasks requiring localized retrieval. These findings underscore the promise of KG-augmented LLMs for secure, domain-specific QA and their potential in high-stakes reasoning.