Reproducibility Study of "XRec: Large Language Models for Explainable Recommendation"

作者: Ranjan Mishra, Julian I. Bibo, Quinten van Engelen, Henk Schaapman

分类: cs.CL, cs.AI

发布日期: 2025-10-06

🔗 代码/项目: GITHUB

💡 一句话要点

复现XRec:基于大语言模型的可解释推荐框架,并探索MoE嵌入的影响

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 可解释推荐 大语言模型 指令微调 协同过滤 混合专家模型

📋 核心要点

- 现有推荐系统缺乏透明度,用户难以理解推荐理由,XRec旨在利用大语言模型生成可解释的推荐。

- XRec采用模型无关的协同指令调优框架,通过指令微调大语言模型,使其能够生成个性化的推荐解释。

- 复现结果表明,XRec能够生成有效的个性化解释,且协同信息能提高稳定性,但并非所有指标都优于基线。

📝 摘要(中文)

本研究复现了Ma et al. (2024) 提出的“XRec:用于可解释推荐的大语言模型”论文中的工作。原始作者提出了XRec,一个模型无关的协同指令调优框架,它使大语言模型(LLMs)能够为用户提供对生成推荐的全面解释。我们的目标是复现原始论文的结果,但使用Llama 3作为LLM进行评估,而不是GPT-3.5-turbo。我们以Ma et al. (2024) 提供的源代码为基础来实现我们的目标。我们的工作通过修改输入嵌入或删除XRec的混合专家模块的输出嵌入来扩展原始论文。根据我们的结果,XRec有效地生成个性化解释,并且通过结合协同信息提高了其稳定性。然而,XRec并非在每个指标上都始终优于所有基线模型。我们的扩展分析进一步强调了混合专家嵌入在塑造解释结构中的重要性,展示了协同信号如何与语言建模相互作用。通过我们的工作,我们提供了一个开源评估实现,增强了研究人员和从业人员的可访问性。我们完整的代码库可以在https://github.com/julianbibo/xrec-reproducibility找到。

🔬 方法详解

问题定义:论文旨在解决推荐系统可解释性不足的问题。现有推荐系统通常是黑盒模型,用户无法理解推荐的原因,降低了信任度和用户体验。XRec希望利用大语言模型生成自然语言解释,提升推荐系统的透明度。

核心思路:核心思路是利用大语言模型强大的语言生成能力,通过指令微调的方式,让模型学习生成与推荐结果相关的解释。通过协同信息,增强模型的个性化推荐能力,从而生成更贴合用户需求的解释。

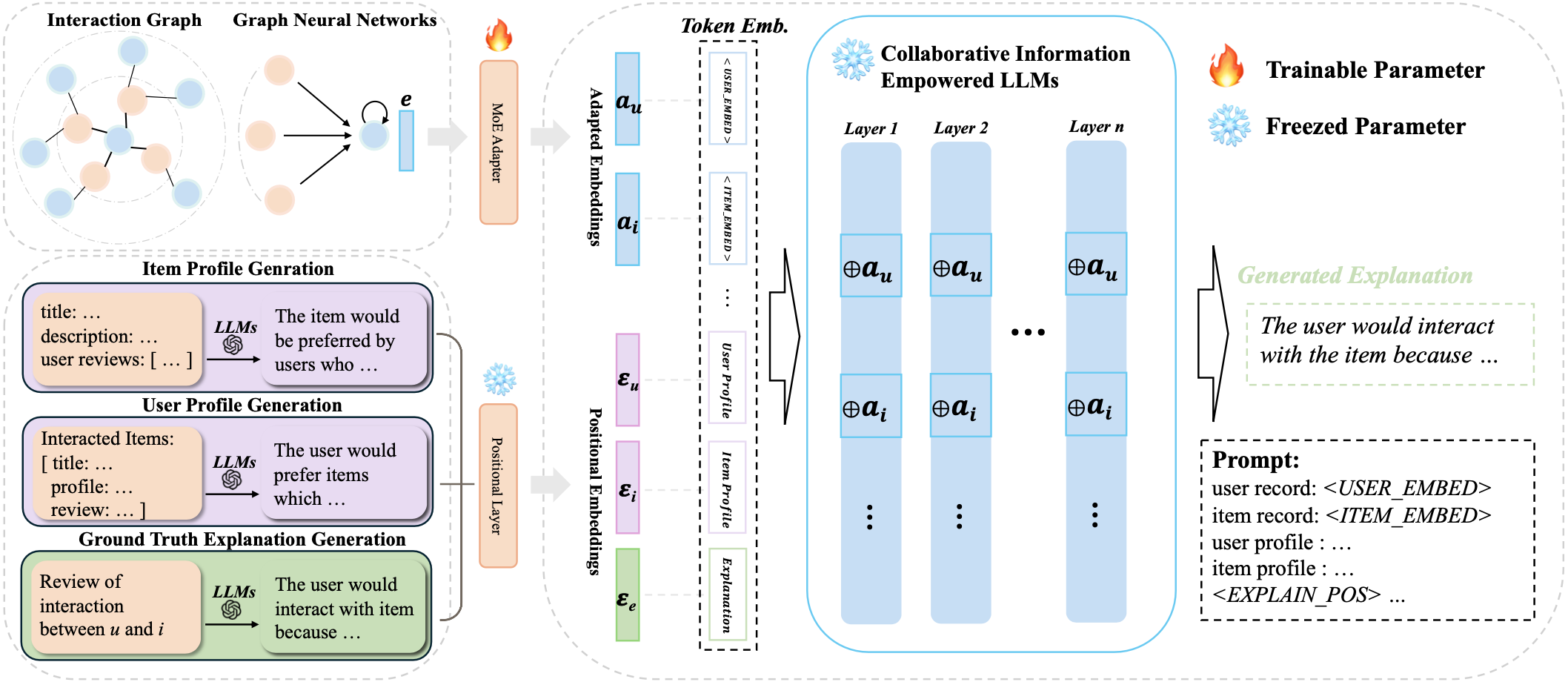

技术框架:XRec的技术框架主要包含以下几个模块:1) 推荐模型:可以是任意推荐算法,负责生成推荐结果;2) 混合专家模块(Mixture of Experts, MoE):用于融合协同信息,生成个性化表示;3) 大语言模型:通过指令微调,学习将推荐结果和用户/物品信息转化为自然语言解释。整体流程是,首先由推荐模型生成推荐结果,然后通过MoE模块融合协同信息,最后将推荐结果和融合后的信息输入到大语言模型中,生成最终的推荐解释。

关键创新:XRec的关键创新在于提出了一个模型无关的协同指令调优框架。它不依赖于特定的推荐算法,可以与各种推荐模型结合使用。同时,通过指令微调的方式,充分利用了大语言模型的语言生成能力,实现了可解释推荐。

关键设计:在MoE模块中,论文探索了不同的嵌入方式,包括修改输入嵌入和删除输出嵌入。指令微调过程中,使用了特定的指令模板,引导大语言模型生成高质量的解释。损失函数的设计目标是最大化生成解释的流畅性和准确性,同时考虑与推荐结果的相关性。

🖼️ 关键图片

📊 实验亮点

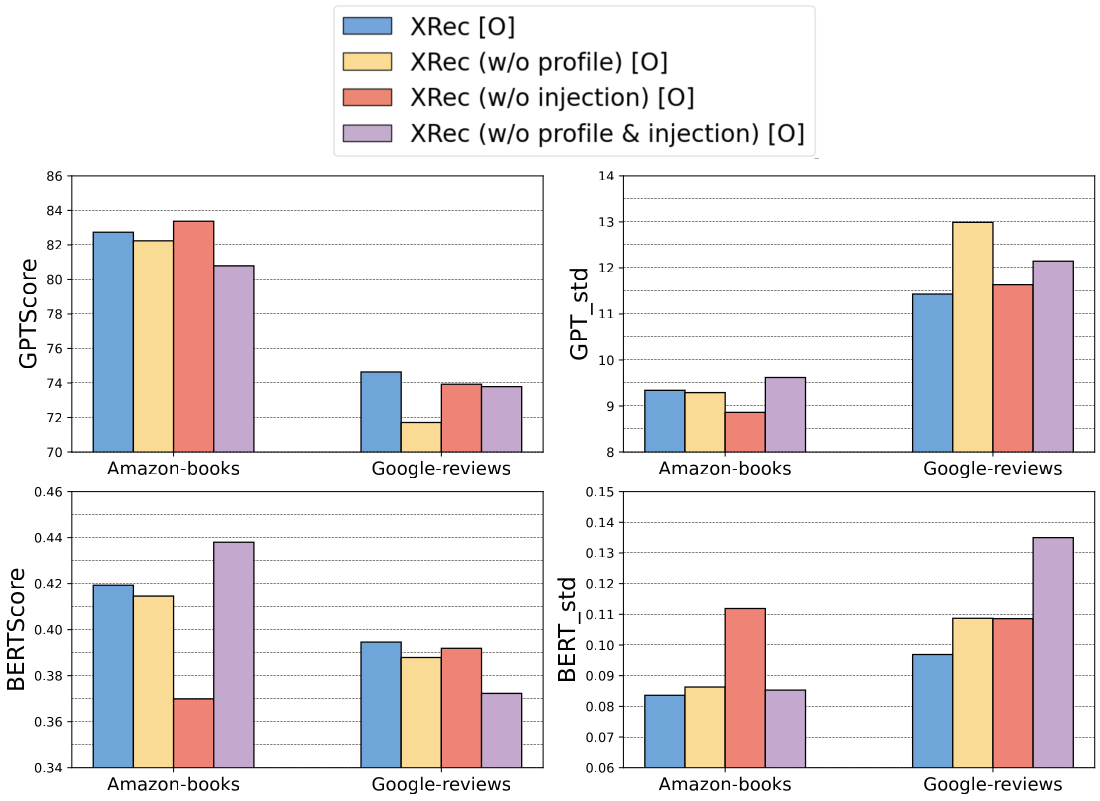

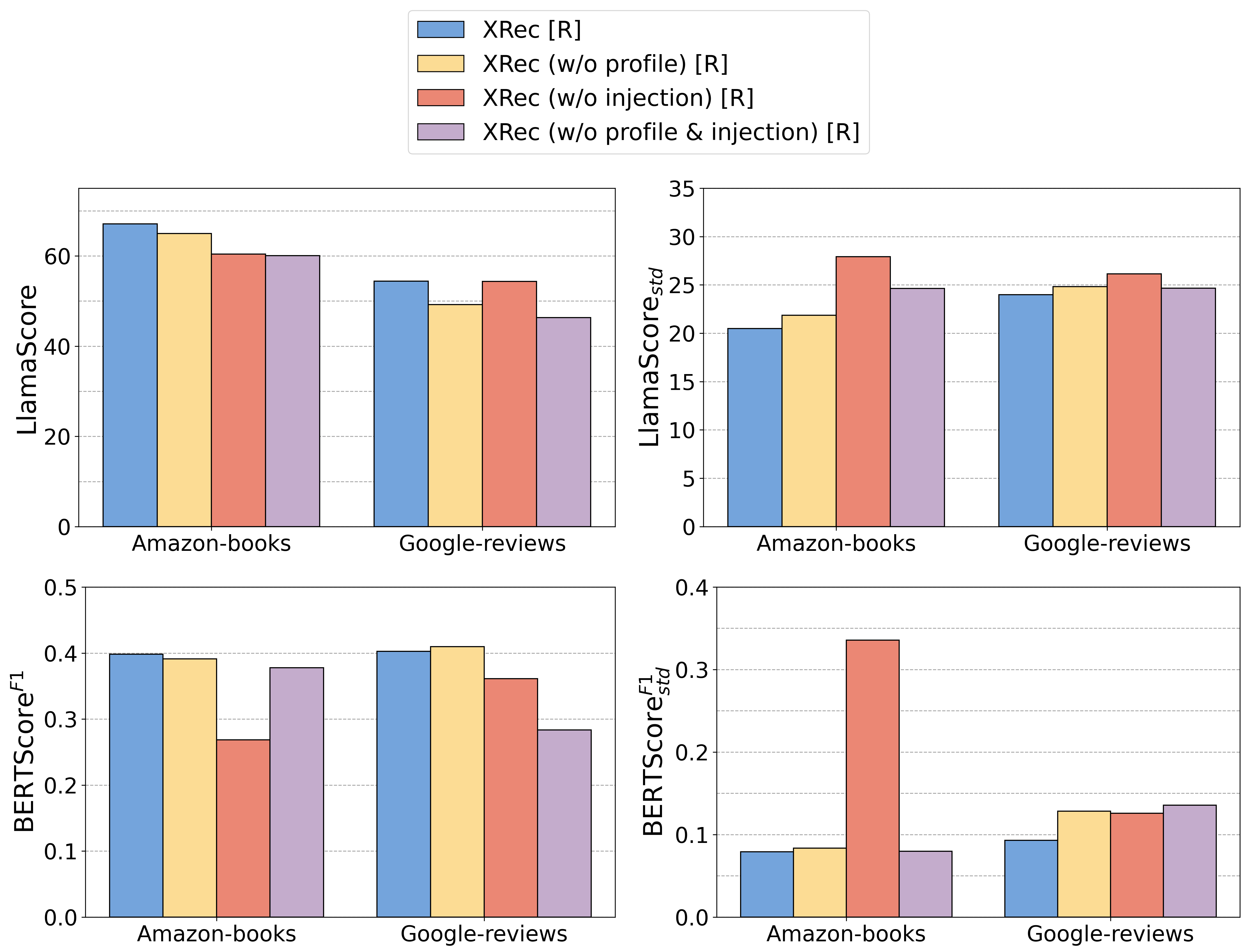

复现实验表明,XRec能够生成个性化的推荐解释,并且通过结合协同信息提高了其稳定性。通过修改或删除MoE模块的嵌入,可以影响解释的结构,表明协同信号与语言建模之间存在相互作用。虽然XRec在某些指标上表现出色,但并非在所有指标上都始终优于所有基线模型,这表明可解释推荐仍有提升空间。

🎯 应用场景

XRec可应用于各种推荐场景,例如电商、新闻推荐、视频推荐等。通过提供可解释的推荐,可以提高用户对推荐系统的信任度,提升用户体验,并帮助用户更好地理解自己的兴趣偏好。未来,可以进一步探索如何利用XRec进行更深层次的用户画像分析和个性化推荐。

📄 摘要(原文)

In this study, we reproduced the work done in the paper "XRec: Large Language Models for Explainable Recommendation" by Ma et al. (2024). The original authors introduced XRec, a model-agnostic collaborative instruction-tuning framework that enables large language models (LLMs) to provide users with comprehensive explanations of generated recommendations. Our objective was to replicate the results of the original paper, albeit using Llama 3 as the LLM for evaluation instead of GPT-3.5-turbo. We built on the source code provided by Ma et al. (2024) to achieve our goal. Our work extends the original paper by modifying the input embeddings or deleting the output embeddings of XRec's Mixture of Experts module. Based on our results, XRec effectively generates personalized explanations and its stability is improved by incorporating collaborative information. However, XRec did not consistently outperform all baseline models in every metric. Our extended analysis further highlights the importance of the Mixture of Experts embeddings in shaping the explanation structures, showcasing how collaborative signals interact with language modeling. Through our work, we provide an open-source evaluation implementation that enhances accessibility for researchers and practitioners alike. Our complete code repository can be found at https://github.com/julianbibo/xrec-reproducibility.