Guided Query Refinement: Multimodal Hybrid Retrieval with Test-Time Optimization

作者: Omri Uzan, Asaf Yehudai, Roi pony, Eyal Shnarch, Ariel Gera

分类: cs.CL

发布日期: 2025-10-06 (更新: 2025-12-05)

🔗 代码/项目: GITHUB

💡 一句话要点

提出引导式查询优化(GQR),提升视觉文档检索效率与性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉文档检索 多模态检索 查询优化 混合检索 测试时优化

📋 核心要点

- 现有视觉文档检索模型参数量巨大,部署和扩展性受限,且视觉中心方法存在模态鸿沟。

- 提出引导式查询优化(GQR),利用轻量级文本检索器的分数引导视觉检索器的查询嵌入优化。

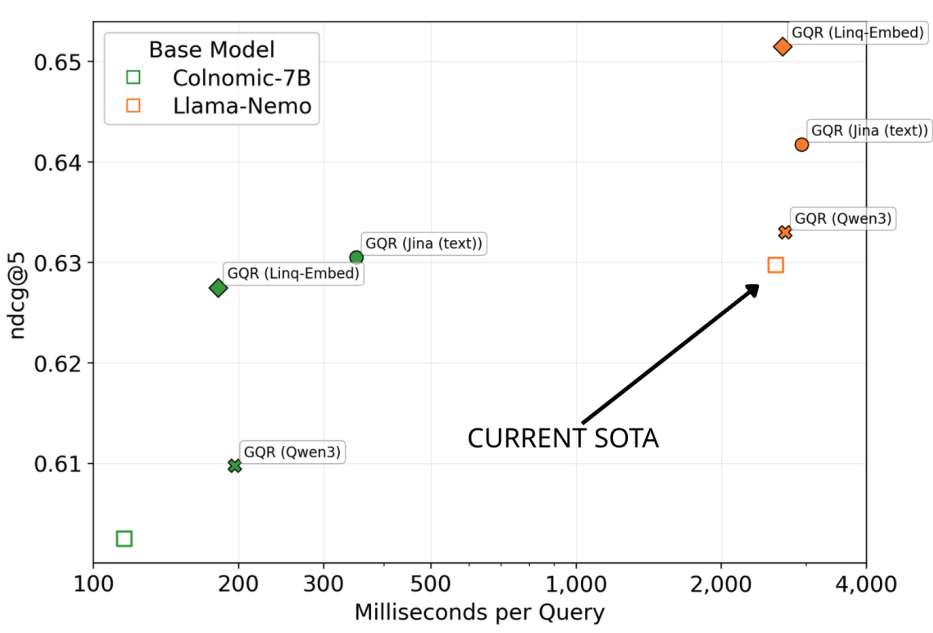

- 实验表明,GQR使视觉模型在显著降低计算成本的同时,达到与更大模型相当的性能。

📝 摘要(中文)

多模态编码器推动了视觉文档检索的边界,通过将文本查询tokens直接匹配到图像patches,在公共基准测试中实现了最先进的性能。然而,依赖于这种范式的最新模型大规模地扩展了查询和文档表示的尺寸,给实际部署和可扩展性带来了障碍。此外,纯粹以视觉为中心的方法可能受到现代视觉-语言模型仍然存在的固有模态差距的限制。本文将这些挑战与混合检索范式联系起来,研究轻量级密集文本检索器是否可以增强更强大的以视觉为中心的模型。现有的混合方法依赖于粗粒度的排名或分数融合,无法利用每个模型表示空间内的丰富交互。为了解决这个问题,我们引入了引导式查询优化(GQR),这是一种新颖的测试时优化方法,它利用来自互补检索器的分数来优化主检索器的查询嵌入。通过在视觉文档检索基准上的大量实验,我们证明了GQR允许以视觉为中心的模型匹配具有显著更大表示的模型性能,同时速度提高了14倍,内存需求减少了54倍。我们的研究结果表明,GQR有效地推动了多模态检索中性能和效率的帕累托前沿。我们在https://github.com/IBM/test-time-hybrid-retrieval发布了我们的代码。

🔬 方法详解

问题定义:论文旨在解决视觉文档检索中,现有模型参数量大、计算成本高,以及纯视觉模型存在模态鸿沟的问题。现有方法通常采用粗粒度的融合方式,无法充分利用不同模态信息之间的交互。

核心思路:论文的核心思路是利用一个轻量级的文本检索器来引导一个更强大的视觉检索器的查询嵌入优化。通过这种方式,可以弥补视觉模型的模态鸿沟,并降低整体的计算成本。

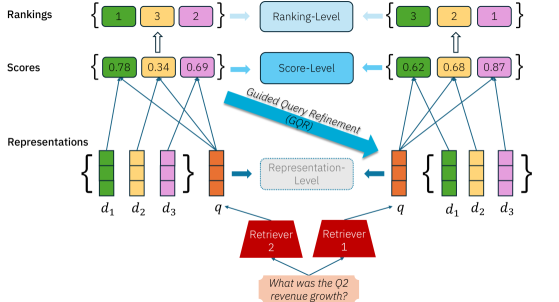

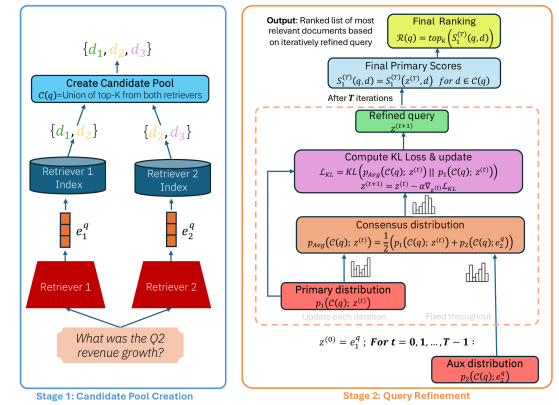

技术框架:GQR方法包含两个主要的检索器:一个是以视觉为中心的检索器(primary retriever),另一个是轻量级的文本检索器(complementary retriever)。在测试时,首先使用两个检索器分别对查询进行检索,然后利用文本检索器的分数来指导视觉检索器的查询嵌入优化。优化后的查询嵌入用于重新检索,得到最终的结果。

关键创新:GQR的关键创新在于测试时优化策略,它不是简单地融合两个检索器的结果,而是利用一个检索器的信息来指导另一个检索器的查询嵌入优化。这种方法能够更充分地利用不同模态的信息,并提高检索的准确性。

关键设计:GQR的关键设计包括:1) 如何选择合适的文本检索器作为引导;2) 如何设计优化目标,使得优化后的查询嵌入能够更好地匹配视觉信息;3) 如何平衡两个检索器的贡献,避免过度依赖文本信息。具体的优化目标和参数设置在论文中进行了详细描述,但具体细节未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,GQR方法能够使视觉中心模型在性能上匹配甚至超过参数量更大的模型,同时速度提升高达14倍,内存需求降低54倍。这表明GQR能够有效地推动多模态检索在性能和效率上的帕累托前沿。

🎯 应用场景

该研究成果可应用于各种视觉文档检索场景,例如图像搜索、文档理解、信息检索等。通过降低模型大小和计算成本,GQR方法可以更容易地部署到实际应用中,并提高检索效率。此外,该方法还可以扩展到其他多模态检索任务中,具有广泛的应用前景。

📄 摘要(原文)

Multimodal encoders have pushed the boundaries of visual document retrieval, matching textual query tokens directly to image patches and achieving state-of-the-art performance on public benchmarks. Recent models relying on this paradigm have massively scaled the sizes of their query and document representations, presenting obstacles to deployment and scalability in real-world pipelines. Furthermore, purely vision-centric approaches may be constrained by the inherent modality gap still exhibited by modern vision-language models. In this work, we connect these challenges to the paradigm of hybrid retrieval, investigating whether a lightweight dense text retriever can enhance a stronger vision-centric model. Existing hybrid methods, which rely on coarse-grained fusion of ranks or scores, fail to exploit the rich interactions within each model's representation space. To address this, we introduce Guided Query Refinement (GQR), a novel test-time optimization method that refines a primary retriever's query embedding using guidance from a complementary retriever's scores. Through extensive experiments on visual document retrieval benchmarks, we demonstrate that GQR allows vision-centric models to match the performance of models with significantly larger representations, while being up to 14x faster and requiring 54x less memory. Our findings show that GQR effectively pushes the Pareto frontier for performance and efficiency in multimodal retrieval. We release our code at https://github.com/IBM/test-time-hybrid-retrieval