When Models Lie, We Learn: Multilingual Span-Level Hallucination Detection with PsiloQA

作者: Elisei Rykov, Kseniia Petrushina, Maksim Savkin, Valerii Olisov, Artem Vazhentsev, Kseniia Titova, Alexander Panchenko, Vasily Konovalov, Julia Belikova

分类: cs.CL

发布日期: 2025-10-06

💡 一句话要点

提出PsiloQA,一个多语言跨度级幻觉检测数据集,并评估多种检测方法。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 幻觉检测 大型语言模型 多语言 跨度级别标注 自动化数据生成

📋 核心要点

- 现有幻觉检测基准测试缺乏细粒度的多语言支持,限制了对LLM幻觉问题的全面评估。

- PsiloQA数据集通过自动化流程,利用GPT-4o生成问答对并标注跨度级别的幻觉,支持14种语言。

- 实验表明,基于编码器的模型在PsiloQA上表现最佳,并能有效进行跨语言泛化和知识迁移。

📝 摘要(中文)

幻觉检测对于大型语言模型(LLMs)的安全可靠部署至关重要,尤其是在需要事实准确性的应用中。现有的幻觉基准测试通常在序列级别操作,并且仅限于英语,缺乏细粒度的多语言监督,无法进行全面的评估。本文提出了PsiloQA,这是一个大规模的多语言数据集,标注了14种语言的跨度级幻觉。PsiloQA通过一个自动化的三阶段流程构建:使用GPT-4o从维基百科生成问答对,在无上下文设置中从不同的LLM中引出潜在的幻觉答案,并使用GPT-4o通过与黄金答案和检索到的上下文进行比较来自动标注幻觉跨度。我们评估了各种幻觉检测方法,包括不确定性量化、基于LLM的标记和微调的编码器模型,并表明基于编码器的模型在各种语言中都取得了最佳性能。此外,PsiloQA展示了有效的跨语言泛化,并支持对其他基准的稳健知识转移,同时比人工标注的数据集更具成本效益。我们的数据集和结果促进了多语言环境中可扩展的细粒度幻觉检测的发展。

🔬 方法详解

问题定义:论文旨在解决大型语言模型在多语言环境下产生幻觉的问题,特别是在跨度级别上的幻觉检测。现有的幻觉检测方法主要集中在英语环境,缺乏对其他语言的支持,并且通常在序列级别进行判断,无法精确定位幻觉的具体位置。这使得模型难以进行针对性的改进,也限制了其在多语言环境下的应用。

核心思路:论文的核心思路是构建一个大规模、多语言、跨度级别的幻觉检测数据集PsiloQA,并利用该数据集评估和提升现有幻觉检测方法。通过自动化流程生成数据,降低了标注成本,并保证了数据集的多样性和规模。同时,在跨度级别上进行标注,可以更精确地定位幻觉,为模型提供更有效的监督信号。

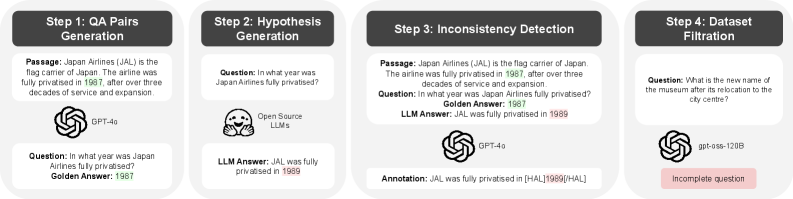

技术框架:PsiloQA的构建流程包含三个主要阶段: 1. 问答对生成:使用GPT-4o从维基百科中生成问答对,作为幻觉检测的基础。 2. 幻觉答案引出:在无上下文设置下,从不同的LLM中引出可能包含幻觉的答案。 3. 幻觉跨度标注:使用GPT-4o将生成的答案与黄金答案和检索到的上下文进行比较,自动标注幻觉跨度。

关键创新:PsiloQA的关键创新在于其自动化、多语言和跨度级别的标注方式。与传统的人工标注数据集相比,PsiloQA的构建成本更低,规模更大,并且支持多种语言。跨度级别的标注可以更精确地定位幻觉,为模型提供更有效的监督信号。此外,论文还评估了多种幻觉检测方法,并发现基于编码器的模型在PsiloQA上表现最佳。

关键设计:在幻觉跨度标注阶段,论文使用了GPT-4o进行自动标注。具体来说,GPT-4o被要求判断生成的答案中的每个跨度是否与黄金答案和检索到的上下文一致。为了提高标注的准确性,论文还采用了多种策略,例如使用不同的提示语、对GPT-4o的输出进行过滤等。在实验中,论文评估了多种幻觉检测方法,包括不确定性量化、基于LLM的标记和微调的编码器模型。对于编码器模型,论文使用了常见的预训练模型,例如BERT和RoBERTa,并针对幻觉检测任务进行了微调。

🖼️ 关键图片

📊 实验亮点

实验结果表明,基于编码器的模型在PsiloQA数据集上取得了最佳的幻觉检测性能,并且能够有效进行跨语言泛化。此外,PsiloQA数据集支持对其他基准的稳健知识转移,并且比人工标注的数据集更具成本效益。这些结果表明,PsiloQA是一个有价值的资源,可以促进多语言环境中可扩展的细粒度幻觉检测的发展。

🎯 应用场景

该研究成果可广泛应用于各种需要事实准确性的自然语言处理任务中,例如问答系统、信息检索、机器翻译和文本摘要。通过提高LLM的幻觉检测能力,可以显著提升这些应用的可靠性和安全性。此外,PsiloQA数据集可以作为评估和改进LLM幻觉检测能力的基准,促进相关领域的研究进展。

📄 摘要(原文)

Hallucination detection remains a fundamental challenge for the safe and reliable deployment of large language models (LLMs), especially in applications requiring factual accuracy. Existing hallucination benchmarks often operate at the sequence level and are limited to English, lacking the fine-grained, multilingual supervision needed for a comprehensive evaluation. In this work, we introduce PsiloQA, a large-scale, multilingual dataset annotated with span-level hallucinations across 14 languages. PsiloQA is constructed through an automated three-stage pipeline: generating question-answer pairs from Wikipedia using GPT-4o, eliciting potentially hallucinated answers from diverse LLMs in a no-context setting, and automatically annotating hallucinated spans using GPT-4o by comparing against golden answers and retrieved context. We evaluate a wide range of hallucination detection methods -- including uncertainty quantification, LLM-based tagging, and fine-tuned encoder models -- and show that encoder-based models achieve the strongest performance across languages. Furthermore, PsiloQA demonstrates effective cross-lingual generalization and supports robust knowledge transfer to other benchmarks, all while being significantly more cost-efficient than human-annotated datasets. Our dataset and results advance the development of scalable, fine-grained hallucination detection in multilingual settings.