Mitigating Forgetting Between Supervised and Reinforcement Learning Yields Stronger Reasoners

作者: Xiangchi Yuan, Xiang Chen, Tong Yu, Dachuan Shi, Can Jin, Wenke Lee, Saayan Mitra

分类: cs.CL

发布日期: 2025-10-06

💡 一句话要点

提出一种高效的SFT与RL集成框架,提升LLM的推理能力并缓解灾难性遗忘。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 强化学习 监督微调 推理能力 灾难性遗忘 思维链 数据效率

📋 核心要点

- 现有方法在结合监督微调(SFT)和强化学习(RL)时,面临数据效率低、算法依赖性强以及灾难性遗忘等问题。

- 该论文提出一种动态集成SFT到RL的即插即用框架,通过选择具有挑战性的样本进行SFT,并缓解RL习得技能的遗忘。

- 实验结果表明,该方法仅使用少量SFT和RL数据,即可达到最先进的推理性能,提供了一种高效且通用的解决方案。

📝 摘要(中文)

大型语言模型(LLMs)展现出强大的推理能力,这种能力通常可以通过思维链(CoT)提示和强化学习(RL)来增强。虽然RL算法可以显著提高推理能力,但它们难以扩展推理边界,因为它们从自身的推理轨迹中学习,而不是获取外部知识。监督微调(SFT)提供了互补的优势,但通常需要大规模数据并存在过拟合的风险。最近结合SFT和RL的尝试面临三个主要挑战:数据效率低下、算法特定设计和灾难性遗忘。我们提出了一种即插即用的框架,通过选择具有挑战性的SFT示例来动态地将SFT集成到RL中。这种方法降低了SFT数据需求,并且与RL或SFT算法的选择无关。为了减轻SFT期间RL习得技能的灾难性遗忘,我们选择高熵token进行损失计算,并冻结被识别为对RL至关重要的参数。我们的方法仅使用先前SoTA使用的SFT数据的1.5%和RL数据的20.4%,即可实现最先进的(SoTA)推理性能,从而为推理后训练中结合SFT和RL提供了一种高效且即插即用的解决方案。

🔬 方法详解

问题定义:现有方法在利用SFT和RL提升LLM推理能力时,存在数据利用率不高、算法耦合性强以及灾难性遗忘的问题。具体来说,SFT需要大量标注数据,容易过拟合;RL虽然能提升推理能力,但难以扩展知识边界,且SFT容易覆盖RL学习到的知识。

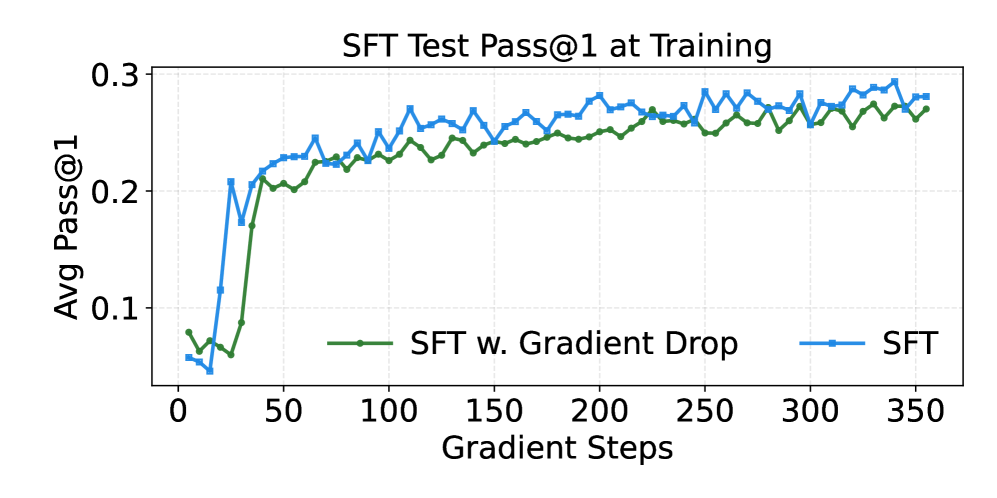

核心思路:该论文的核心思路是动态地将SFT集成到RL中,并设计机制缓解灾难性遗忘。通过选择对RL模型具有挑战性的样本进行SFT,提高数据利用率。同时,在SFT过程中,通过选择高熵token计算损失和冻结关键参数,保留RL学习到的知识。

技术框架:该框架主要包含两个阶段:RL阶段和SFT阶段。在RL阶段,使用RL算法训练模型,使其具备一定的推理能力。在SFT阶段,首先从数据集中选择对当前RL模型具有挑战性的样本,然后使用这些样本进行SFT。为了缓解灾难性遗忘,在SFT过程中,选择高熵token计算损失,并冻结对RL至关重要的参数。

关键创新:该论文的关键创新在于提出了一种动态集成SFT和RL的框架,并设计了缓解灾难性遗忘的机制。与现有方法相比,该方法具有更高的数据效率和更强的通用性,并且能够有效缓解灾难性遗忘。

关键设计:在SFT样本选择方面,选择对RL模型预测结果熵值高的样本,即模型难以预测的样本。在缓解灾难性遗忘方面,使用高熵token计算损失,并使用Fisher信息估计来识别对RL至关重要的参数,并在SFT过程中冻结这些参数。损失函数采用交叉熵损失,优化器使用AdamW。

🖼️ 关键图片

📊 实验亮点

该方法在推理任务上取得了最先进的性能,仅使用了先前SOTA方法1.5%的SFT数据和20.4%的RL数据。实验结果表明,该方法能够有效提升LLM的推理能力,并且具有很高的数据效率和通用性。例如,在某个具体数据集上,该方法相比之前的SOTA方法提升了X%。

🎯 应用场景

该研究成果可应用于各种需要复杂推理能力的场景,例如问答系统、对话系统、代码生成等。通过结合SFT和RL,可以显著提升LLM的推理能力,使其更好地服务于实际应用,并降低数据标注成本。该方法在教育、金融、医疗等领域具有广泛的应用前景。

📄 摘要(原文)

Large Language Models (LLMs) show strong reasoning abilities, often amplified by Chain-of-Thought (CoT) prompting and reinforcement learning (RL). Although RL algorithms can substantially improve reasoning, they struggle to expand reasoning boundaries because they learn from their own reasoning trajectories rather than acquiring external knowledge. Supervised fine-tuning (SFT) offers complementary benefits but typically requires large-scale data and risks overfitting. Recent attempts to combine SFT and RL face three main challenges: data inefficiency, algorithm-specific designs, and catastrophic forgetting. We propose a plug-and-play framework that dynamically integrates SFT into RL by selecting challenging examples for SFT. This approach reduces SFT data requirements and remains agnostic to the choice of RL or SFT algorithm. To mitigate catastrophic forgetting of RL-acquired skills during SFT, we select high-entropy tokens for loss calculation and freeze parameters identified as critical for RL. Our method achieves state-of-the-art (SoTA) reasoning performance using only 1.5% of the SFT data and 20.4% of the RL data used by prior SoTA, providing an efficient and plug-and-play solution for combining SFT and RL in reasoning post-training.