Scaling Code-Assisted Chain-of-Thoughts and Instructions for Model Reasoning

作者: Honglin Lin, Qizhi Pei, Xin Gao, Zhuoshi Pan, Yu Li, Juntao Li, Conghui He, Lijun Wu

分类: cs.CL, cs.PL

发布日期: 2025-10-05

备注: Accepted by NeurIPS2025

💡 一句话要点

提出Caco框架,通过代码驱动自动生成高质量、可验证、多样化的指令-CoT推理数据,提升模型推理能力。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 思维链 代码辅助 推理数据生成 自动化验证 大型语言模型

📋 核心要点

- 现有CoT方法存在生成不可控、质量不足、推理路径单一等问题,限制了LLM在复杂任务中的推理能力。

- Caco框架通过代码驱动,自动生成高质量、可验证、多样化的指令-CoT推理数据,提升模型推理能力和泛化性。

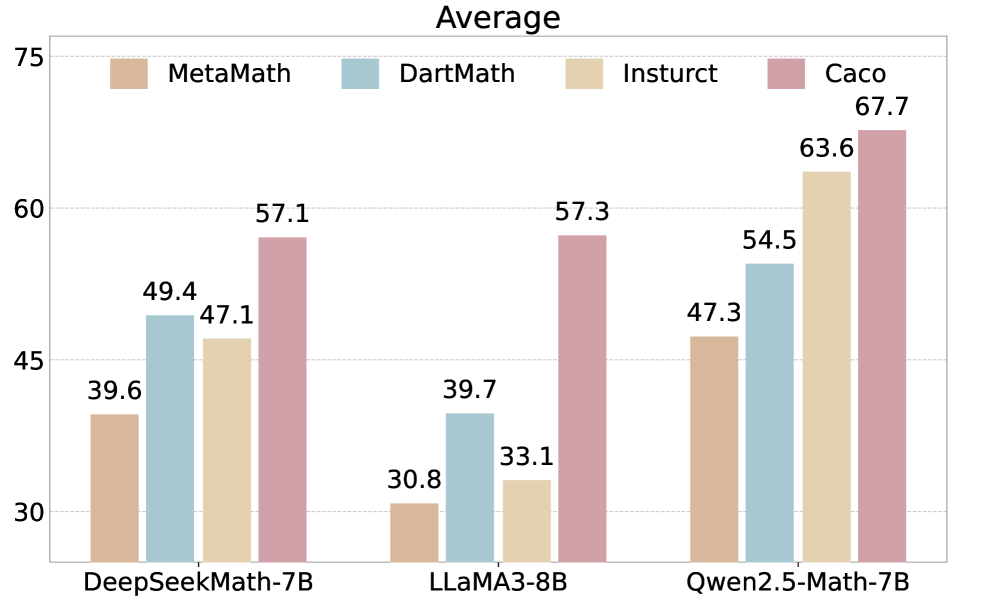

- 在Caco-1.3M数据集上,Caco训练的模型在数学推理基准测试中表现出色,超越了现有基线模型。

📝 摘要(中文)

大型语言模型(LLMs)的推理能力对于解决复杂任务至关重要,但实现可靠且可扩展的推理仍然具有挑战性。思维链(CoT)提示已成为主流方法,但现有方法通常存在生成不可控、质量不足和推理路径多样性有限等问题。最近的研究利用代码来增强CoT,通过将推理建立在可执行步骤之上,但这些方法通常仅限于预定义的数学问题,限制了可扩展性和通用性。本文提出了Caco(代码辅助思维链),这是一个新颖的框架,通过代码驱动的增强自动合成高质量、可验证和多样化的指令-CoT推理数据。与之前的工作不同,Caco首先在统一的代码格式下,在现有的数学和编程解决方案上微调一个基于代码的CoT生成器,然后将数据生成扩展到大量的多样化推理轨迹。至关重要的是,我们引入了通过代码执行和基于规则的过滤进行自动验证,以确保逻辑正确性和结构多样性,然后将过滤后的输出逆向工程为自然语言指令和语言CoT,以丰富任务适应性。这个闭环过程实现了完全自动化、可扩展的推理数据合成,并保证了可执行性。在我们创建的Caco-1.3M数据集上的实验表明,Caco训练的模型在数学推理基准测试中取得了强大的竞争性能,优于现有的强大基线。进一步的分析表明,Caco的代码锚定验证和指令多样性有助于在未见过的任务中实现卓越的泛化。我们的工作为构建无需人工干预的自我维持、值得信赖的推理系统建立了一个范例。

🔬 方法详解

问题定义:论文旨在解决大型语言模型在复杂推理任务中,由于现有思维链(CoT)方法生成质量不高、多样性不足以及可扩展性差的问题。现有方法依赖人工设计的提示或有限的数学问题,难以保证推理的正确性和泛化能力。

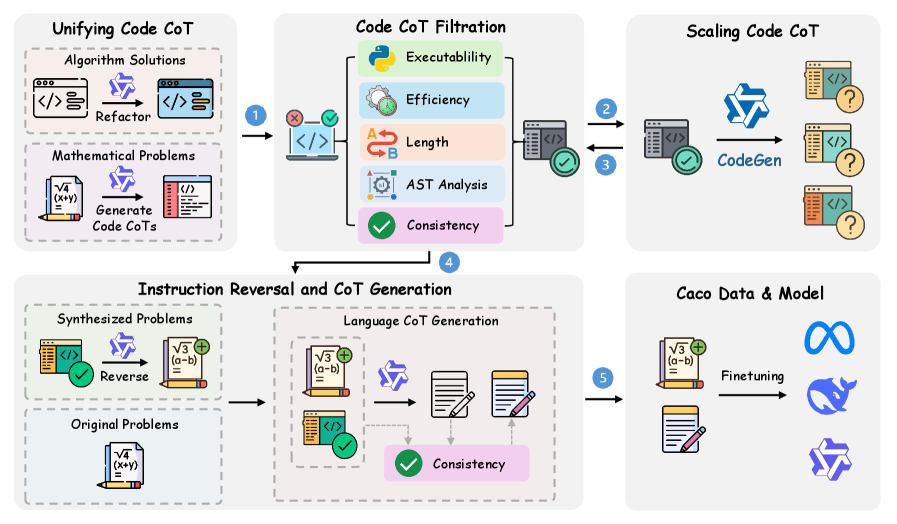

核心思路:论文的核心思路是利用代码的可执行性和验证性来辅助生成高质量的CoT推理数据。通过将推理过程表示为可执行的代码,可以自动验证推理的正确性,并利用代码生成的多样性来丰富推理路径。同时,将代码形式的推理过程逆向工程为自然语言指令和CoT,从而提高模型在不同任务上的适应性。

技术框架:Caco框架包含以下主要阶段:1) 基于代码的CoT生成器微调:在现有的数学和编程解决方案上,微调一个能够生成代码形式CoT的生成器。2) 数据生成与验证:利用微调后的生成器生成大量的代码形式CoT,并通过代码执行和规则过滤自动验证其正确性和多样性。3) 逆向工程:将验证后的代码形式CoT逆向工程为自然语言指令和CoT。4) 模型训练:使用生成的指令-CoT数据训练LLM。

关键创新:Caco的关键创新在于利用代码的可执行性来自动验证和过滤CoT推理数据,从而保证了数据的质量和正确性。此外,Caco还通过代码生成的多样性来丰富推理路径,并将其逆向工程为自然语言指令,从而提高了模型的泛化能力。与现有方法相比,Caco实现了完全自动化、可扩展的推理数据合成,无需人工干预。

关键设计:Caco的关键设计包括:1) 使用统一的代码格式表示数学和编程问题,方便模型学习。2) 设计基于代码执行和规则的自动验证机制,确保推理的正确性和多样性。3) 使用逆向工程技术将代码形式的CoT转换为自然语言指令和CoT,提高模型在不同任务上的适应性。具体的参数设置、损失函数和网络结构等细节未在摘要中详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用Caco-1.3M数据集训练的模型在数学推理基准测试中取得了显著的性能提升,超越了现有的强大基线模型。这表明Caco框架生成的推理数据具有高质量和多样性,能够有效提升模型的推理能力和泛化性。具体的性能数据和提升幅度未在摘要中详细说明,属于未知信息。

🎯 应用场景

Caco框架可应用于各种需要复杂推理能力的领域,如数学问题求解、代码生成、逻辑推理等。该研究的实际价值在于提供了一种自动生成高质量推理数据的有效方法,降低了人工标注的成本,并提高了模型的推理能力和泛化性。未来,Caco有望应用于构建更加智能、可靠的AI系统。

📄 摘要(原文)

Reasoning capability is pivotal for Large Language Models (LLMs) to solve complex tasks, yet achieving reliable and scalable reasoning remains challenging. While Chain-of-Thought (CoT) prompting has become a mainstream approach, existing methods often suffer from uncontrolled generation, insufficient quality, and limited diversity in reasoning paths. Recent efforts leverage code to enhance CoT by grounding reasoning in executable steps, but such methods are typically constrained to predefined mathematical problems, hindering scalability and generalizability. In this work, we propose Caco (Code-Assisted Chain-of-ThOught), a novel framework that automates the synthesis of high-quality, verifiable, and diverse instruction-CoT reasoning data through code-driven augmentation. Unlike prior work, Caco first fine-tunes a code-based CoT generator on existing math and programming solutions in a unified code format, then scales the data generation to a large amount of diverse reasoning traces. Crucially, we introduce automated validation via code execution and rule-based filtering to ensure logical correctness and structural diversity, followed by reverse-engineering filtered outputs into natural language instructions and language CoTs to enrich task adaptability. This closed-loop process enables fully automated, scalable synthesis of reasoning data with guaranteed executability. Experiments on our created Caco-1.3M dataset demonstrate that Caco-trained models achieve strong competitive performance on mathematical reasoning benchmarks, outperforming existing strong baselines. Further analysis reveals that Caco's code-anchored verification and instruction diversity contribute to superior generalization across unseen tasks. Our work establishes a paradigm for building self-sustaining, trustworthy reasoning systems without human intervention.