PoLi-RL: A Point-to-List Reinforcement Learning Framework for Conditional Semantic Textual Similarity

作者: Zixin Song, Bowen Zhang, Qian-Wen Zhang, Di Yin, Xing Sun, Chunping Li

分类: cs.CL

发布日期: 2025-10-05

💡 一句话要点

提出PoLi-RL框架,解决条件语义文本相似度任务中强化学习训练难题。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 条件语义文本相似度 强化学习 大型语言模型 排序学习 课程学习

📋 核心要点

- 现有C-STS方法主要依赖判别模型,未能充分利用大型语言模型和强化学习的最新进展,尤其是在优化排序指标方面。

- PoLi-RL框架采用点到列表的强化学习策略,通过两阶段课程学习和混合奖励机制,提升模型辨别细微语义差异的能力。

- PoLi-RL在C-STS基准测试中取得了显著成果,Spearman相关系数达到48.18,为交叉编码器架构设立了新的SOTA。

📝 摘要(中文)

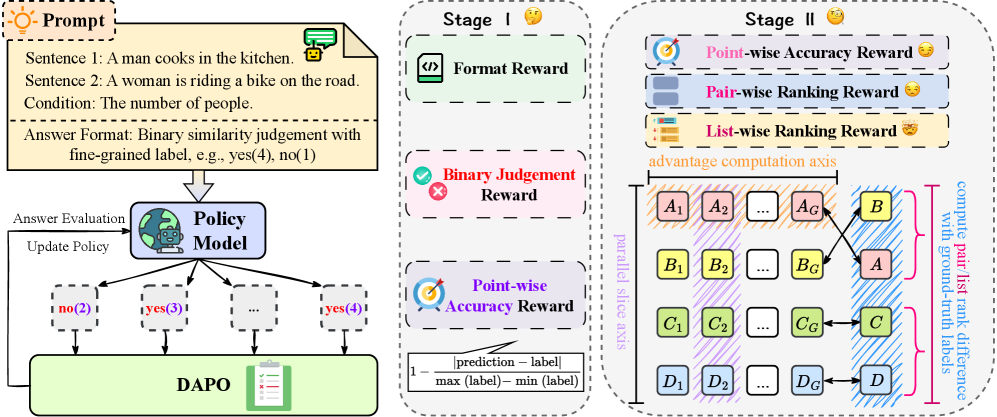

条件语义文本相似度(C-STS)衡量特定条件下文本片段之间的语义接近程度,克服了传统STS的模糊性。现有方法主要局限于判别模型,未能充分整合NLP领域中大型语言模型(LLM)和强化学习(RL)的最新突破。RL非常适合此任务,因为它可以直接优化不可微的Spearman排序指标并指导C-STS所需的推理过程。然而,直接应用列表式RL无法产生有意义的改进,因为模型会被复杂、粗粒度的奖励信号淹没。为了解决这个问题,我们引入了PoLi-RL,一种新颖的点到列表强化学习框架。PoLi-RL采用两阶段课程:首先使用简单的点式奖励训练模型以建立基本评分能力,然后过渡到混合奖励,结合点式、配对式和列表式目标,以提高模型辨别细微语义差异的能力。我们提出了一种创新的并行切片排序奖励(PSRR)机制,该机制在并行切片中计算排序奖励,每个切片包含来自不同样本的相同索引的补全。这为每个单独的补全提供了精确的、差异化的学习信号,从而实现了细粒度的信用分配和有效的优化。在官方C-STS基准测试中,PoLi-RL实现了48.18的Spearman相关系数,为交叉编码器架构建立了新的SOTA。作为第一个成功将RL应用于C-STS的工作,我们的研究为在复杂的、基于排序的条件判断任务上训练LLM引入了一种强大而精确的范例。

🔬 方法详解

问题定义:论文旨在解决条件语义文本相似度(C-STS)任务,即在给定条件的情况下,衡量两个文本片段的语义相似度。现有方法,特别是判别模型,无法有效利用大型语言模型和强化学习的优势,难以直接优化不可微的排序指标,且在复杂奖励信号下训练困难。

核心思路:论文的核心思路是利用强化学习直接优化C-STS任务中的排序指标。为了解决传统列表式强化学习在复杂奖励信号下的训练难题,提出了PoLi-RL框架,采用点到列表的学习方式,逐步提升模型的能力。

技术框架:PoLi-RL框架包含两个主要阶段:第一阶段是使用点式奖励进行预训练,使模型具备基本的评分能力;第二阶段是使用混合奖励(点式、配对式和列表式)进行微调,提升模型区分细微语义差异的能力。关键模块是并行切片排序奖励(PSRR)机制,用于计算精确的排序奖励。

关键创新:论文的关键创新在于提出了PoLi-RL框架和PSRR机制。PoLi-RL通过点到列表的学习方式,有效解决了复杂奖励信号下的强化学习训练问题。PSRR机制通过并行切片计算排序奖励,为每个补全提供了精确的学习信号,实现了细粒度的信用分配。这与传统的列表式强化学习直接计算整个列表的奖励有本质区别。

关键设计:PoLi-RL框架的关键设计包括:1) 两阶段课程学习策略,从简单到复杂逐步提升模型能力;2) 混合奖励函数,结合点式、配对式和列表式奖励,平衡训练难度和优化目标;3) 并行切片排序奖励(PSRR)机制,通过并行计算排序奖励,提高训练效率和精度。具体的损失函数是混合奖励的加权和,权重根据实验调整。

🖼️ 关键图片

📊 实验亮点

PoLi-RL在官方C-STS基准测试中取得了显著成果,Spearman相关系数达到48.18,超越了现有的交叉编码器架构的最佳性能。这证明了PoLi-RL框架在解决条件语义文本相似度任务中的有效性,并为未来的研究提供了新的方向。

🎯 应用场景

PoLi-RL框架可应用于各种需要条件判断和排序的任务,例如智能问答、信息检索、文本生成等。该研究为利用强化学习训练大型语言模型解决复杂的排序问题提供了一种新的思路,具有重要的实际价值和潜在的未来影响。

📄 摘要(原文)

Conditional Semantic Textual Similarity (C-STS) measures the semantic proximity between text segments under a specific condition, thereby overcoming the ambiguity inherent in traditional STS. However, existing methods are largely confined to discriminative models, failing to fully integrate recent breakthroughs in the NLP community concerning Large Language Models (LLMs) and Reinforcement Learning (RL). RL is a particularly well-suited paradigm for this task, as it can directly optimize the non-differentiable Spearman ranking metric and guide the reasoning process required by C-STS. However, we find that naively applying listwise RL fails to produce meaningful improvements, as the model is overwhelmed by complex, coarse-grained reward signals. To address this challenge, we introduce PoLi-RL, a novel Point-to-List Reinforcement Learning framework. PoLi-RL employs a two-stage curriculum: it first trains the model with simple pointwise rewards to establish fundamental scoring capabilities, then transitions to a hybrid reward that combines pointwise, pairwise, and listwise objectives to refine the model's ability to discern subtle semantic distinctions. Crucially, we propose an innovative Parallel Slice Ranking Reward (PSRR) mechanism that computes ranking rewards in parallel slices, where each slice comprises same-indexed completions from different samples. This provides a precise, differentiated learning signal for each individual completion, enabling granular credit assignment and effective optimization. On the official C-STS benchmark, PoLi-RL achieves a Spearman correlation coefficient of 48.18, establishing a new SOTA for the cross-encoder architecture. As the first work to successfully apply RL to C-STS, our study introduces a powerful and precise paradigm for training LLMs on complex, ranking-based conditional judgment tasks.