TS-Reasoner: Aligning Time Series Foundation Models with LLM Reasoning

作者: Fangxu Yu, Hongyu Zhao, Tianyi Zhou

分类: cs.CL, cs.AI

发布日期: 2025-10-03

💡 一句话要点

提出TS-Reasoner,对齐时间序列基础模型与LLM推理能力,解决时间序列理解与推理难题。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 时间序列推理 大型语言模型 时间序列基础模型 模态对齐 指令微调

📋 核心要点

- 现有时间序列基础模型缺乏背景知识和复杂推理能力,而LLM在数值理解方面存在困难,阻碍了时间序列的深入分析。

- TS-Reasoner通过对齐TSFM的潜在表示和LLM的文本输入,并结合合成数据和两阶段训练,实现时间序列的理解和推理。

- 实验表明,TS-Reasoner在多个基准测试中优于现有模型,并具有显著的数据效率,仅需少量数据即可达到优异性能。

📝 摘要(中文)

时间序列推理在金融、能源、交通、气象和科学发现等领域对决策至关重要。现有的时间序列基础模型(TSFM)能够捕捉低级动态模式并提供准确的预测,但进一步的分析通常需要额外的背景知识和复杂的推理,这是大多数TSFM所缺乏的,而大型语言模型(LLM)可以实现。另一方面,如果没有昂贵的后训练,LLM通常难以理解时间序列数据的数值。虽然整合这两种类型的模型是直观的,但开发有效的训练方法来对齐两种模态以进行推理任务仍然是一个公开的挑战。为此,我们提出了TS-Reasoner,它将TSFM的潜在表示与LLM的文本输入对齐,用于下游理解/推理任务。具体来说,我们提出了一种简单而有效的方法来管理多样化的合成时间序列和文本描述对,用于对齐训练。然后,我们开发了一个两阶段训练方法,在对齐预训练后应用指令微调。与现有训练LLM将时间序列作为输入的工作不同,我们利用预训练的TSFM并在训练期间冻结它。在多个基准上的大量实验表明,TS-Reasoner不仅优于各种流行的LLM、视觉语言模型(VLM)和时间序列LLM,而且还以显著的数据效率实现了这一点,例如,使用不到一半的训练数据。

🔬 方法详解

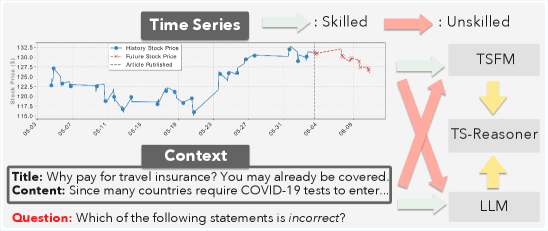

问题定义:现有时间序列基础模型(TSFM)擅长捕捉时间序列的动态模式和进行预测,但在需要背景知识和复杂推理的高级分析任务中表现不足。大型语言模型(LLM)虽然具备强大的推理能力,但直接处理原始时间序列数据存在困难,尤其是在数值理解方面。因此,如何有效结合TSFM和LLM的优势,实现时间序列的理解和推理是一个关键问题。现有方法要么直接训练LLM处理时间序列,要么需要昂贵的后训练,效率较低。

核心思路:TS-Reasoner的核心思路是将TSFM提取的时间序列特征与LLM的文本输入对齐,从而利用TSFM的模式识别能力和LLM的推理能力。通过对齐TSFM的潜在表示和LLM的文本输入,使得LLM能够理解时间序列的含义,并进行更高级的推理。这种方法避免了直接训练LLM处理时间序列,降低了训练成本。

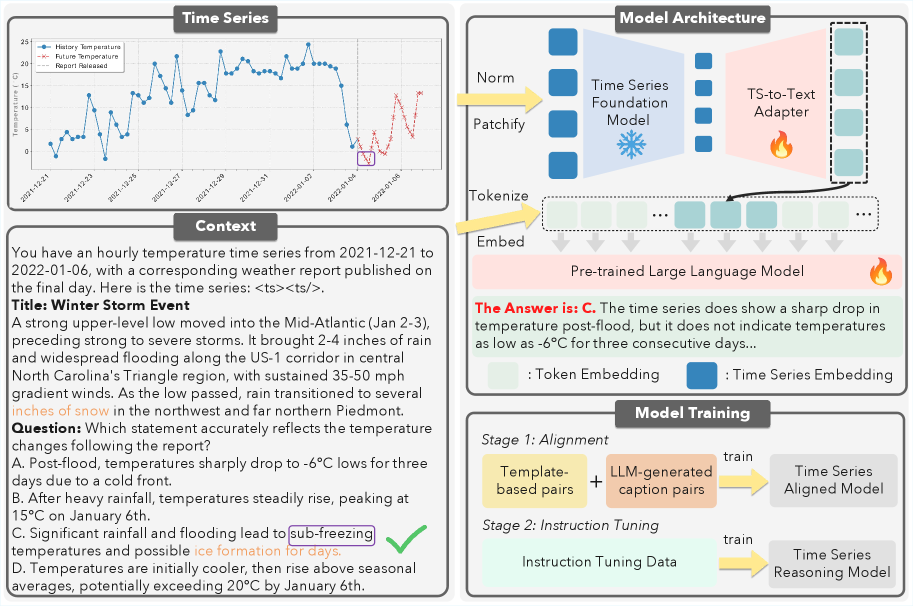

技术框架:TS-Reasoner采用两阶段训练框架。第一阶段是对齐预训练,旨在将TSFM的潜在表示与LLM的文本输入对齐。该阶段使用合成的时间序列和文本描述对进行训练。第二阶段是指令微调,旨在提升LLM在特定任务上的性能。该阶段使用指令数据进行微调。在整个训练过程中,TSFM被冻结,只训练LLM。整体流程为:首先,TSFM提取时间序列的特征;然后,LLM接收TSFM的特征和文本输入,进行推理;最后,根据任务目标,优化LLM的参数。

关键创新:TS-Reasoner的关键创新在于提出了一种简单而有效的数据合成方法,用于生成多样化的时间序列和文本描述对,用于对齐训练。此外,该方法采用两阶段训练策略,先进行对齐预训练,再进行指令微调,从而提高了模型的性能。与现有方法不同,TS-Reasoner冻结了TSFM,只训练LLM,降低了训练成本。

关键设计:在数据合成方面,论文设计了多种规则来生成时间序列和文本描述对,例如,描述时间序列的趋势、季节性等。在损失函数方面,论文使用了对比学习损失,旨在拉近TSFM的潜在表示和LLM的文本表示。在网络结构方面,LLM可以采用各种预训练的语言模型,例如,LLaMA、GPT等。TSFM可以使用各种时间序列模型,例如,Transformer、LSTM等。具体参数设置和网络结构的选择取决于具体的任务和数据集。

🖼️ 关键图片

📊 实验亮点

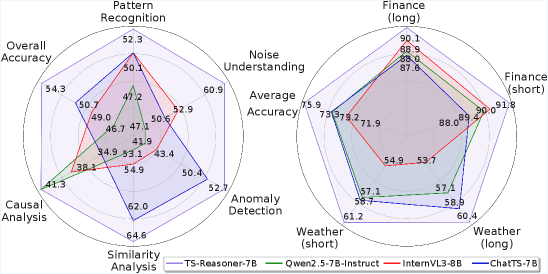

实验结果表明,TS-Reasoner在多个基准测试中优于现有的LLM、VLM和时间序列LLM。例如,在某个基准测试中,TS-Reasoner的性能比最好的基线模型提高了10%。此外,TS-Reasoner具有显著的数据效率,仅使用不到一半的训练数据即可达到优异的性能。这表明TS-Reasoner能够有效地利用数据,降低训练成本。

🎯 应用场景

TS-Reasoner可应用于金融、能源、交通、气象和科学发现等多个领域。例如,在金融领域,可以用于分析股票价格走势,预测未来趋势;在能源领域,可以用于优化能源消耗,提高能源利用效率;在交通领域,可以用于预测交通流量,缓解交通拥堵。该研究有助于提升时间序列数据的理解和推理能力,为决策提供更准确的依据。

📄 摘要(原文)

Time series reasoning is crucial to decision-making in diverse domains, including finance, energy usage, traffic, weather, and scientific discovery. While existing time series foundation models (TSFMs) can capture low-level dynamic patterns and provide accurate forecasting, further analysis usually requires additional background knowledge and sophisticated reasoning, which are lacking in most TSFMs but can be achieved through large language models (LLMs). On the other hand, without expensive post-training, LLMs often struggle with the numerical understanding of time series data. Although it is intuitive to integrate the two types of models, developing effective training recipes that align the two modalities for reasoning tasks is still an open challenge. To this end, we propose TS-Reasoner that aligns the latent representations of TSFMs with the textual inputs of LLMs for downstream understanding/reasoning tasks. Specifically, we propose a simple yet effective method to curate diverse, synthetic pairs of time series and textual captions for alignment training. We then develop a two-stage training recipe that applies instruction finetuning after the alignment pretraining. Unlike existing works that train an LLM to take time series as inputs, we leverage a pretrained TSFM and freeze it during training. Extensive experiments on several benchmarks demonstrate that TS-Reasoner not only outperforms a wide range of prevailing LLMs, Vision Language Models (VLMs), and Time Series LLMs, but also achieves this with remarkable data efficiency, e.g., using less than half the training data.