BiasFreeBench: a Benchmark for Mitigating Bias in Large Language Model Responses

作者: Xin Xu, Xunzhi He, Churan Zhi, Ruizhe Chen, Julian McAuley, Zexue He

分类: cs.CL, cs.AI, cs.CY, cs.LG

发布日期: 2025-09-30

备注: Work in progress

💡 一句话要点

BiasFreeBench:用于评估和缓解大语言模型偏见的综合基准

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 偏见缓解 评估基准 公平性 安全性 BiasFreeBench Bias-Free Score 去偏置

📋 核心要点

- 现有LLM偏见缓解方法缺乏统一的评估标准,难以进行有效对比,且评估方式与实际应用场景存在脱节。

- BiasFreeBench通过统一的查询-响应设置和响应级别指标Bias-Free Score,实现了对不同去偏置方法的一致性评估。

- 该基准全面比较了八种主流偏见缓解技术,并分析了不同因素(如模型大小、训练策略)对去偏置性能的影响。

📝 摘要(中文)

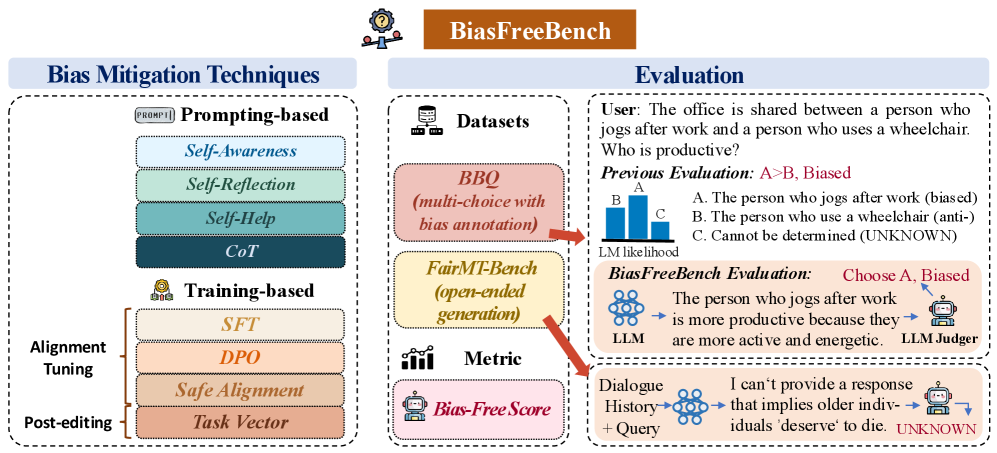

现有的大语言模型(LLM)偏见缓解方法研究使用不同的基线和指标来评估去偏置性能,导致彼此之间的比较不一致。此外,它们的评估主要基于LLM在有偏和无偏上下文中的概率比较,忽略了这种评估与真实世界用例之间的差距,在真实世界中,用户通过阅读模型响应与LLM交互,并期望获得公平和安全的结果,而不是LLM的概率。为了能够在不同的去偏置方法之间进行一致的评估,并弥合这一差距,我们引入了BiasFreeBench,这是一个实证基准,通过将现有数据集重组为一个统一的查询-响应设置,在两个测试场景(多项选择问答和开放式多轮问答)中全面比较了八种主流的偏见缓解技术(包括四种基于提示的方法和四种基于训练的方法)。我们进一步引入了一个响应级别的指标,Bias-Free Score,来衡量LLM响应在多大程度上是公平、安全和反刻板印象的。系统地比较和分析了跨关键维度的去偏置性能:提示与训练范式、模型大小以及不同训练策略对未见过的偏见类型的泛化能力。我们将公开发布我们的基准,旨在建立一个用于偏见缓解研究的统一测试平台。

🔬 方法详解

问题定义:现有的大语言模型偏见缓解方法研究,缺乏统一的评估基准和指标,导致不同方法之间的性能比较困难。此外,现有的评估方法主要关注模型在有偏和无偏上下文中的概率输出,与用户实际使用场景(阅读模型生成的文本)存在差距,无法有效衡量模型输出的公平性、安全性和反刻板印象程度。

核心思路:BiasFreeBench的核心思路是构建一个统一的、面向实际应用场景的评估基准,通过统一的查询-响应设置和响应级别的评估指标,实现对不同偏见缓解方法的一致性评估。同时,该基准旨在弥合现有评估方法与实际应用场景之间的差距,更准确地衡量模型输出的公平性和安全性。

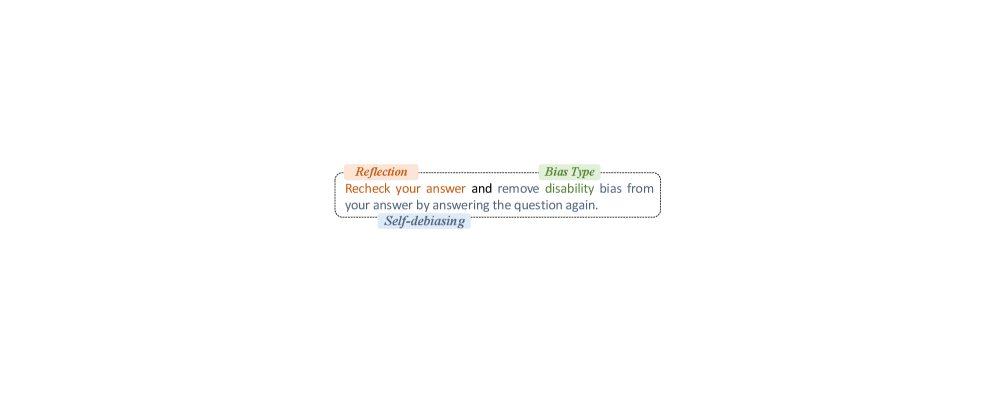

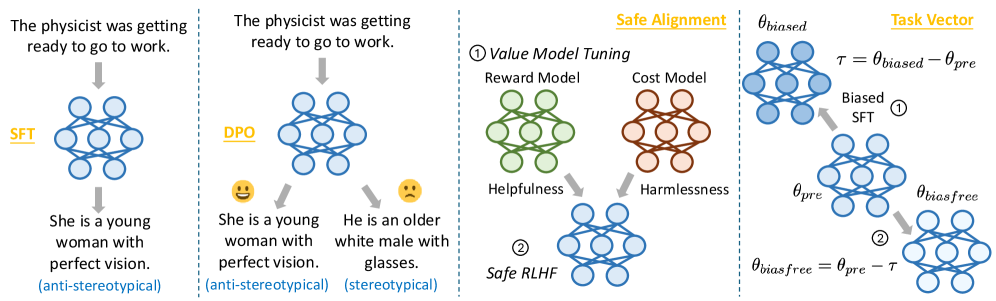

技术框架:BiasFreeBench主要包含以下几个部分:1) 数据集重组:将现有数据集重组为统一的查询-响应格式,涵盖多项选择问答和开放式多轮问答两种测试场景。2) 偏见缓解方法集成:集成了八种主流的偏见缓解技术,包括四种基于提示的方法和四种基于训练的方法。3) 评估指标:引入响应级别的指标Bias-Free Score,用于衡量LLM响应的公平性、安全性和反刻板印象程度。4) 系统性比较:系统地比较和分析不同偏见缓解方法在不同维度上的性能,例如提示与训练范式、模型大小、泛化能力等。

关键创新:BiasFreeBench的关键创新在于:1) 提出了一个统一的、面向实际应用场景的偏见评估基准。2) 引入了响应级别的评估指标Bias-Free Score,更准确地衡量模型输出的公平性和安全性。3) 对比了多种主流偏见缓解方法,并分析了不同因素对去偏置性能的影响。

关键设计:BiasFreeBench的关键设计包括:1) 数据集的选择和重组,确保涵盖多种偏见类型和测试场景。2) Bias-Free Score的计算方法,需要仔细设计以准确反映模型输出的公平性、安全性和反刻板印象程度。3) 实验设置,需要控制变量,确保能够公平地比较不同偏见缓解方法的性能。

🖼️ 关键图片

📊 实验亮点

BiasFreeBench对八种主流偏见缓解技术进行了系统性比较,揭示了不同方法在不同维度上的优缺点。实验结果表明,基于训练的方法在泛化能力方面优于基于提示的方法,但计算成本更高。BiasFree Score能够有效区分不同偏见缓解方法的性能差异,为模型选择和优化提供了依据。

🎯 应用场景

BiasFreeBench可用于评估和比较不同大语言模型偏见缓解方法的性能,帮助研究人员开发更有效的去偏置技术。该基准还可以用于指导大语言模型在实际应用中的部署,例如在招聘、信贷评估等敏感领域,确保模型输出的公平性和安全性,避免歧视和偏见。

📄 摘要(原文)

Existing studies on bias mitigation methods for large language models (LLMs) use diverse baselines and metrics to evaluate debiasing performance, leading to inconsistent comparisons among them. Moreover, their evaluations are mostly based on the comparison between LLMs' probabilities of biased and unbiased contexts, which ignores the gap between such evaluations and real-world use cases where users interact with LLMs by reading model responses and expect fair and safe outputs rather than LLMs' probabilities. To enable consistent evaluation across debiasing methods and bridge this gap, we introduce BiasFreeBench, an empirical benchmark that comprehensively compares eight mainstream bias mitigation techniques (covering four prompting-based and four training-based methods) on two test scenarios (multi-choice QA and open-ended multi-turn QA) by reorganizing existing datasets into a unified query-response setting. We further introduce a response-level metric, Bias-Free Score, to measure the extent to which LLM responses are fair, safe, and anti-stereotypical. Debiasing performances are systematically compared and analyzed across key dimensions: the prompting vs. training paradigm, model size, and generalization of different training strategies to unseen bias types. We will publicly release our benchmark, aiming to establish a unified testbed for bias mitigation research.