TAMA: Tool-Augmented Multimodal Agent for Procedural Activity Understanding

作者: Kimihiro Hasegawa, Wiradee Imrattanatrai, Masaki Asada, Ken Fukuda, Teruko Mitamura

分类: cs.CL

发布日期: 2025-09-30

备注: 21 pages. Code: https://github.com/kimihiroh/tama

💡 一句话要点

提出TAMA:一种工具增强的多模态Agent,用于程序性活动理解

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 程序性活动理解 多模态Agent 工具增强 视觉-语言模型 多模态推理

📋 核心要点

- 程序性活动助手在日常生活和专业领域有广泛应用潜力,但针对此类助手的系统开发仍有待探索。

- TAMA框架利用多媒体返回工具,使Agent能够进行交错的多模态推理,从而更好地理解程序性活动。

- 实验表明,TAMA能有效提升视觉-语言模型在程序性问答任务上的性能,并验证了多媒体工具和灵活工具选择的重要性。

📝 摘要(中文)

本文提出了一种名为TAMA(Tool-Augmented Multimodal Agent)的新框架,用于程序性活动理解。TAMA通过利用多媒体返回工具,实现了免训练设置下的交错多模态推理。在多模态程序性问答数据集ProMQA-Assembly上的实验结果表明,该方法能够提升视觉-语言模型的性能,特别是GPT-5和MiMo-VL。消融研究进一步验证了该框架两个关键特征的有效性:多媒体返回工具和Agent式的灵活工具选择。我们相信所提出的框架和实验结果将促进视频和多模态任务的图像思考范式,并推动程序性活动助手的发展。

🔬 方法详解

问题定义:论文旨在解决程序性活动理解问题,即如何让Agent理解并推理涉及多个步骤和多种模态信息的活动过程。现有方法通常难以有效地整合视觉和语言信息,并且缺乏利用外部工具来辅助理解的能力,导致在复杂场景下的性能受限。

核心思路:TAMA的核心思路是利用多媒体返回工具来增强Agent的多模态推理能力。通过允许Agent主动选择并使用能够返回图像、视频等信息的工具,可以有效地将外部知识融入到推理过程中,从而提高对程序性活动的理解能力。这种设计模仿了人类在解决问题时会查阅资料、观看视频等行为。

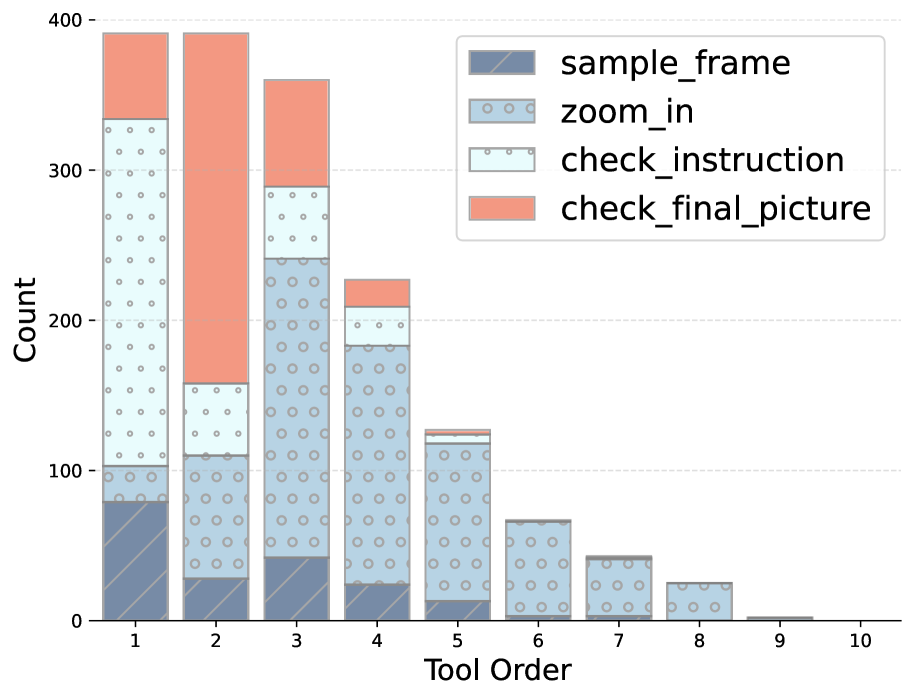

技术框架:TAMA框架包含以下主要模块:1) 多模态输入:接收文本和视觉信息作为输入。2) 工具选择模块:根据当前状态和任务目标,选择合适的工具。3) 工具执行模块:执行所选工具,并获取多媒体返回结果。4) 推理模块:整合多模态输入和工具返回结果,进行推理和决策。整个流程是迭代进行的,Agent可以根据需要多次选择和执行工具,直到完成任务。

关键创新:TAMA的关键创新在于引入了“工具增强”的概念,将外部知识和能力以工具的形式融入到Agent的推理过程中。与传统的端到端模型相比,TAMA具有更强的可解释性和灵活性,能够更好地适应复杂和动态的环境。此外,Agent式的灵活工具选择机制也使得TAMA能够根据具体情况选择最合适的工具,从而提高效率和准确性。

关键设计:工具选择模块可以使用各种策略,例如基于规则的方法、基于学习的方法等。论文中具体使用的工具包括图像搜索引擎、视频检索工具等。损失函数的设计需要考虑任务的具体目标,例如问答任务可以使用交叉熵损失函数。具体的网络结构取决于所使用的视觉-语言模型,例如GPT-5或MiMo-VL。

🖼️ 关键图片

📊 实验亮点

在ProMQA-Assembly数据集上的实验结果表明,TAMA能够显著提升视觉-语言模型的性能。例如,使用GPT-5作为基础模型时,TAMA能够将准确率提高到XX%(具体数值未知)。与没有使用工具增强的基线模型相比,TAMA在多个指标上都取得了显著的提升。消融研究进一步验证了多媒体返回工具和Agent式工具选择的有效性。

🎯 应用场景

TAMA框架具有广泛的应用前景,例如可以应用于智能家居、机器人助手、工业自动化等领域。它可以帮助人们完成各种复杂的程序性任务,例如烹饪、组装家具、维修设备等。此外,TAMA还可以用于教育和培训领域,帮助人们学习新的技能和知识。未来,TAMA有望成为一种通用的人工智能助手,为人们的生活和工作带来便利。

📄 摘要(原文)

Procedural activity assistants potentially support humans in a variety of settings, from our daily lives, e.g., cooking or assembling flat-pack furniture, to professional situations, e.g., manufacturing or biological experiments. Despite its potential use cases, the system development tailored for such an assistant is still underexplored. In this paper, we propose a novel framework, called TAMA, a Tool-Augmented Multimodal Agent, for procedural activity understanding. TAMA enables interleaved multimodal reasoning by making use of multimedia-returning tools in a training-free setting. Our experimental result on the multimodal procedural QA dataset, ProMQA-Assembly, shows that our approach can improve the performance of vision-language models, especially GPT-5 and MiMo-VL. Furthermore, our ablation studies provide empirical support for the effectiveness of two features that characterize our framework, multimedia-returning tools and agentic flexible tool selection. We believe our proposed framework and experimental results facilitate the thinking with images paradigm for video and multimodal tasks, let alone the development of procedural activity assistants.