One-Token Rollout: Guiding Supervised Fine-Tuning of LLMs with Policy Gradient

作者: Rui Ming, Haoyuan Wu, Shoubo Hu, Zhuolun He, Bei Yu

分类: cs.CL

发布日期: 2025-09-30 (更新: 2026-01-31)

💡 一句话要点

提出One-Token Rollout算法,利用策略梯度指导LLM的监督微调,提升泛化能力。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 监督微调 强化学习 策略梯度 泛化能力

📋 核心要点

- SFT微调LLM依赖固定数据集,泛化能力受限,而RL利用on-policy数据,但成本高昂。

- OTR算法将token生成视为单步强化学习,利用策略梯度将off-policy数据转化为on-policy信号。

- 实验表明,OTR在数学推理、代码生成和通用推理任务上均优于标准SFT,提升了模型性能。

📝 摘要(中文)

监督微调(SFT)是调整大型语言模型(LLM)的主要方法,但与强化学习(RL)相比,它在泛化方面常常表现不佳。本文认为,这种性能差异不仅源于损失函数,更源于一个更根本的区别:SFT从固定的、预先收集的数据集中学习,而RL利用从当前策略中采样的on-policy数据。基于此,我们引入了one-token rollout (OTR),这是一种新的微调算法,它使用策略梯度方法来指导SFT。OTR通过将每个token生成视为单步强化学习轨迹来重构自回归学习过程。在每一步,它通过从当前策略的分布中采样多个候选token来执行蒙特卡罗“rollout”。然后,使用来自监督数据的ground-truth token为这些样本提供奖励信号。在策略梯度的指导下,我们的算法将静态的、off-policy的监督数据转化为token级别的动态的、on-policy信号,从而获得on-policy学习的泛化优势,同时避免了完整句子生成的高昂开销。通过在涵盖数学推理、代码生成和通用领域推理等一系列具有挑战性的基准上进行的大量实验,我们证明OTR始终优于标准SFT。我们的发现确立了OTR作为微调LLM的一种强大而实用的替代方案,并提供了令人信服的证据,表明数据的on-policy性质是泛化的关键驱动因素,为微调LLM提供了一个有希望的新方向。

🔬 方法详解

问题定义:监督微调(SFT)在大型语言模型(LLM)的微调中被广泛应用,但其泛化能力通常不如强化学习(RL)。SFT依赖于预先收集的静态数据集,缺乏探索性,容易过拟合训练数据。现有方法难以兼顾训练效率和泛化性能。

核心思路:论文的核心思路是将SFT过程中的每个token生成步骤视为一个单步强化学习过程。通过引入策略梯度,将静态的off-policy监督数据转化为动态的on-policy信号,从而使模型能够从当前策略中进行探索,提升泛化能力。这种方法旨在结合SFT的效率和RL的泛化优势。

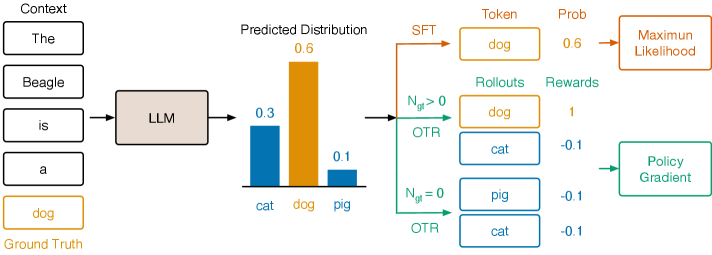

技术框架:OTR算法的核心流程如下: 1. Token Rollout:在每个token生成步骤,从当前模型的策略分布中采样多个候选token。 2. Reward Assignment:使用监督数据中的ground-truth token作为奖励信号,对采样得到的候选token进行评估。 3. Policy Gradient Update:利用策略梯度算法,根据奖励信号调整模型的策略,使其更倾向于生成正确的token。 整个框架将SFT过程转化为一个序列决策问题,通过策略梯度进行优化。

关键创新:OTR算法的关键创新在于将监督学习和强化学习相结合,通过策略梯度将静态的监督数据转化为动态的on-policy信号。与传统的SFT方法相比,OTR能够利用模型的当前策略进行探索,从而提升泛化能力。与传统的RL方法相比,OTR避免了完整句子生成的高昂开销,提高了训练效率。

关键设计:OTR算法的关键设计包括: 1. Rollout策略:采用蒙特卡罗方法进行rollout,采样多个候选token。 2. 奖励函数:使用ground-truth token作为奖励信号,简单有效。 3. 策略梯度算法:选择合适的策略梯度算法(如REINFORCE或Actor-Critic)进行策略更新。 4. 学习率和训练轮数:需要仔细调整学习率和训练轮数,以避免过拟合或欠拟合。

🖼️ 关键图片

📊 实验亮点

实验结果表明,OTR算法在数学推理、代码生成和通用领域推理等多个任务上均优于标准的SFT方法。例如,在某些任务上,OTR的性能提升超过了5%。这些结果表明,OTR是一种有效且实用的LLM微调方法,能够显著提升模型的泛化能力。

🎯 应用场景

OTR算法可广泛应用于各种需要微调LLM的场景,例如自然语言生成、代码生成、机器翻译等。该方法能够提升LLM在特定任务上的泛化能力和性能,具有重要的实际应用价值。未来,OTR可以与其他技术相结合,进一步提升LLM的性能和效率。

📄 摘要(原文)

Supervised fine-tuning (SFT) is the predominant method for adapting large language models (LLMs), yet it often struggles with generalization compared to reinforcement learning (RL). In this work, we posit that this performance disparity stems not just from the loss function, but from a more fundamental difference: SFT learns from a fixed, pre-collected dataset, whereas RL utilizes on-policy data sampled from the current policy. Building on this hypothesis, we introduce one-token rollout (OTR), a novel fine-tuning algorithm that guides SFT with the policy gradient method. OTR reframes the autoregressive learning process by treating each token generation as a single-step reinforcement learning trajectory. At each step, it performs a Monte Carlo ``rollout'' by sampling multiple candidate tokens from the current policy's distribution. The ground-truth token from the supervised data is then used to provide a reward signal to these samples. Guided by policy gradient, our algorithm repurposes static, off-policy supervised data into a dynamic, on-policy signal at the token level, capturing the generalization benefits of on-policy learning while bypassing the costly overhead of full sentence generation. Through extensive experiments on a diverse suite of challenging benchmarks spanning mathematical reasoning, code generation, and general domain reasoning, we demonstrate that OTR consistently outperforms standard SFT. Our findings establish OTR as a powerful and practical alternative for fine-tuning LLMs and provide compelling evidence that the on-policy nature of data is a critical driver of generalization, offering a promising new direction for fine-tuning LLMs.