Finetune Once: Decoupling General & Domain Learning with Dynamic Boosted Annealing

作者: Yang Tang, Ruijie Liu, Yifan Wang, Shiyu Li, Xi Chen

分类: cs.CL, cs.AI, cs.LG

发布日期: 2025-09-30 (更新: 2025-10-17)

备注: 9 pages, 5 figures

💡 一句话要点

提出动态增强退火(DBA)方法,解耦通用与领域学习,高效微调LLM。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型微调 领域自适应 梯度增强 退火学习 零学习率训练

📋 核心要点

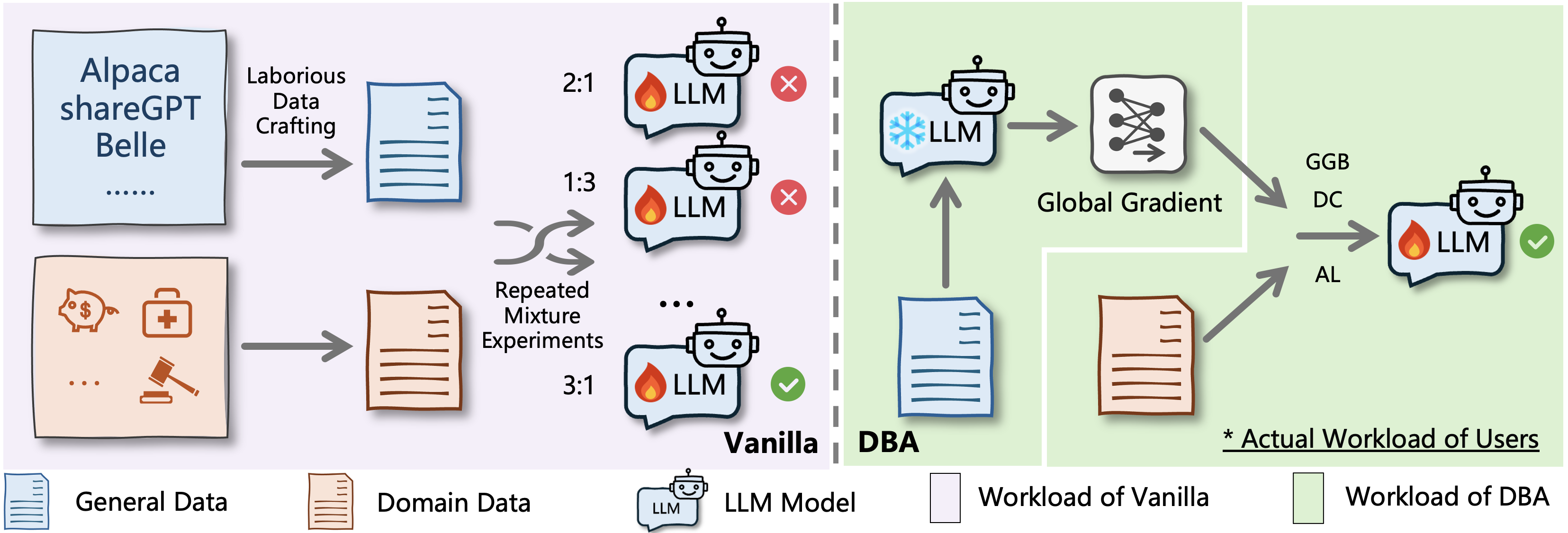

- 传统LLM微调需要复杂的数据混合和多次实验,以达到最佳泛化效果,过程繁琐且计算成本高昂。

- DBA方法通过在通用数据上进行零学习率训练获得全局梯度,用于指导领域数据的微调,实现解耦学习。

- 实验表明,DBA在多个任务上比传统微调平均提升5.8%的联合性能,并显著减少了91%的GPU使用时间。

📝 摘要(中文)

大型语言模型(LLM)的微调展现出卓越的潜力。然而,传统的微调方法通常需要复杂的数据混合和重复实验才能获得最佳的泛化性能。为了解决这些挑战并简化训练过程,我们提出了一种高效且通用的解决方案,即动态增强退火(DBA)。我们首先通过在通用数据上进行零学习率训练获得全局梯度,然后将其用于领域训练期间的梯度增强和动态训练步长校正。结合退火学习,我们最终建立了一个仅依赖于领域数据而不会崩溃的微调流程。通过在多个流行基础模型上评估通用和领域特定任务的性能,DBA在联合性能方面比传统微调平均提高了5.8%。此外,由于通用数据不再参与退火过程,因此也消除了数据混合导致的重复实验。根据我们的测试,与传统方法相比,DBA方法可以减少91.0%的GPU使用时间。

🔬 方法详解

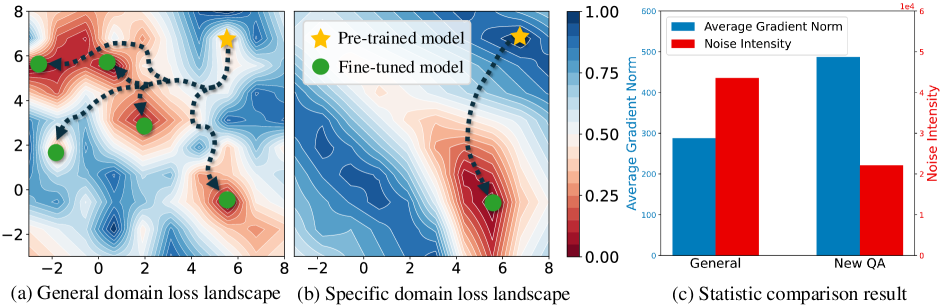

问题定义:传统LLM微调方法在特定领域任务上表现不佳,需要针对领域数据进行微调。然而,直接在领域数据上微调容易过拟合,导致模型在通用能力上的损失。此外,为了平衡通用能力和领域能力,通常需要混合通用数据和领域数据进行微调,但数据混合比例的选择需要多次实验,耗时耗力。

核心思路:DBA的核心思路是将通用知识的学习和领域知识的学习解耦。首先,利用通用数据学习一个全局梯度,该梯度代表了模型对通用知识的理解方向。然后,在领域数据上进行微调时,利用该全局梯度进行增强,引导模型在学习领域知识的同时,保持一定的通用能力。同时,采用动态训练步长校正和退火学习,避免模型崩溃。

技术框架:DBA方法主要包含两个阶段:通用知识学习阶段和领域知识微调阶段。在通用知识学习阶段,使用通用数据以零学习率训练模型,得到全局梯度。在领域知识微调阶段,使用领域数据进行微调,同时利用通用知识学习阶段得到的全局梯度进行梯度增强,并采用动态训练步长校正和退火学习策略。

关键创新:DBA的关键创新在于解耦了通用知识学习和领域知识学习。通过在通用数据上进行零学习率训练,获得全局梯度,该梯度可以作为领域知识学习的先验知识,引导模型在学习领域知识的同时,保持一定的通用能力。这种解耦学习的方式避免了传统微调方法中数据混合比例选择的难题,并提高了微调效率。

关键设计:DBA的关键设计包括:1) 零学习率训练:使用零学习率训练通用数据,可以得到一个稳定的全局梯度,避免了模型在通用数据上过拟合。2) 梯度增强:利用全局梯度对领域数据的梯度进行增强,可以引导模型在学习领域知识的同时,保持一定的通用能力。3) 动态训练步长校正:根据梯度增强的程度动态调整训练步长,避免模型崩溃。4) 退火学习:采用退火学习策略,逐渐降低学习率,使模型能够更好地收敛。

🖼️ 关键图片

📊 实验亮点

DBA方法在多个任务上进行了评估,结果表明,与传统微调方法相比,DBA在联合性能方面平均提高了5.8%。更重要的是,DBA方法可以减少91.0%的GPU使用时间,极大地提高了微调效率。这些实验结果充分证明了DBA方法的有效性和优越性。

🎯 应用场景

DBA方法可广泛应用于各种需要对LLM进行微调的场景,例如:特定领域的文本生成、问答系统、对话系统等。该方法能够显著提高微调效率,降低计算成本,并提升模型在领域特定任务上的性能,具有重要的实际应用价值和未来发展潜力。

📄 摘要(原文)

Large language models (LLMs) fine-tuning shows excellent implications. However, vanilla fine-tuning methods often require intricate data mixture and repeated experiments for optimal generalization. To address these challenges and streamline the training process, we propose an efficient and universal solution, Dynamic Boosted Annealing (DBA). We obtain a global gradient through zero-learning-rate training on general data, which is subsequently employed for gradient boosting and dynamic training step correction during domain training. In conjunction with annealing learning, we end up establishing a fine-tuning pipeline that relies solely on domain data without collapse. By evaluating both general and domain-specific performance across multiple tasks on several popular base models, DBA achieves an average improvement of 5.8% in joint performance over vanilla fine-tuning. Furthermore, since general data is no longer involved in annealing, repeated experiments led by data mixture are also eliminated. According to our tests, the DBA method can reduce GPU hours by 91.0% compared to the vanilla method.