Atomic Thinking of LLMs: Decoupling and Exploring Mathematical Reasoning Abilities

作者: Jiayi Kuang, Haojing Huang, Yinghui Li, Xinnian Liang, Zhikun Xu, Yangning Li, Xiaoyu Tan, Chao Qu, Meishan Zhang, Ying Shen, Philip S. Yu

分类: cs.CL

发布日期: 2025-09-30

💡 一句话要点

解耦LLM数学能力:提出原子思维范式,探索数学推理能力的本质

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 数学推理 原子思维 能力解耦 数据集构建

📋 核心要点

- 现有LLM数学推理依赖大规模数据集,难以判断模型是否真正理解数学概念,存在过拟合风险。

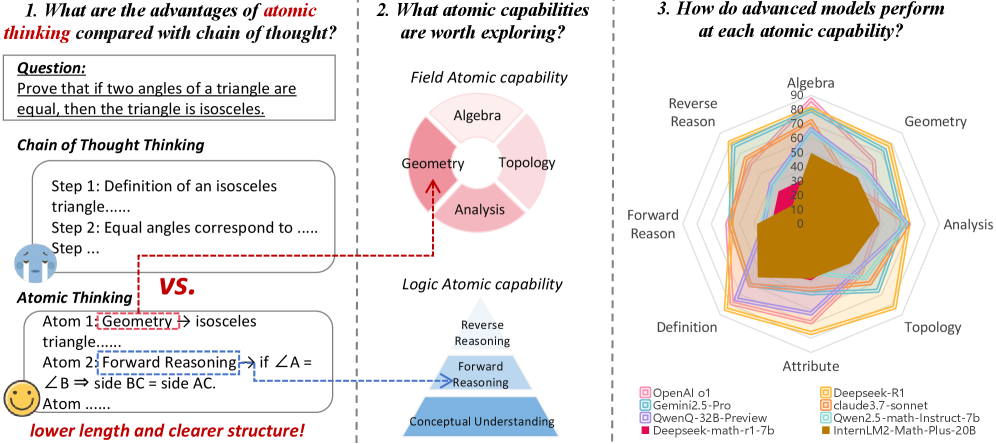

- 提出“原子思维”范式,将数学能力解耦为领域特定能力和逻辑能力,更细粒度地评估模型。

- 构建原子能力数据集,实验分析不同原子能力间的相互影响,为模型训练提供新思路。

📝 摘要(中文)

大型语言模型(LLM)在数学推理能力方面表现出色。然而,我们认为当前的大规模推理模型主要依赖于通过包含各种数学问题和长思考链的训练数据集进行扩展,这引发了关于LLM是否真正掌握了数学概念和推理原则,还是仅仅记住了训练数据的问题。与此相反,人类倾向于将复杂问题分解为多个基本原子能力。受此启发,我们提出了一种新的范式来评估数学原子能力。我们的工作将原子能力分为两个维度:(1)跨越四个主要数学领域(代数、几何、分析和拓扑)的特定领域能力,以及(2)不同级别的逻辑能力,包括概念理解、使用形式数学语言进行的前向多步推理以及反例驱动的后向推理。我们为每个原子能力单元提出了相应的训练和评估数据集,并进行了广泛的实验,研究不同的原子能力如何相互影响,以探索引发所需特定原子能力的策略。对高级模型的评估和实验结果显示了关于模型在各种原子能力上的不同表现以及原子能力之间相互作用的许多有趣的发现和启发。我们的发现强调了将数学智能解耦为原子组成部分的重要性,为模型认知提供了新的见解,并指导了训练策略的发展,使其朝着更高效、可迁移和认知基础的“原子思维”范式发展。

🔬 方法详解

问题定义:现有的大型语言模型在数学推理方面取得了显著的成果,但它们严重依赖于大规模的训练数据集,这些数据集包含了大量的数学问题和复杂的推理链。这种方法的主要问题在于,我们无法确定模型是否真正理解了数学概念和推理原则,还是仅仅记住了训练数据。换句话说,模型可能只是在模仿训练数据中的模式,而没有真正掌握数学的本质。

核心思路:本文的核心思路是借鉴人类解决复杂问题的方式,即将其分解为多个基本的、不可再分的“原子”能力。通过将数学推理能力分解为更小的、更易于管理的单元,我们可以更精确地评估模型在每个单元上的表现,并了解不同单元之间的相互作用。这种“原子思维”范式有助于我们更好地理解模型的认知过程,并指导我们设计更有效的训练策略。

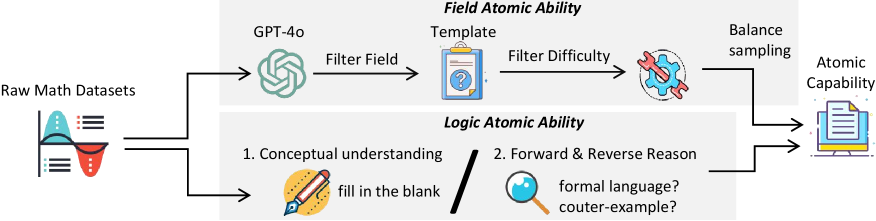

技术框架:该研究的技术框架主要包括以下几个步骤:首先,将数学能力分解为两个维度:领域特定能力(代数、几何、分析、拓扑)和逻辑能力(概念理解、前向推理、后向推理)。其次,为每个原子能力单元构建相应的训练和评估数据集。这些数据集旨在测试模型在特定原子能力上的表现。最后,进行大量的实验,研究不同的原子能力如何相互影响,以及如何通过训练来提升模型的原子能力。

关键创新:该研究最重要的技术创新点在于提出了“原子思维”范式,这是一种全新的评估和训练LLM数学推理能力的方法。与传统的依赖大规模数据集的方法不同,原子思维范式强调将数学能力分解为更小的、更易于管理的单元,从而可以更精确地评估模型在每个单元上的表现,并了解不同单元之间的相互作用。这种方法有助于我们更好地理解模型的认知过程,并指导我们设计更有效的训练策略。

关键设计:该研究的关键设计包括:(1) 原子能力的分类体系,将数学能力分解为领域特定能力和逻辑能力;(2) 针对每个原子能力单元设计的训练和评估数据集,这些数据集需要精心设计,以确保能够准确地评估模型在特定原子能力上的表现;(3) 实验设计,旨在研究不同原子能力之间的相互影响,以及如何通过训练来提升模型的原子能力。具体的参数设置、损失函数和网络结构等技术细节在论文中没有详细说明,可能需要参考相关文献。

🖼️ 关键图片

📊 实验亮点

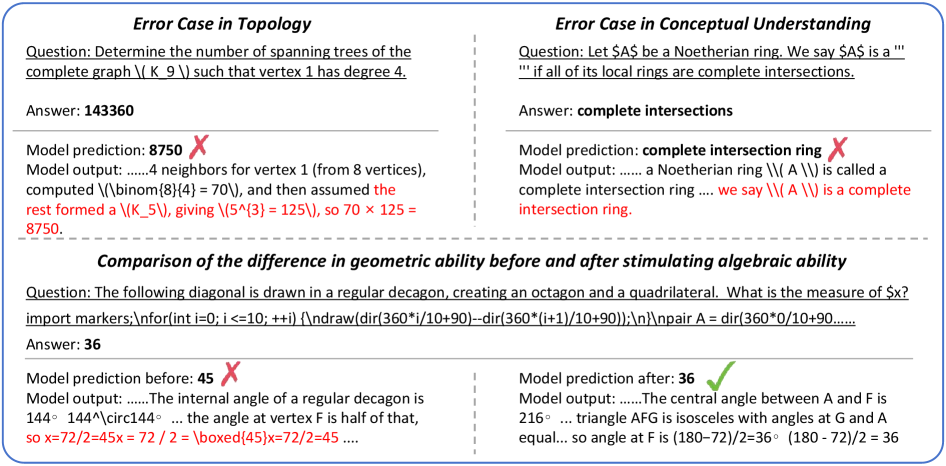

实验结果表明,不同LLM在不同原子能力上表现差异显著,例如,某些模型擅长代数运算,而另一些模型则更擅长几何推理。此外,实验还揭示了原子能力之间的相互影响,例如,概念理解能力对前向推理能力有显著影响。这些发现为我们理解LLM的数学推理能力提供了新的见解。

🎯 应用场景

该研究成果可应用于提升LLM的数学推理能力,使其在科学计算、金融分析、工程设计等领域发挥更大作用。通过原子思维范式,可以更有效地训练模型,使其具备更强的泛化能力和解决复杂问题的能力。此外,该研究也为认知科学提供了新的视角,有助于我们理解人类的数学思维过程。

📄 摘要(原文)

Large Language Models (LLMs) have demonstrated outstanding performance in mathematical reasoning capabilities. However, we argue that current large-scale reasoning models primarily rely on scaling up training datasets with diverse mathematical problems and long thinking chains, which raises questions about whether LLMs genuinely acquire mathematical concepts and reasoning principles or merely remember the training data. In contrast, humans tend to break down complex problems into multiple fundamental atomic capabilities. Inspired by this, we propose a new paradigm for evaluating mathematical atomic capabilities. Our work categorizes atomic abilities into two dimensions: (1) field-specific abilities across four major mathematical fields, algebra, geometry, analysis, and topology, and (2) logical abilities at different levels, including conceptual understanding, forward multi-step reasoning with formal math language, and counterexample-driven backward reasoning. We propose corresponding training and evaluation datasets for each atomic capability unit, and conduct extensive experiments about how different atomic capabilities influence others, to explore the strategies to elicit the required specific atomic capability. Evaluation and experimental results on advanced models show many interesting discoveries and inspirations about the different performances of models on various atomic capabilities and the interactions between atomic capabilities. Our findings highlight the importance of decoupling mathematical intelligence into atomic components, providing new insights into model cognition and guiding the development of training strategies toward a more efficient, transferable, and cognitively grounded paradigm of "atomic thinking".