Circuit Distillation

作者: Somin Wadhwa, Silvio Amir, Byron C. Wallace

分类: cs.CL

发布日期: 2025-09-29

备注: Preprint; Under Review

💡 一句话要点

提出电路蒸馏方法,通过对齐模型内部表征实现算法能力迁移

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 模型蒸馏 知识迁移 电路蒸馏 表征对齐 算法能力 心智理论 实体跟踪

📋 核心要点

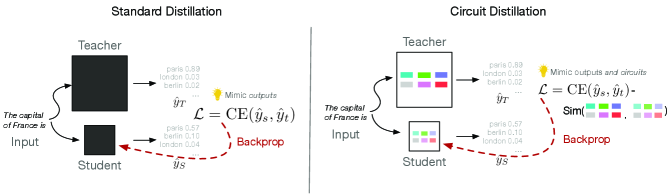

- 传统模型蒸馏忽略了教师模型的内部计算机制,仅关注输入输出的模仿,限制了算法能力的迁移。

- 电路蒸馏通过对齐教师和学生模型中功能对应的电路组件的内部表征,实现底层计算机制的迁移。

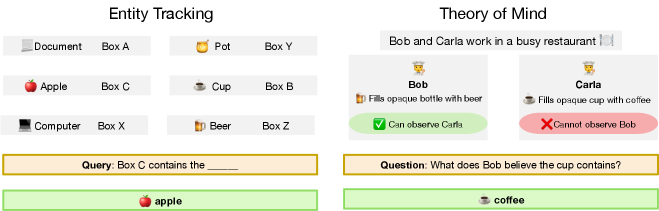

- 实验表明,电路蒸馏在实体跟踪和心智理论任务上优于标准蒸馏,能够高效迁移算法能力。

📝 摘要(中文)

模型蒸馏通常侧重于行为模仿,即训练学生模型复制教师模型的输出,而将其内部计算视为黑盒。本文提出了一种替代方法:蒸馏教师模型所实现的底层计算机制。具体而言,我们提出了电路蒸馏,引入了一个目标来对齐教师模型和学生模型中类似电路组件之间的内部表征。我们提出了一种匹配“功能对应”电路组件的方法,并引入一个损失函数来反映这些组件所产生的表征之间的相似性。我们使用 Llama3 系列的模型在实体跟踪和心智理论 (ToM) 任务上评估了电路蒸馏。结果表明,电路蒸馏优于标准蒸馏,通过仅调整学生模型参数的一个小的、有针对性的子集,成功地迁移了算法能力。这项工作确立了迁移机制的可行性,这反过来又可以通过可解释和可控的内部学生机制来实现对目标教师能力的有效蒸馏。

🔬 方法详解

问题定义:现有模型蒸馏方法主要关注行为模仿,即将学生模型的输出与教师模型的输出对齐。这种方法忽略了教师模型内部的计算机制,导致学生模型难以学习到教师模型的深层算法能力。因此,需要一种能够将教师模型的内部计算机制迁移到学生模型的方法。

核心思路:本文的核心思路是“电路蒸馏”,即通过对齐教师模型和学生模型中功能对应的电路组件的内部表征,来实现算法能力的迁移。这种方法假设模型内部存在可解释的“电路”,这些电路负责执行特定的计算功能。通过对齐这些电路的表征,可以将教师模型的算法能力有效地传递给学生模型。

技术框架:电路蒸馏的技术框架主要包括以下几个步骤:1) 识别教师模型和学生模型中功能对应的电路组件。这可以通过分析模型的激活模式、梯度或其他相关信息来实现。2) 引入一个损失函数,用于衡量教师模型和学生模型中对应电路组件的内部表征之间的相似性。3) 使用该损失函数来训练学生模型,使其内部表征与教师模型对齐。

关键创新:该方法最重要的技术创新点在于提出了“电路蒸馏”的概念,并将其应用于模型蒸馏任务中。与传统的行为模仿方法相比,电路蒸馏能够更有效地迁移教师模型的算法能力,并且可以实现对学生模型内部机制的控制和解释。

关键设计:关键设计包括:1) 如何定义和识别“功能对应”的电路组件。论文提出了一种方法来匹配这些组件,但具体细节未知。2) 用于衡量内部表征相似性的损失函数。具体形式未知,但需要能够有效地对齐教师模型和学生模型的内部表征。3) 如何选择和调整学生模型参数,以实现高效的算法能力迁移。论文提到只调整了学生模型参数的一个小的、有针对性的子集。

🖼️ 关键图片

📊 实验亮点

实验结果表明,电路蒸馏在实体跟踪和心智理论 (ToM) 任务上优于标准蒸馏。通过仅调整学生模型参数的一个小的、有针对性的子集,电路蒸馏成功地迁移了算法能力。具体性能提升数据未知,但结果表明电路蒸馏是一种有效的算法能力迁移方法。

🎯 应用场景

电路蒸馏具有广泛的应用前景,例如:1) 知识产权保护:可以将大型模型的算法能力迁移到小型模型,同时隐藏大型模型的具体实现细节。2) 模型压缩:可以通过蒸馏将复杂模型的算法能力迁移到更简单的模型,从而实现模型压缩。3) 领域迁移:可以将一个领域的模型知识迁移到另一个领域,从而加速新领域的模型开发。

📄 摘要(原文)

Model distillation typically focuses on behavioral mimicry, where a student model is trained to replicate a teacher's output while treating its internal computations as a black box. In this work we propose an alternative approach: Distilling the underlying computational mechanisms implemented by a teacher model. Specifically, we propose circuit distillation, which introduces an objective to align internal representations between analogous circuit components in teacher and student models. We propose a method to match ``functionally correspondent'' circuit components and introduce a loss reflecting similarities between the representations that these induce. We evaluate circuit distillation on entity tracking and theory of mind (ToM) tasks using models from the Llama3 family. Our results demonstrate that circuit distillation outperforms standard distillation, successfully transferring algorithmic capabilities by adjusting only a small, targeted subset of student model parameters. This work establishes the feasibility of transferring mechanisms, which may in turn allow for efficient distillation of targeted teacher capabilities via interpretable and controllable internal student mechanisms.