LatentEvolve: Self-Evolving Test-Time Scaling in Latent Space

作者: Guibin Zhang, Fanci Meng, Guancheng Wan, Zherui Li, Kun Wang, Zhenfei Yin, Lei Bai, Shuicheng Yan

分类: cs.CL

发布日期: 2025-09-29

💡 一句话要点

提出LatentEvolve,通过潜空间自进化测试时缩放提升LLM推理能力。

🎯 匹配领域: 支柱七:动作重定向 (Motion Retargeting) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 测试时缩放 自进化学习 互补学习系统 潜空间表示

📋 核心要点

- 现有测试时缩放方法相互独立,LLM未能有效学习如何进行缩放,限制了推理能力的进一步提升。

- LatentEvolve模拟人类大脑的认知过程,通过白天快速检索和夜间缓慢整合,实现LLM测试时缩放的自进化。

- 实验结果表明,LatentEvolve在多个基准测试中显著优于现有TTS方法,并具有良好的泛化能力。

📝 摘要(中文)

本文提出了一种名为LatentEvolve的自进化潜空间测试时缩放(TTS)框架,旨在使大型语言模型(LLM)能够逐步学习如何更有效地进行缩放,从而提升推理能力,而无需改变模型参数。LatentEvolve受到互补学习系统(CLS)理论的启发,包含两个进化组件: extit{白天缩放},快速检索历史潜在表示,以更好地指导当前的LLM推理; extit{夜间缩放},以类似于人类大脑在睡眠期间巩固经验的方式整合过去的潜在优化。白天和夜间过程的交替促进了LLM TTS的快速和缓慢进化,以完全无监督的方式反映了人类的认知动态。在八个基准测试和五个模型骨干上的大量实验表明,LatentEvolve超越了最先进的TTS方法,例如LatentSeek和TTRL,高达13.33%,并表现出卓越的跨领域和跨骨干泛化能力。

🔬 方法详解

问题定义:现有测试时缩放(TTS)方法通常是独立进行的,缺乏持续学习和进化的机制。这意味着大型语言模型(LLM)无法从过去的经验中学习如何更有效地进行缩放,从而限制了其推理能力的提升。现有方法的痛点在于缺乏一种自适应和进化的机制,使LLM能够根据不同的输入和任务动态地调整其缩放策略。

核心思路:LatentEvolve的核心思路是模拟人类大脑的互补学习系统(CLS),通过快速和缓慢两种学习机制,使LLM能够自适应地学习如何进行测试时缩放。白天缩放类似于海马体的快速回忆,用于快速检索历史潜在表示以指导当前推理;夜间缩放类似于新皮层的缓慢整合,用于整合过去的潜在优化,从而实现知识的巩固和泛化。这种设计允许LLM在推理过程中不断进化,提高缩放效率。

技术框架:LatentEvolve框架包含两个主要模块:白天缩放和夜间缩放。白天缩放模块负责在推理过程中快速检索与当前输入相关的历史潜在表示,并将其用于指导LLM的推理过程。夜间缩放模块则在推理结束后,对白天缩放过程中产生的潜在表示进行整合和优化,并将优化后的表示用于指导未来的推理过程。这两个模块交替运行,形成一个持续学习和进化的循环。

关键创新:LatentEvolve的关键创新在于引入了一种自进化的测试时缩放机制,使LLM能够根据自身的经验不断学习如何更有效地进行缩放。与现有TTS方法相比,LatentEvolve不是独立地进行缩放,而是通过模拟人类大脑的认知过程,实现了一种持续学习和进化的缩放策略。这种自进化机制使得LLM能够更好地适应不同的输入和任务,从而提高推理能力。

关键设计:LatentEvolve的关键设计包括:1) 使用潜在表示来捕捉LLM的内部状态,从而实现对LLM推理过程的细粒度控制;2) 设计了白天缩放和夜间缩放两个模块,分别负责快速检索和缓慢整合,模拟人类大脑的认知过程;3) 使用无监督学习方法来训练LatentEvolve,避免了对标注数据的依赖;4) 具体的损失函数和网络结构细节在论文中进行了详细描述,用于优化潜在表示的检索和整合过程。

🖼️ 关键图片

📊 实验亮点

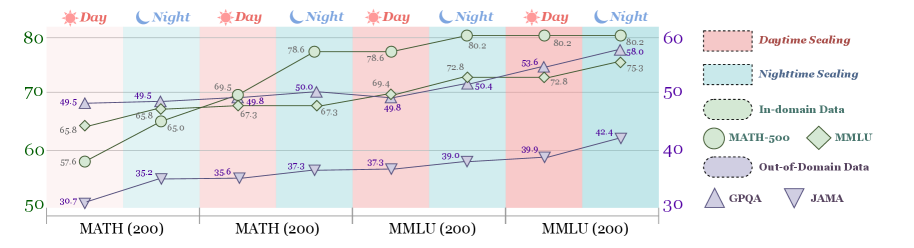

LatentEvolve在八个基准测试和五个模型骨干上进行了广泛的实验,结果表明其性能显著优于现有的最先进TTS方法,如LatentSeek和TTRL,最高提升幅度达到13.33%。此外,LatentEvolve还表现出卓越的跨领域和跨骨干泛化能力,证明了其在不同场景下的有效性和鲁棒性。

🎯 应用场景

LatentEvolve可应用于各种需要提升LLM推理能力的场景,例如问答系统、文本摘要、机器翻译等。通过自进化测试时缩放,LLM能够更好地适应不同的任务和领域,提高推理的准确性和效率。该研究对于推动LLM在实际应用中的发展具有重要意义,并为未来的LLM研究提供了新的思路。

📄 摘要(原文)

Test-time Scaling (TTS) has been demonstrated to significantly enhance the reasoning capabilities of Large Language Models (LLMs) during the inference phase without altering model parameters. However, existing TTS methods are largely independent, implying that LLMs have not yet evolved to progressively learn how to scale more effectively. With the objective of evolving LLMs to learn ``how to scale test-time computation,'' we propose LatentEvolve, a self-evolving latent TTS framework inspired by the complementary learning system (CLS) theory. Analogous to the human brain's dual system of a fast-recall hippocampus and a slow-consolidating neocortex, LatentEvolve comprises two evolutionary components: \textit{daytime scaling}, which rapidly retrieves historical latent representations to better guide current LLM reasoning; and \textit{nighttime scaling}, which integrates past latent optimizations in a manner akin to the human brain's consolidation of experiences during sleep. The alternation of daytime and nighttime processes facilitates a fast and slow evolution of LLM TTS, mirroring human cognitive dynamics in a fully unsupervised manner. Extensive experiments across eight benchmarks and five model backbones demonstrate that our LatentEvolve surpasses state-of-the-art TTS methods such as LatentSeek and TTRL by up to $13.33\%$ and exhibits exceptional cross-domain and cross-backbone generalization.