CDT: A Comprehensive Capability Framework for Large Language Models Across Cognition, Domain, and Task

作者: Haosi Mo, Xinyu Ma, Xuebo Liu, Derek F. Wong, Yu Li, Jie Liu, Min Zhang

分类: cs.CL

发布日期: 2025-09-29

备注: 20 pages, 5 figures, EMNLP2025 Findings

🔗 代码/项目: GITHUB

💡 一句话要点

提出CDT框架,从认知、领域和任务三维度全面评估大语言模型能力。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型评估 认知能力 领域知识 任务执行 数据集构建

📋 核心要点

- 现有LLM评估基准侧重孤立能力,缺乏全面性,难以反映模型的整体认知水平。

- CDT框架从认知、领域、任务三个维度评估LLM,借鉴认知理论细化能力分类。

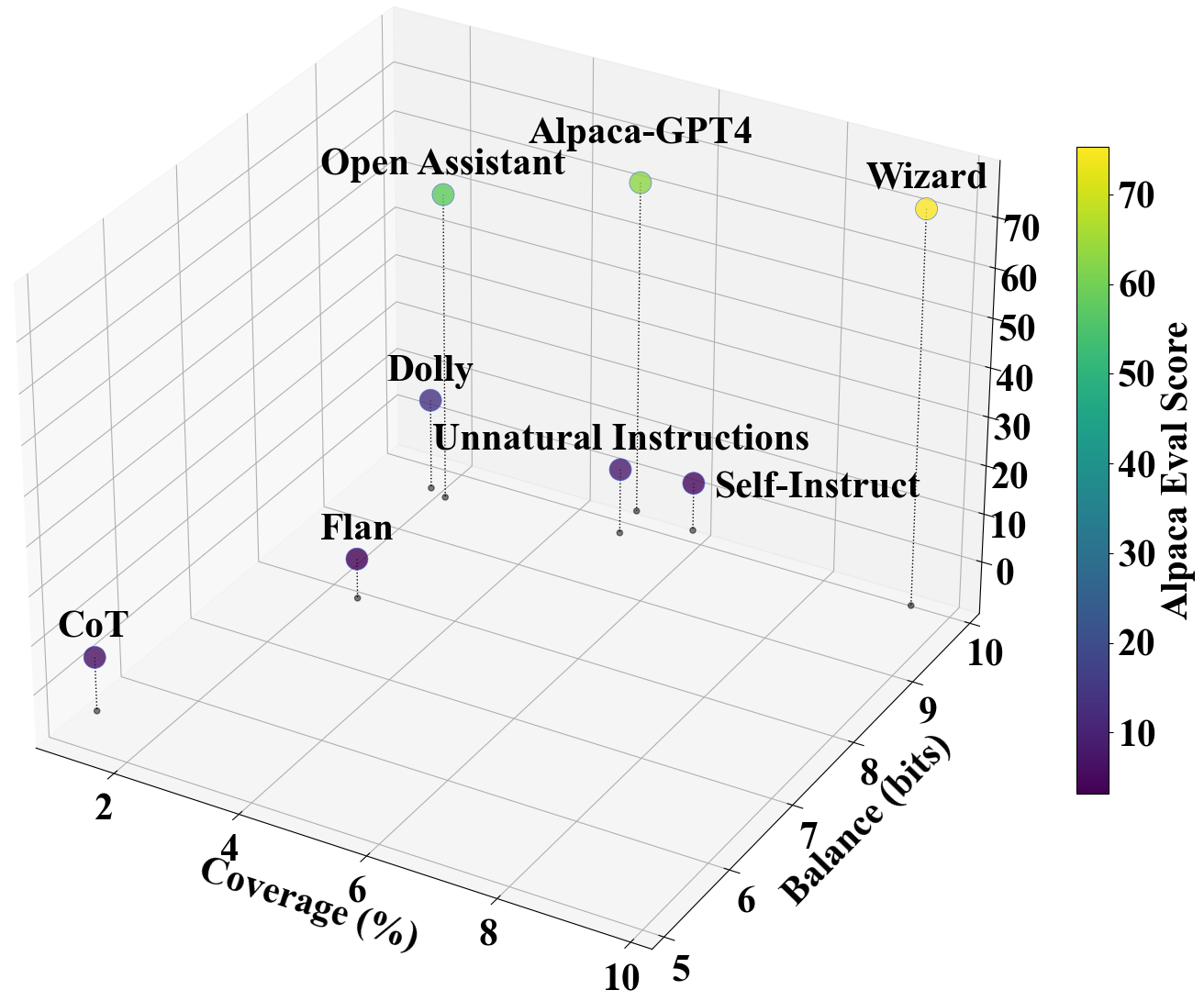

- 实验表明CDT指标与下游性能相关,可用于数据集分析和数据选择,提升模型性能。

📝 摘要(中文)

大语言模型(LLM)的最新进展显著增强了它们的能力,因此需要超越特定任务基准的全面评估框架。然而,现有的基准通常侧重于孤立的能力,缺乏评估LLM能力的整体框架。为了解决这一差距,我们提出了认知-领域-任务(CDT)框架,该框架全面衡量模型在三个维度上的能力。我们通过结合卡特尔-霍恩-卡罗尔认知理论,扩展了认知层面的模型能力定义范围,细化了模型能力的分类。我们将CDT应用于两个方向:数据集能力评估和数据选择。实验表明,我们的能力指标与下游性能良好相关,可以支持有效的数据集分析和构建。数据选择实验也显示出在通用和特定基准上的显著改进,分别达到44.3和45.4的分数,比基线分别提高了1.6和2.2分。这些结果验证了CDT的有效性和实用性。

🔬 方法详解

问题定义:现有的大语言模型评估方法通常侧重于特定任务的性能指标,缺乏对模型内在认知能力的全面评估。这些方法难以反映模型在不同领域和任务上的泛化能力,也无法指导数据集的构建和选择。因此,需要一种更全面的评估框架,能够从认知层面理解和衡量模型的能力。

核心思路:CDT框架的核心思路是将大语言模型的能力分解为认知、领域和任务三个维度。认知维度关注模型的基本认知能力,如推理、记忆和理解;领域维度关注模型在特定领域的知识掌握程度;任务维度关注模型完成特定任务的能力。通过综合评估这三个维度,可以更全面地了解模型的能力。

技术框架:CDT框架包含三个主要模块:认知能力评估模块、领域知识评估模块和任务执行能力评估模块。认知能力评估模块基于卡特尔-霍恩-卡罗尔认知理论,将认知能力细分为多个子能力,并设计相应的评估指标。领域知识评估模块通过测试模型在特定领域的知识掌握程度来评估其领域能力。任务执行能力评估模块则通过在各种任务上测试模型的性能来评估其任务能力。整体流程是先分别评估三个维度的能力,然后综合分析评估结果。

关键创新:CDT框架的关键创新在于其全面性和系统性。它不仅考虑了模型在特定任务上的性能,还关注模型的认知能力和领域知识,从而更全面地评估模型的能力。此外,CDT框架还提供了一种系统的方法来分析和构建数据集,从而可以更好地利用数据来提升模型性能。

关键设计:CDT框架的关键设计包括:1) 基于卡特尔-霍恩-卡罗尔认知理论的认知能力分类体系;2) 用于评估不同认知能力的评估指标;3) 用于评估领域知识的领域知识库;4) 用于评估任务执行能力的各种任务数据集。框架的具体实现依赖于这些组件的选择和配置,例如,认知能力评估指标的选择需要根据具体的认知能力进行调整。

🖼️ 关键图片

📊 实验亮点

实验结果表明,CDT框架能够有效评估大语言模型的能力,并且与下游任务的性能具有良好的相关性。通过使用CDT框架进行数据选择,模型在通用基准和特定基准上的性能分别提高了1.6和2.2个百分点,达到了44.3和45.4的分数。这些结果验证了CDT框架的有效性和实用性。

🎯 应用场景

CDT框架可应用于大语言模型的选型、优化和安全评估。开发者可以使用CDT框架来选择最适合特定应用场景的模型,并通过分析评估结果来优化模型结构和训练策略。此外,CDT框架还可以用于评估模型的安全性和可靠性,例如,检测模型是否存在认知偏差或容易受到对抗攻击。

📄 摘要(原文)

Recent advances in Large Language Models (LLMs) have significantly enhanced their capabilities, highlighting the need for comprehensive evaluation frameworks that extend beyond task-specific benchmarks. However, existing benchmarks often focus on isolated abilities, lacking a holistic framework for assessing LLM capabilities. To address this gap, we propose the Cognition-Domain-Task (CDT) framework, which comprehensively measures a model's capabilities across three dimensions. We expand the scope of model capability definitions at the cognitive level by incorporating the Cattell-Horn-Carroll cognitive theory, refining the categorization of model capabilities. We apply CDT in two directions: dataset capability evaluation and data selection. Experiments show that our capability metrics correlate well with downstream performance and can support effective dataset analysis and construction. The experiments on data selection also show significant improvements in both general and specific benchmarks, achieving scores of 44.3 and 45.4, with an increase of 1.6 and 2.2 points over the baselines, respectively. These results validate the effectiveness and practicality of CDT. Source code and models are available at https://github.com/Alessa-mo/CDT.