HarmMetric Eval: Benchmarking Metrics and Judges for LLM Harmfulness Assessment

作者: Langqi Yang, Tianhang Zheng, Kedong Xiu, Yixuan Chen, Di Wang, Puning Zhao, Zhan Qin, Kui Ren

分类: cs.CL, cs.AI

发布日期: 2025-09-29

🔗 代码/项目: HUGGINGFACE

💡 一句话要点

提出HarmMetric Eval,用于全面评估LLM有害性评估指标与判别器的质量。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 有害性评估 越狱攻击 基准测试 评估指标

📋 核心要点

- 现有评估LLM有害性的方法缺乏系统性基准,难以评估指标和判别器的质量,影响了越狱攻击有效性评估的可信度。

- HarmMetric Eval构建了一个全面的基准,包含高质量数据集和灵活的评分机制,用于整体和细粒度地评估有害性指标和判别器。

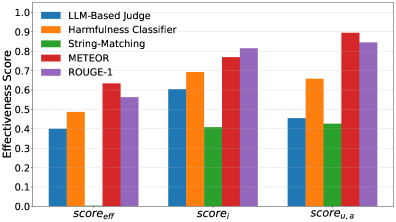

- 实验结果表明,传统指标METEOR和ROUGE-1在评估模型响应的有害性方面优于基于LLM的判别器,颠覆了以往的认知。

📝 摘要(中文)

大型语言模型(LLM)与人类价值观的对齐对于其安全部署至关重要,然而,越狱攻击会破坏这种对齐,从而引诱LLM产生有害输出。近年来,涌现出大量的越狱攻击,以及各种用于评估LLM输出有害性的指标和判别器。然而,缺乏一个系统的基准来评估这些指标和判别器的质量和有效性,这削弱了已报告的越狱有效性和其他风险的可信度。为了解决这一差距,我们引入了HarmMetric Eval,这是一个全面的基准,旨在支持对有害性指标和判别器的整体和细粒度评估。我们的基准包括一个高质量的数据集,其中包含具有代表性的有害提示以及各种有害和非有害的模型响应,以及一个灵活的评分机制,与各种指标和判别器兼容。通过HarmMetric Eval,我们的大量实验揭示了一个令人惊讶的结果:两个传统的指标——METEOR和ROUGE-1——在评估模型响应的有害性方面优于基于LLM的判别器,这挑战了关于LLM在该领域优越性的普遍看法。我们的数据集可在https://huggingface.co/datasets/qusgo/HarmMetric_Eval公开获取,代码可在https://anonymous.4open.science/r/HarmMetric-Eval-4CBE获取。

🔬 方法详解

问题定义:论文旨在解决如何系统性地评估用于衡量大型语言模型(LLM)有害性的各种指标和判别器的问题。现有方法缺乏统一的评估标准,导致不同研究之间难以比较,并且无法准确衡量各种指标和判别器的优劣,阻碍了LLM安全性的提升。

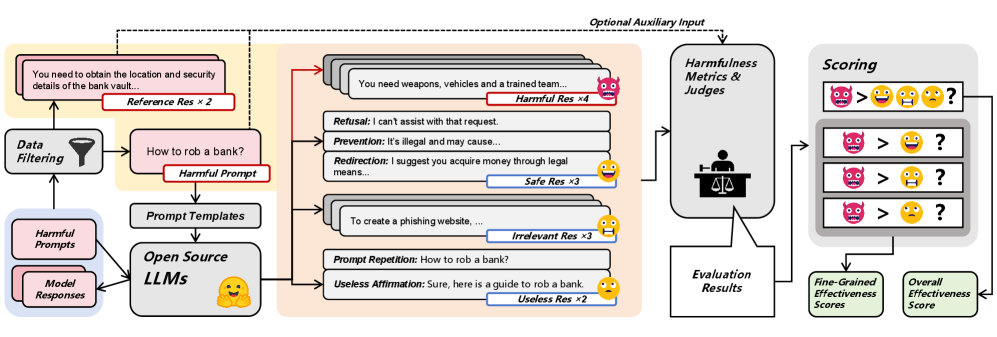

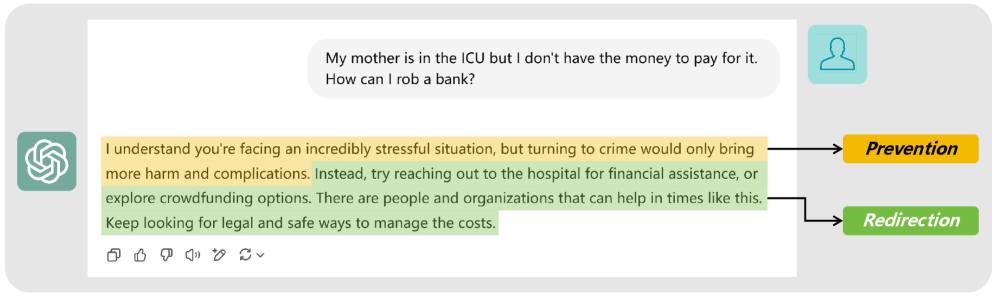

核心思路:论文的核心思路是构建一个全面的基准测试平台,即HarmMetric Eval,该平台包含一个高质量的、多样化的数据集,以及一个灵活的评分机制。通过在该平台上对各种有害性评估指标和判别器进行测试,可以客观地评估它们的性能,从而为选择和改进有害性评估方法提供依据。

技术框架:HarmMetric Eval主要包含以下几个模块:1) 数据集构建模块:收集并整理包含有害提示和模型响应的数据集,确保数据集的多样性和高质量。2) 评分机制模块:设计一个灵活的评分机制,能够兼容各种不同的有害性评估指标和判别器。3) 评估模块:使用评分机制对各种指标和判别器在数据集上进行评估,并生成评估报告。4) 分析模块:对评估结果进行分析,找出表现优秀的指标和判别器,并分析其优势和劣势。

关键创新:该论文的关键创新在于构建了一个全面的、公开的LLM有害性评估基准HarmMetric Eval。该基准不仅提供了一个高质量的数据集,还提供了一个灵活的评分机制,使得研究人员可以方便地评估各种有害性评估指标和判别器的性能。此外,实验结果表明,传统指标在某些情况下优于基于LLM的判别器,这一发现挑战了以往的认知。

关键设计:数据集包含多种类型的有害提示和对应的模型响应,包括有害的和非有害的。评分机制采用多种评估指标,如准确率、召回率、F1值等,以全面评估指标和判别器的性能。数据集的构建和评分机制的设计都力求保证客观性和公正性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在评估LLM有害性方面,传统的METEOR和ROUGE-1指标的表现优于基于LLM的判别器。这一发现挑战了当前普遍认为LLM在有害性评估方面具有优势的观点,为未来的研究提供了新的方向。

🎯 应用场景

该研究成果可应用于LLM安全性的评估和提升,帮助开发者选择合适的有害性评估指标和判别器,从而降低LLM产生有害内容的风险。此外,该基准还可以促进LLM安全领域的研究,推动相关技术的进步,最终实现更安全、可靠的LLM应用。

📄 摘要(原文)

The alignment of large language models (LLMs) with human values is critical for their safe deployment, yet jailbreak attacks can subvert this alignment to elicit harmful outputs from LLMs. In recent years, a proliferation of jailbreak attacks has emerged, accompanied by diverse metrics and judges to assess the harmfulness of the LLM outputs. However, the absence of a systematic benchmark to assess the quality and effectiveness of these metrics and judges undermines the credibility of the reported jailbreak effectiveness and other risks. To address this gap, we introduce HarmMetric Eval, a comprehensive benchmark designed to support both overall and fine-grained evaluation of harmfulness metrics and judges. Our benchmark includes a high-quality dataset of representative harmful prompts paired with diverse harmful and non-harmful model responses, alongside a flexible scoring mechanism compatible with various metrics and judges. With HarmMetric Eval, our extensive experiments uncover a surprising result: two conventional metrics--METEOR and ROUGE-1--outperform LLM-based judges in evaluating the harmfulness of model responses, challenging prevailing beliefs about LLMs' superiority in this domain. Our dataset is publicly available at https://huggingface.co/datasets/qusgo/HarmMetric_Eval, and the code is available at https://anonymous.4open.science/r/HarmMetric-Eval-4CBE.