MAS$^2$: Self-Generative, Self-Configuring, Self-Rectifying Multi-Agent Systems

作者: Kun Wang, Guibin Zhang, ManKit Ye, Xinyu Deng, Dongxia Wang, Xiaobin Hu, Jinyang Guo, Yang Liu, Yufei Guo

分类: cs.MA, cs.CL

发布日期: 2025-09-29

🔗 代码/项目: GITHUB

💡 一句话要点

提出MAS$^2$,一种自生成、自配置、自校正的多智能体系统,提升复杂任务性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多智能体系统 自生成 自配置 自校正 大语言模型 协同树优化 智能体架构

📋 核心要点

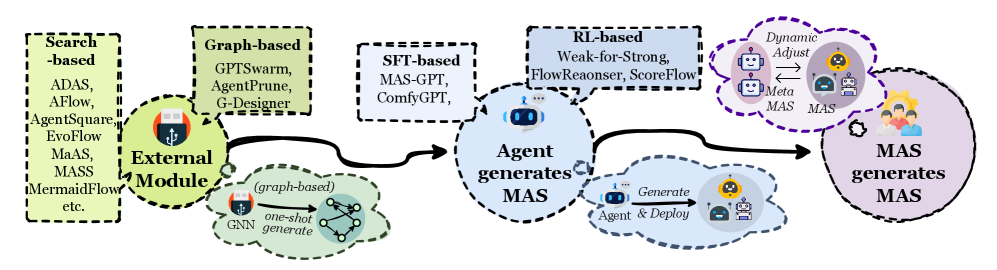

- 现有自动多智能体系统遵循“一次生成并部署”的模式,难以适应现实世界环境的动态性和不确定性。

- MAS$^2$通过递归自生成,利用“生成器-执行器-校正器”三智能体团队动态构建和调整目标智能体系统。

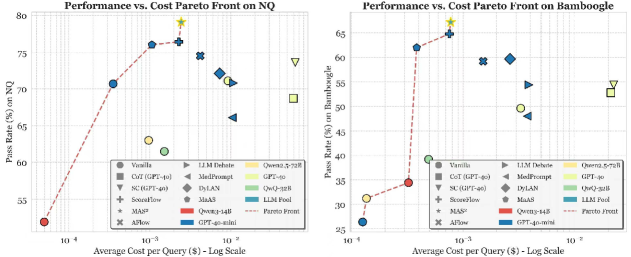

- 实验表明,MAS$^2$在复杂任务中性能提升显著,且具有良好的跨模型泛化能力,同时控制了token成本。

📝 摘要(中文)

本文提出MAS$^2$,一种基于递归自生成原则的多智能体系统范式,能够自主地为不同的问题构建定制化的多智能体系统。该系统包含一个“生成器-执行器-校正器”三智能体团队,能够动态地组合和自适应地校正目标智能体系统,以响应实时的任务需求。论文提出了协同树优化方法来训练和专门化这些元智能体。在七个基准测试上的广泛评估表明,MAS$^2$在深度研究和代码生成等复杂场景中,相比最先进的多智能体系统,性能提升高达19.6%。此外,MAS$^2$表现出卓越的跨骨干泛化能力,有效地利用先前未见过的LLM,产生了高达15.1%的改进。重要的是,这些收益是在没有产生过多token成本的情况下获得的,因为MAS$^2$始终位于成本-性能权衡的帕累托前沿。代码已开源。

🔬 方法详解

问题定义:现有的大语言模型驱动的多智能体系统通常采用“一次生成并部署”的模式,即预先定义好智能体的角色、工具、提示词和通信协议,然后直接部署执行。这种静态的系统难以适应真实世界中复杂多变的任务环境,缺乏灵活性和鲁棒性。当任务需求发生变化或遇到未知的挑战时,系统难以自我调整和优化,导致性能下降甚至失效。

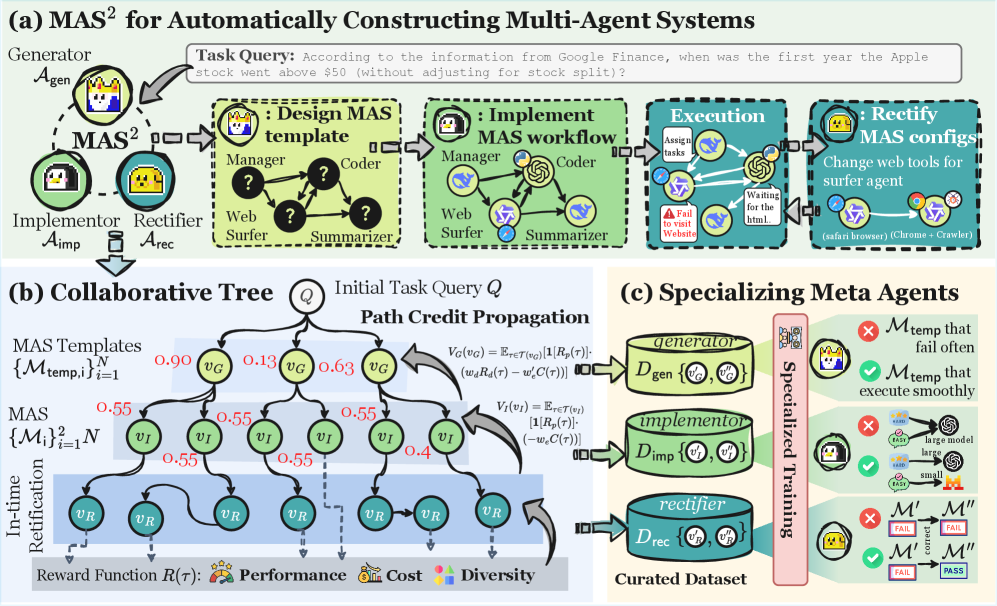

核心思路:MAS$^2$的核心思路是引入递归自生成的概念,让多智能体系统具备自主构建和调整自身结构的能力。具体来说,MAS$^2$不是预先定义好一个固定的多智能体系统,而是通过一个元智能体系统(即“生成器-执行器-校正器”团队)来动态地生成和优化目标智能体系统。这种方式使得系统能够根据任务需求和环境变化,自适应地调整智能体的角色、工具和通信方式,从而更好地完成任务。

技术框架:MAS$^2$的技术框架主要包含三个部分:生成器(Generator)、执行器(Implementer)和校正器(Rectifier)。生成器负责根据任务需求生成目标智能体系统的初始配置,包括智能体的数量、角色、工具和通信协议等。执行器负责将生成器生成的配置部署到实际环境中,并执行相应的任务。校正器负责监控执行器的表现,并根据任务反馈和环境变化,对目标智能体系统进行调整和优化。这三个智能体组成一个闭环反馈系统,不断地迭代优化目标智能体系统的性能。

关键创新:MAS$^2$最重要的技术创新点在于其递归自生成的范式。与传统的静态多智能体系统相比,MAS$^2$能够根据任务需求和环境变化,动态地构建和调整自身结构,从而更好地适应复杂多变的任务环境。此外,论文提出的协同树优化方法能够有效地训练和专门化元智能体,使其能够更好地完成生成、执行和校正的任务。

关键设计:论文提出了协同树优化(Collaborative Tree Optimization)方法来训练元智能体。具体来说,论文将生成器、执行器和校正器视为一个整体,通过优化一个共享的奖励函数来协同训练它们。此外,论文还设计了一系列的提示词和约束条件,以引导元智能体生成高质量的目标智能体系统配置。在实验中,论文采用了不同的LLM作为元智能体的骨干模型,并探索了不同的训练策略和超参数设置。

🖼️ 关键图片

📊 实验亮点

实验结果表明,MAS$^2$在七个基准测试上均取得了显著的性能提升。在深度研究和代码生成等复杂场景中,MAS$^2$相比最先进的多智能体系统,性能提升高达19.6%。此外,MAS$^2$还表现出卓越的跨骨干泛化能力,能够有效地利用先前未见过的LLM,产生高达15.1%的改进。重要的是,这些性能提升是在没有显著增加token成本的情况下实现的,MAS$^2$始终位于成本-性能权衡的帕累托前沿。

🎯 应用场景

MAS$^2$具有广泛的应用前景,例如在科研探索、代码生成、智能客服、自动化运维等领域。它可以应用于需要高度灵活性和适应性的复杂任务,例如自动化的科学研究流程设计、根据用户需求动态生成代码、以及在复杂网络环境中进行故障诊断和修复。通过自主构建和优化多智能体系统,MAS$^2$能够显著提高任务完成效率和质量。

📄 摘要(原文)

The past two years have witnessed the meteoric rise of Large Language Model (LLM)-powered multi-agent systems (MAS), which harness collective intelligence and exhibit a remarkable trajectory toward self-evolution. This paradigm has rapidly progressed from manually engineered systems that require bespoke configuration of prompts, tools, roles, and communication protocols toward frameworks capable of automated orchestration. Yet, dominant automatic multi-agent systems, whether generated by external modules or a single LLM agent, largely adhere to a rigid

\textit{generate-once-and-deploy}'' paradigm, rendering the resulting systems brittle and ill-prepared for the dynamism and uncertainty of real-world environments. To transcend this limitation, we introduce MAS$^2$, a paradigm predicated on the principle of recursive self-generation: a multi-agent system that autonomously architects bespoke multi-agent systems for diverse problems. Technically, we devise a\textit{generator-implementer-rectifier}'' tri-agent team capable of dynamically composing and adaptively rectifying a target agent system in response to real-time task demands. Collaborative Tree Optimization is proposed to train and specialize these meta-agents. Extensive evaluation across seven benchmarks reveals that MAS$^2$ achieves performance gains of up to $19.6\%$ over state-of-the-art MAS in complex scenarios such as deep research and code generation. Moreover, MAS$^2$ exhibits superior cross-backbone generalization, effectively leveraging previously unseen LLMs to yield improvements of up to $15.1\%$. Crucially, these gains are attained without incurring excessive token costs, as MAS$^2$ consistently resides on the Pareto frontier of cost-performance trade-offs. The source codes are available at https://github.com/yeyeyeah2/MAS2.