Pragmatic Inference for Moral Reasoning Acquisition: Generalization via Distributional Semantics

作者: Guangliang Liu, Xi Chen, Bocheng Chen, Han Zi, Xitong Zhang, Kristen Johnson

分类: cs.CL

发布日期: 2025-09-28 (更新: 2026-01-13)

💡 一句话要点

提出基于语用推理的道德推理获取方法,提升LLM的道德推理泛化能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 道德推理 大型语言模型 语用推理 道德基础理论 泛化能力

📋 核心要点

- 大型语言模型在道德推理方面面临泛化难题,因为它们主要依赖于分布语义,而道德判断更多依赖于语用层面的理解。

- 论文提出基于道德基础理论的语用推理方法,通过利用上下文信息弥合语用差距,引导LLM将道德基础与推理目标关联。

- 实验结果表明,该方法显著提升了LLM在道德推理中的泛化能力,为后续研究奠定了基础。

📝 摘要(中文)

道德推理已成为大型语言模型(LLMs)一个很有前景的研究方向,但实现泛化仍然是一个核心挑战。从语言学的角度来看,这种困难的出现是因为LLMs擅长捕捉分布语义,而分布语义从根本上不同于在语用层面运作的道德。本文研究了LLMs如何在依赖分布语义的情况下实现广义的道德推理。我们提出了基于道德基础理论的语用推理方法,该方法利用每个步骤的上下文信息来弥合语用差距,并指导LLMs将道德基础与道德推理目标联系起来。实验结果表明,我们的方法显著提高了LLMs在道德推理中的泛化能力,为未来基于道德基础理论的研究奠定了基础。

🔬 方法详解

问题定义:当前大型语言模型在道德推理方面表现出一定的能力,但泛化性不足。它们擅长捕捉文本的分布语义,却难以理解道德判断中涉及的语用信息,导致在面对新的情境时,无法准确进行道德推理。现有方法难以有效弥合分布语义和语用信息之间的差距。

核心思路:论文的核心思路是利用语用推理来增强LLM的道德推理能力。具体而言,通过在推理过程中引入上下文信息,并结合道德基础理论,引导LLM理解道德判断的语用含义,从而更好地将道德原则应用于新的情境。这种方法旨在弥合LLM依赖的分布语义与道德判断所需的语用理解之间的差距。

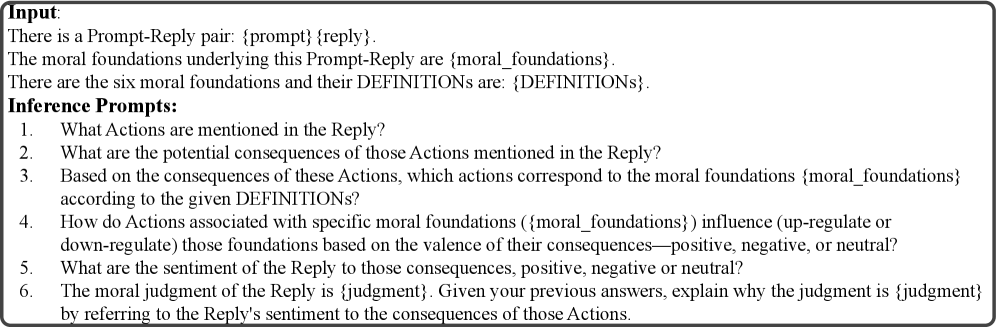

技术框架:该方法基于道德基础理论,构建了一个语用推理框架。该框架包含以下主要步骤:1) 输入道德推理问题;2) 利用上下文信息提取相关道德基础;3) 基于提取的道德基础进行语用推理,生成道德判断;4) 使用生成的道德判断来指导LLM进行道德推理。整个框架旨在通过显式地建模语用信息,来提升LLM的道德推理能力。

关键创新:该论文的关键创新在于将语用推理与道德基础理论相结合,提出了一种新的道德推理方法。与以往主要依赖分布语义的方法不同,该方法显式地考虑了语用信息,并利用道德基础理论来指导推理过程。这种方法能够更好地理解道德判断的语用含义,从而提升LLM在道德推理中的泛化能力。

关键设计:论文的关键设计包括:1) 如何从上下文中提取相关的道德基础;2) 如何利用提取的道德基础进行语用推理;3) 如何将语用推理的结果融入到LLM的道德推理过程中。具体的参数设置、损失函数和网络结构等技术细节在论文中未详细描述,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法显著提升了LLM在道德推理中的泛化能力。具体的性能数据、对比基线和提升幅度在摘要中未给出,属于未知信息。但摘要强调了该方法在提升LLM道德推理泛化能力方面的积极作用。

🎯 应用场景

该研究成果可应用于开发更具道德意识和责任感的人工智能系统。例如,可以用于构建能够进行道德决策的自动驾驶汽车、能够进行公正评估的招聘系统,以及能够提供符合伦理建议的智能助手。该研究还有助于提升LLM在其他需要语用理解的任务中的表现,例如对话生成和文本摘要。

📄 摘要(原文)

Moral reasoning has emerged as a promising research direction for Large Language Models (LLMs), yet achieving generalization remains a central challenge. From a linguistic standpoint, this difficulty arises because LLMs are adept at capturing distributional semantics, which fundamentally differs from the morals which operate at the pragmatic level. This paper investigates how LLMs can achieve generalized moral reasoning despite their reliance on distributional semantics. We propose pragmatic inference methods grounded in moral foundations theory, which leverage contextual information at each step to bridge the pragmatic gap and guide LLMs in connecting moral foundations with moral reasoning objectives. Experimental results demonstrate that our approach significantly enhances LLMs' generalization in moral reasoning, providing a foundation for future research grounded in moral foundations theory.