Small Language Models for Curriculum-based Guidance

作者: Konstantinos Katharakis, Sippo Rossi, Raghava Rao Mukkamala

分类: cs.CL, cs.AI

发布日期: 2025-09-27

💡 一句话要点

利用小型语言模型和课程指导,构建可持续的AI教学助手

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 小型语言模型 检索增强生成 AI教学助手 个性化学习 可持续AI 教育技术 课程指导

📋 核心要点

- 大型语言模型在教育领域的应用面临高昂的计算成本和对云基础设施的依赖。

- 论文提出利用小型语言模型(SLM)结合检索增强生成(RAG)技术,构建AI教学助手。

- 实验表明,经过适当提示和检索,SLM在教学指导方面可以媲美大型语言模型,且更具可持续性。

📝 摘要(中文)

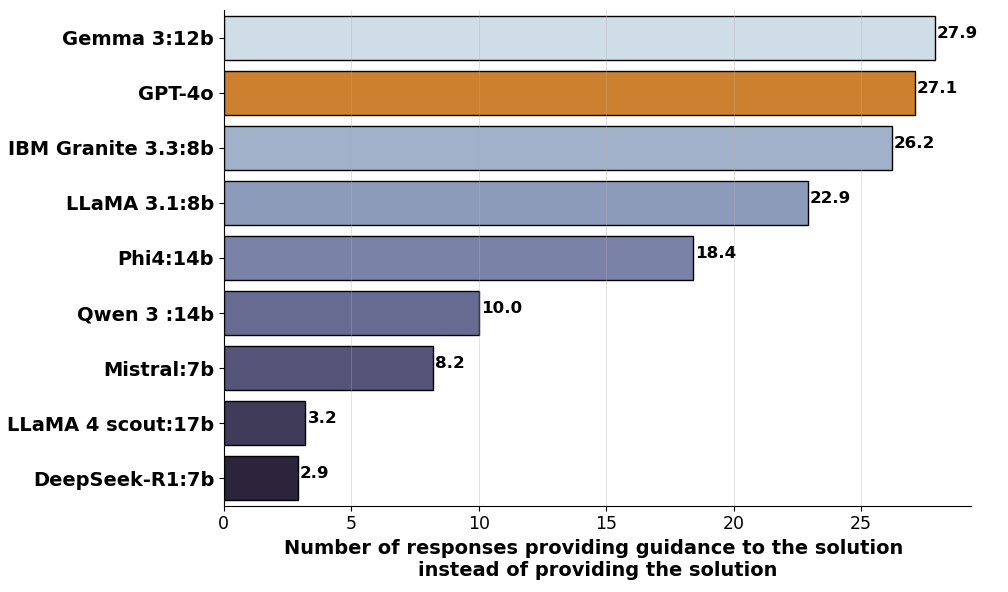

本研究探索了AI教学助手的开发与评估,该助手利用检索增强生成(RAG)流程,并应用于选定的开源小型语言模型(SLM),以提供基于课程的指导。我们对包括LLaMA 3.1、IBM Granite 3.3和Gemma 3(7-17B参数)在内的八个SLM进行了基准测试,并与GPT-4o进行了比较。研究结果表明,通过适当的提示和有针对性的检索,SLM在提供准确且符合教学法的响应方面可以与LLM相媲美。重要的是,SLM由于其较低的计算和能源需求,提供了显著的可持续性优势,从而可以在消费级硬件上实时使用,而无需依赖云基础设施。这不仅使其具有成本效益和隐私保护性,而且对环境负责,使其成为教育机构旨在以可持续和节能的方式扩展个性化学习的可行AI教学助手。

🔬 方法详解

问题定义:现有大型语言模型(LLM)在教育领域的应用受限于其高昂的计算成本和对云基础设施的依赖,这使得个性化学习难以大规模推广,并且存在隐私和可持续性问题。因此,需要一种更经济、环保且保护隐私的解决方案来支持教育领域的AI应用。

核心思路:论文的核心思路是利用小型语言模型(SLM)结合检索增强生成(RAG)技术,构建AI教学助手。通过RAG,SLM可以访问外部知识库,从而弥补自身知识的不足,提高回答的准确性和相关性。这种方法旨在在性能、成本和可持续性之间取得平衡。

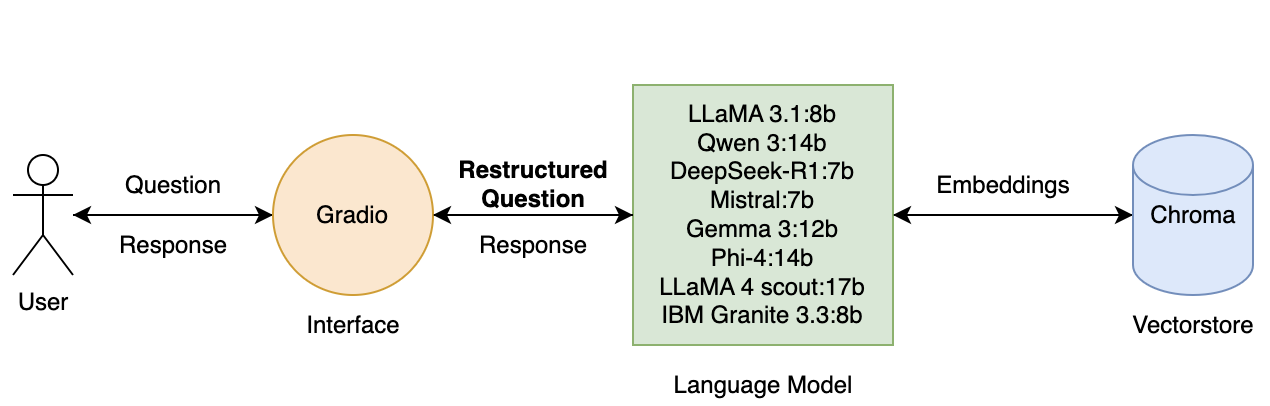

技术框架:该研究采用检索增强生成(RAG)的pipeline。首先,用户提出问题;然后,检索模块从课程相关的知识库中检索相关信息;最后,小型语言模型(SLM)利用检索到的信息生成答案。整个流程旨在提供准确、个性化且符合教学法的指导。研究中使用了多个开源SLM进行评估。

关键创新:该研究的关键创新在于证明了小型语言模型(SLM)在教育领域的潜力。通过RAG技术的加持,SLM可以在特定领域内达到与大型语言模型相媲美的性能,同时显著降低了计算成本和能源消耗。这为教育机构提供了一种更可持续、经济且保护隐私的AI解决方案。

关键设计:论文中关键的设计包括:对SLM的Prompt工程,确保模型能够理解并有效地利用检索到的信息;知识库的构建,确保检索模块能够找到相关且准确的信息;以及对不同SLM的基准测试,以确定最适合特定教育场景的模型。具体的参数设置、损失函数和网络结构等技术细节在论文中可能未详细描述,属于模型本身的固有属性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,经过适当的提示和检索增强,小型语言模型(如LLaMA 3.1、IBM Granite 3.3和Gemma 3)在提供准确且符合教学法的响应方面可以与GPT-4o相媲美。同时,SLM显著降低了计算和能源需求,可以在消费级硬件上实时运行,无需依赖昂贵的云基础设施。

🎯 应用场景

该研究成果可应用于构建个性化学习平台、智能辅导系统和在线教育资源。通过部署在本地设备上,AI教学助手可以为学生提供即时、定制化的学习指导,同时保护学生隐私并降低运营成本。该技术还有潜力应用于企业培训、技能提升等领域,实现更高效、可持续的学习体验。

📄 摘要(原文)

The adoption of generative AI and large language models (LLMs) in education is still emerging. In this study, we explore the development and evaluation of AI teaching assistants that provide curriculum-based guidance using a retrieval-augmented generation (RAG) pipeline applied to selected open-source small language models (SLMs). We benchmarked eight SLMs, including LLaMA 3.1, IBM Granite 3.3, and Gemma 3 (7-17B parameters), against GPT-4o. Our findings show that with proper prompting and targeted retrieval, SLMs can match LLMs in delivering accurate, pedagogically aligned responses. Importantly, SLMs offer significant sustainability benefits due to their lower computational and energy requirements, enabling real-time use on consumer-grade hardware without depending on cloud infrastructure. This makes them not only cost-effective and privacy-preserving but also environmentally responsible, positioning them as viable AI teaching assistants for educational institutions aiming to scale personalized learning in a sustainable and energy-efficient manner.