Train Once, Answer All: Many Pretraining Experiments for the Cost of One

作者: Sebastian Bordt, Martin Pawelczyk

分类: cs.CL, cs.AI, cs.LG

发布日期: 2025-09-27

💡 一句话要点

提出单次训练多重实验方法,降低大语言模型预训练实验成本。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 预训练 大型语言模型 多任务学习 数据污染 模型投毒

📋 核心要点

- 大型语言模型预训练成本高昂,限制了对其学习机制的深入研究。

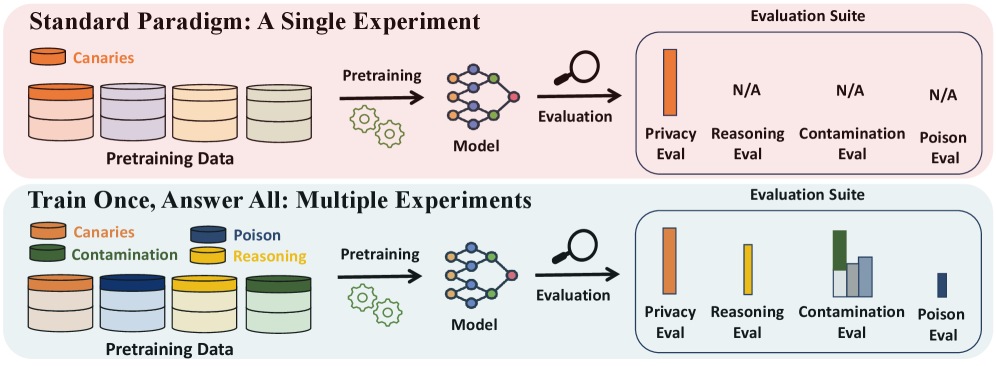

- 提出一种单次训练多重实验的方法,显著降低预训练实验的计算成本。

- 通过单次训练,成功复现并扩展了多个现有研究,验证了方法的可行性。

📝 摘要(中文)

近期的研究表明,可控的预训练实验是理解大型语言模型(LLM)的学习、推理和记忆能力的强大工具。然而,预训练的计算成本是一个重要的制约因素。为了克服这一限制,我们提出在单次训练运行中同时进行多个预训练实验。我们通过在210B tokens上训练一个15亿参数的模型,进行了十个实验,证明了这种方法的可行性。虽然我们只训练了一个模型,但我们可以复现之前多项关于数据污染、投毒和记忆的研究结果。我们还对知识获取、数学推理和水印技术进行了新的研究。例如,我们动态更新训练数据,直到模型获得特定的知识。值得注意的是,这十个实验对模型的训练动态和整体性能的影响很小。然而,不同实验之间的相互作用可能成为我们方法中的潜在混淆因素。我们建议通过持续的预训练实验来测试相互作用,发现它们在我们的设置中可以忽略不计。总的来说,我们的发现表明,在单个训练运行中执行多个预训练实验可以在计算预算内对大型模型进行严格的科学实验。

🔬 方法详解

问题定义:现有的大型语言模型研究,特别是关于其学习、推理和记忆能力的研究,依赖于大量的预训练实验。然而,每次预训练都需要巨大的计算资源,这使得研究成本高昂,阻碍了更广泛的探索。因此,如何降低预训练实验的成本,成为了一个亟待解决的问题。

核心思路:论文的核心思路是在单次模型训练过程中,同时进行多个不同的预训练实验。通过巧妙地设计训练数据和目标,使得单个模型在训练过程中能够并行地学习到多个实验所需要的信息,从而避免了多次独立训练的开销。

技术框架:该方法的核心在于设计一个能够同时支持多个实验的训练流程。具体来说,在每个训练步骤中,模型接收到的数据是多个实验数据的混合。每个实验的数据都经过特定的处理,以确保模型能够区分并学习到每个实验所需要的信息。此外,论文还提出了一种测试实验间相互作用的方法,以确保不同实验之间不会产生显著的干扰。

关键创新:该方法最重要的创新点在于其能够显著降低预训练实验的计算成本。通过单次训练,研究人员可以同时进行多个实验,从而大大提高了研究效率。此外,该方法还为研究大型语言模型的学习机制提供了一种新的思路,即通过并行实验来更全面地了解模型的行为。

关键设计:论文中一个关键的设计是动态更新训练数据,以使模型获得特定的知识。例如,为了研究模型如何学习数学知识,研究人员可以动态地向训练数据中添加数学题目,直到模型能够正确地解答这些题目。此外,论文还使用了多种技术来减少实验间的相互作用,例如使用不同的数据分布和目标函数。

🖼️ 关键图片

📊 实验亮点

论文通过单次训练一个15亿参数的模型,成功复现了多个关于数据污染、投毒和记忆的现有研究结果。此外,论文还对知识获取、数学推理和水印技术进行了新的研究,并发现这十个实验对模型的训练动态和整体性能的影响很小。实验结果表明,该方法能够有效地降低预训练实验的成本,并为研究大型语言模型的学习机制提供了一种新的途径。

🎯 应用场景

该研究成果可广泛应用于大型语言模型的科学研究,例如数据污染分析、模型投毒防御、知识获取机制研究、数学推理能力提升以及数字水印技术开发。通过降低预训练实验的成本,该方法能够加速相关领域的研究进展,并促进更安全、可靠和智能的语言模型的发展。

📄 摘要(原文)

Recent work has demonstrated that controlled pretraining experiments are a powerful tool for understanding learning, reasoning, and memorization in large language models (LLMs). However, the computational cost of pretraining presents a significant constraint. To overcome this constraint, we propose to conduct multiple pretraining experiments simultaneously during a single training run. We demonstrate the feasibility of this approach by conducting ten experiments during the training of a 1.5B parameter model on 210B tokens. Although we only train a single model, we can replicate the results from multiple previous works on data contamination, poisoning, and memorization. We also conduct novel investigations into knowledge acquisition, mathematical reasoning, and watermarking. For example, we dynamically update the training data until the model acquires a particular piece of knowledge. Remarkably, the influence of the ten experiments on the model's training dynamics and overall performance is minimal. However, interactions between different experiments may act as a potential confounder in our approach. We propose to test for interactions with continual pretraining experiments, finding them to be negligible in our setup. Overall, our findings suggest that performing multiple pretraining experiments in a single training run can enable rigorous scientific experimentation with large models on a compute budget.