CCD: Mitigating Hallucinations in Radiology MLLMs via Clinical Contrastive Decoding

作者: Xi Zhang, Zaiqiao Meng, Jake Lever, Edmond S. L. Ho

分类: cs.CL, cs.AI, cs.CV

发布日期: 2025-09-27 (更新: 2025-10-17)

备注: Preprint, 27 pages, 3 figures

💡 一句话要点

提出临床对比解码以解决放射学多模态大语言模型的幻觉问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态大语言模型 医学幻觉 放射学 临床对比解码 生成模型 医疗应用 文本生成

📋 核心要点

- 现有的多模态大语言模型在放射学中生成的描述常常缺乏临床支持,导致医学幻觉问题严重。

- 论文提出的临床对比解码(CCD)框架,通过引入结构化临床信号,改善了生成过程中的临床保真度。

- 在多个数据集和模型上进行的实验表明,CCD显著提升了放射学报告生成的性能,尤其在MIMIC-CXR数据集上表现突出。

📝 摘要(中文)

多模态大语言模型(MLLMs)在放射学领域取得了显著进展,但它们常常生成不支持临床的描述,称为医学幻觉,这在需要准确性和图像基础输出的医疗应用中构成严重风险。通过实证分析,我们发现提示引发的幻觉在放射学MLLMs中仍然普遍存在,主要由于对临床部分的过度敏感。为此,我们提出了临床对比解码(CCD),这是一种无训练和无检索的推理框架,整合了来自任务特定放射学专家模型的结构化临床信号。CCD引入了双阶段对比机制,在生成过程中细化标记级别的logits,从而增强临床保真度,而无需修改基础的MLLM。实验表明,CCD在放射学报告生成(RRG)上持续改善整体性能,在MIMIC-CXR数据集上,应用于最先进的RRG模型时,RadGraph-F1提升了17%。

🔬 方法详解

问题定义:本论文旨在解决放射学多模态大语言模型生成医学幻觉的问题。现有方法对临床信息的过度敏感性导致生成的描述缺乏临床支持,影响医疗应用的安全性和有效性。

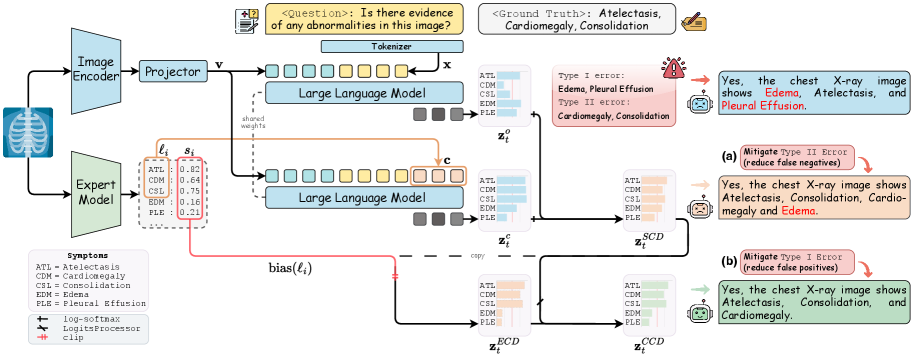

核心思路:论文提出的临床对比解码(CCD)框架,通过整合来自放射学专家模型的结构化临床信号,采用双阶段对比机制来细化生成过程中的标记级别logits,从而提高生成内容的临床保真度。

技术框架:CCD框架包括两个主要阶段:首先,通过对比学习机制对生成的token进行细化;其次,利用结构化临床信号来增强生成内容的准确性和可靠性。该框架不需要对基础的MLLM进行修改,具有轻量级和可推广性。

关键创新:CCD的核心创新在于其双阶段对比机制,这一设计使得模型在生成过程中能够有效地减少医学幻觉的产生,与传统方法相比,提供了一种更为灵活和高效的解决方案。

关键设计:在CCD中,关键的参数设置和损失函数设计确保了对比学习的有效性,具体的网络结构细节未在摘要中详细说明,但强调了与放射学专家模型的结合。通过这种设计,CCD能够在不增加额外训练成本的情况下,显著提升生成结果的临床相关性。

🖼️ 关键图片

📊 实验亮点

实验结果显示,CCD在放射学报告生成任务上表现优异,特别是在MIMIC-CXR数据集上,相较于最先进的RRG模型,RadGraph-F1指标提升了17%。这一显著的性能提升证明了CCD在减少医学幻觉方面的有效性。

🎯 应用场景

该研究的潜在应用领域包括医疗影像分析、放射学报告生成以及其他需要高准确性的医疗文本生成任务。通过有效减少医学幻觉,CCD能够提高医疗决策的安全性和有效性,未来可能在临床实践中发挥重要作用。

📄 摘要(原文)

Multimodal large language models (MLLMs) have recently achieved remarkable progress in radiology by integrating visual perception with natural language understanding. However, they often generate clinically unsupported descriptions, known as medical hallucinations, which pose serious risks in medical applications that demand accuracy and image-grounded outputs. Through empirical analysis, we find that prompt-induced hallucinations remain prevalent in radiology MLLMs, largely due to over-sensitivity to clinical sections. To address this, we introduce Clinical Contrastive Decoding (CCD), a training-free and retrieval-free inference framework that integrates structured clinical signals from task-specific radiology expert models. CCD introduces a dual-stage contrastive mechanism to refine token-level logits during generation, thereby enhancing clinical fidelity without modifying the base MLLM. Experiments on three datasets and multiple models demonstrate that CCD consistently improves overall performance on radiology report generation (RRG). On the MIMIC-CXR dataset, it yields up to a 17% improvement in RadGraph-F1 when applied to state-of-the-art RRG models. Our approach provides a lightweight and generalisable solution for mitigating medical hallucinations, effectively bridging expert models and MLLMs in radiology.